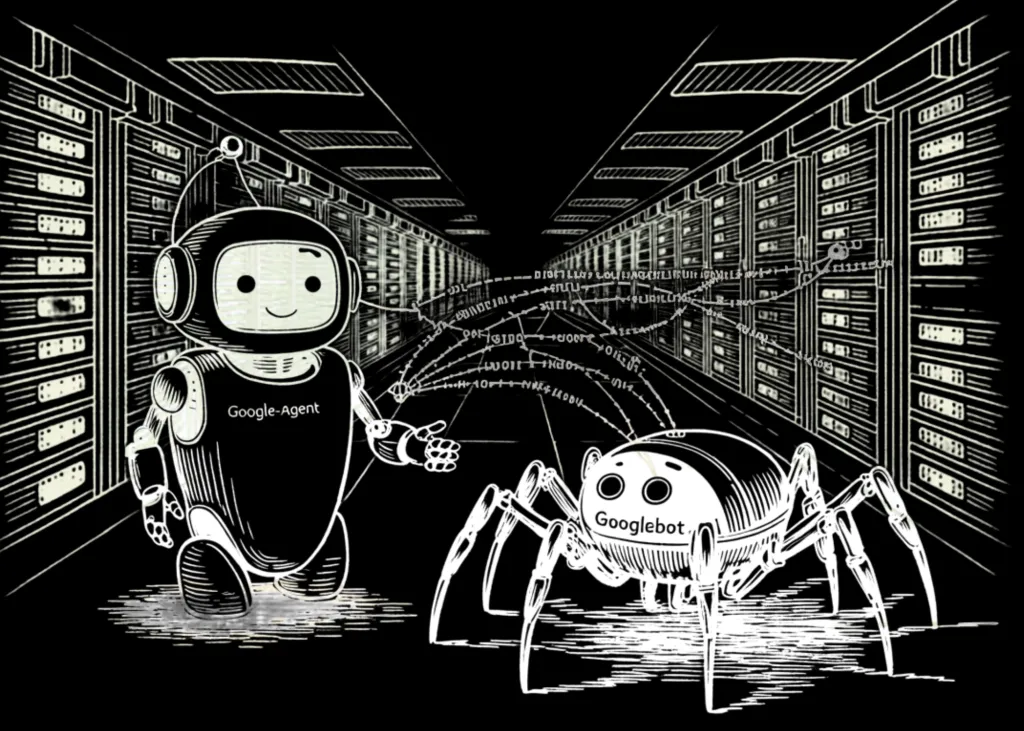

În peisajul digital în continuă și rapidă evoluție, gigantul tehnologic Google a făcut un pas crucial pentru clarificarea modului în care funcționează ecosistemul său complex de colectare a datelor. Compania a trasat o distincție tehnică esențială între două entități care, deși pot părea similare la prima vedere, îndeplinesc roluri fundamental diferite în marea infrastructură a internetului: „Google-Agent” și „Googlebot”. Această delimitare nu este doar o simplă schimbare de denumire, ci o redefinire a limitelor dintre sistemele tradiționale de indexare a căutărilor și noile paradigme de acces bazate pe inteligența artificială declanșate de utilizatori.

Pentru înțelegerea profundă a acestei distincții, este necesar să analizăm mai întâi rolul clasic al Googlebot-ului. De decenii întregi, Googlebot a fost coloana vertebrală a motorului de căutare Google. Este un „crawler” sau un „spider” automatizat, un program care navighează neîncetat prin vastitatea web-ului, descoperind pagini noi, actualizând pe cele existente și adăugându-le în indexul central. Scopul său principal este de a construi o hartă gigantică a internetului, disponibilă ulterior utilizatorilor sub forma rezultatelor căutării. Când un utilizator introduce un termen de căutare, Google nu răscolește internetul în timp real, ci consultă acest index masiv, creat și întreținut de Googlebot. Activitatea acestuia este guvernată de reguli stricte, cum ar fi fișierele robots.txt, care îi dictează ce zone ale unui site sunt permise sau interzise pentru indexare.

În schimb, noua entitate, denumită „Google-Agent”, reprezintă o abordare radical diferită. Aceasta nu este un crawler autonom care acționează în fundal pentru a hrăni un index static. Google-Agent este strâns legată de noile funcționalități de inteligență artificială, cum ar fi modelele generative sau asistenții AI integrați în ecosistemul Google. Dacă Googlebot este un muncitor silitor care adună materiale de construcție, Google-Agent este arhitectul care, la cererea unui utilizator, ia acele materiale și creează ceva nou, o sinteză sau un răspuns direct. Caracteristica sa definitorie este natura sa „declanșată de utilizator” (user-triggered). Spre deosebire de crawling-ul pasiv și continuu, acțiunile Google-Agent sunt inițiate de o întrebare specifică, un prompt sau o nevoie concretă a utilizatorului uman.

Această distincție tehnică are implicații profunde pentru proprietarii de site-uri web, dezvoltatori și creatori de conținut. În era Web 2.0, controlul se făcea simplu: dacă nu voiai să apari în căutări, blocai Googlebot. Acum, în era AI, lucrurile se complică. Google-Agent poate accesa conținut pentru a „înțelege” și a genera răspunsuri, ceea ce ridică întrebări delicate despre drepturile de autor, traficul web și monetizare. Dacă un AI citește un articol și oferă un rezumat complet utilizatorului, acel utilizator mai are nevoie să acceseze site-ul sursă? Aceasta este tensiunea centrală pe care Google încearcă să o gestioneze prin definirea acestor limite tehnice.

Prin separarea clară a celor două entități, Google oferă instrumente mai granulare de control. Proprietarii de site-uri ar putea, teoretic, să permită Googlebot să indexeze paginile pentru rezultatele clasice de căutare, generând trafic, dar să restricționeze Google-Agent de la a „consuma” același conținut pentru antrenarea sau rularea modelelor AI. Această separare este vitală pentru menținerea unui ecosistem web sănătos, unde creatorii de conținut nu se tem că munca lor va fi preluată și sintetizată fără beneficii directe în termeni de vizibilitate sau venituri.

Mai mult, definiția tehnică aduce clarificări și în ceea ce privește transparența. Identificarea user-agent-ului în log-urile serverelor permite administratorilor să vadă nu doar când a fost accesat site-ul lor, ci și de ce. Un acces de la Googlebot indică o indexare pentru căutare, în timp ce un acces de la Google-Agent semnalează o interacțiune AI. Această transparență este crucială pentru analiza datelor și pentru înțelegerea comportamentului digital. De exemplu, un site poate observa un declin al traficului uman, dar o creștere a activității Google-Agent, sugerând că informația este valoroasă, dar este preluată direct de sistemele AI înainte de a ajunge la utilizatorul final.

În concluzie, delimitarea dintre Google-Agent și Googlebot marchează un punct de inflexiune în istoria internetului. Recunoaște oficial că web-ul nu mai este doar un depozit de documente statice care trebuie indexate, ci o bază de cunoștințe dinamică care poate fi interogată și sintetizată de inteligența artificială. Pentru Google, aceasta este o mișcare strategică de adaptare la noile realități tehnologice, încercând să echilibreze inovația AI cu interesele economice ale ecosistemului de publishing online. Viitorul va decide dacă această separare tehnică va fi suficientă pentru a proteja drepturile creatorilor sau dacă asistenții AI vor deveni, în mod inevitabil, principalii „consumatori” de conținut web, lăsând motoarele de căutare tradiționale în umbra istoriei.

Google-Agent vs Googlebot: Google definește limita tehnică dintre accesul AI declanșat de utilizator și sistemele de crawling pentru căutare