În acest articol tehnic detaliat, vom crea un asistent AI bazat pe LLM capabil să navigheze pe site-urile magazinelor online de îmbrăcăminte, să identifice articole specifice de vestimentație și, ulterior, să utilizeze un model avansat de „virtual try-on” (încercare virtuală) pentru a vă arăta cum ar arăta acele haine pe dumneavoastră, totul fără a părăsi confortul propriului cămin.

Obiectivul: Stilistul dumneavoastră personal AI

Pentru a aduce la viață asistentul nostru virtual de cumpărături, vom orchestra o combinație sinergică între trei componente tehnologice cheie, fiecare având un rol distinct în arhitectura sistemului:

1. Modelul de difuzie IDM-VTON: Această componentă reprezintă inima funcționalității de încercare virtuală. Este un model AI sofisticat capabil să editeze fotografii existente, modificându-le vizual pentru a crea iluzia că o persoană poartă un articol de îmbrăcăminte diferit. Tehnologia din spate implică rețele neuronale profunde care înțeleg geometria corpului uman, textura materialelor și modul în care lumina interacționează cu suprafețele textile. Pentru acest proiect, vom utiliza instanța IDM-VTON găzduită pe platforma Hugging Face Spaces, accesibilă publicului, ceea ce ne scutește de necesitatea unor resurse hardware locale extrem de costisitoare.

2. Gradio: Gradio este o bibliotecă Python open-source care a revoluționat modul în care dezvoltatorii pot prototipa și distribui aplicații web bazate pe inteligență artificială. În contextul proiectului nostru, Gradio joacă un rol crucial: acela de a crea servere MCP (Model Context Protocol). Acesta acționează ca un pod de comunicație, permițând LLM-ului să apeleze modelul IDM-VTON și alte instrumente definite, abstractizând complexitatea apelurilor API.

3. Funcția AI Chat din Visual Studio Code: Pentru interfața cu utilizatorul, vom utiliza editorul de cod VS Code și funcția sa integrată de chat AI. Acest mediu suportă adăugarea de servere MCP arbitrare, oferind un terminal natural pentru interacțiunea cu asistentul nostru. Aceasta va fi punctul în care utilizatorul emite comenzi în limbaj natural și vizualizează rezultatele încercărilor virtuale.

Construirea serverului MCP cu Gradio

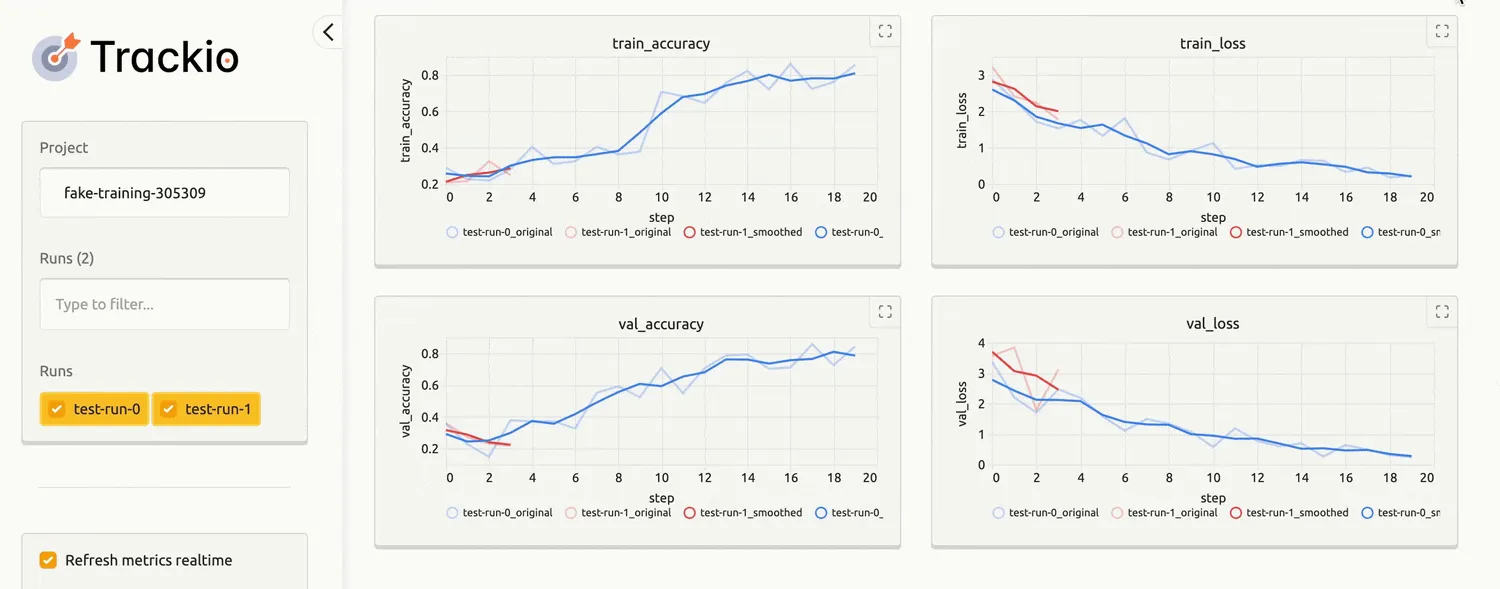

Nucleul tehnic al asistentului nostru de cumpărături este serverul MCP Gradio. Acest server va expune un instrument principal de generare a imaginilor. Implementarea începe prin importarea bibliotecilor necesare: `gradio_client` pentru comunicarea cu API-ul Hugging Face și `gradio` pentru construirea interfeței și expunerea funcționalității.

Codul definește o funcție `vton_generation` care acceptă două argumente: URL-ul sau fișierul imaginii modelului uman și URL-ul sau fișierul imaginii articolului de îmbrăcăminte. Această funcție comunică cu clientul IDM-VTON, trimițând parametri precum imaginea de fundal, imaginea hainei, pașii de denoising (denoising steps) și seed-ul pentru reproductibilitate. Rezultatul returnat este o imagine compozită generată de modelul de difuzie.

Un aspect revoluționar al acestei implementări este parametrul `mcp_server=True` din metoda `launch()`. Prin setarea acestui parametru, Gradio convertește automat funcțiile Python definite în instrumente MCP pe care modelele de limbaj le pot înțelege și utiliza. Documentația funcțiilor (docstrings) este utilizată pentru a genera descrieri automate ale instrumentelor și parametrilor lor, facilitând integrarea seamless cu LLM-urile.

Este important de menționat că spațiul original IDM-VTON a fost implementat folosind Gradio 4.x, o versiune anterioară funcționalității automate MCP. Prin urmare, în acest demo, construim o interfață Gradio care interoghează spațiul original prin clientul API Gradio, acționând ca un adaptor modern.

Configurarea mediului în VS Code

Pentru a conecta serverul nostru MCP la ecosistemul VS Code, trebuie să configurăm fișierul `mcp.json`. Acest fișier de configurare este harta care ghidează chat-ul AI către serverul nostru local și către alte instrumente externe necesare. Acesta poate fi accesat prin panoul de comenzi al editorului, selectând opțiunea „MCP: Open User Configuration”.

Configurația JSON definește două servere esențiale:

1. Serverul `vton`: Acesta este serverul local pe care l-am creat, accesibil la adresa `http://127.0.0.1:7860/gradio_api/mcp/`. Este crucial ca URL-ul să corespundă cu cel afișat în consolă la lansarea aplicației Gradio.

2. Serverul `playwright`: Pentru ca asistentul AI să poată naviga pe web și alege produse, avem nevoie de un browser automatizat. Serverul Playwright MCP este invocat prin comanda `npx`, permițând agentului AI să interacționeze cu site-urile de e-commerce. Pentru rularea acestuia, este necesară instalarea Node.js în mediul de dezvoltare.

Integrarea finală și utilizarea

Odată ce infrastructura este pornită și configurată, putem începe interacțiunea cu asistentul. Utilizatorul poate deschide un nou chat în VS Code și poate formula cereri complexe în limbaj natural. De exemplu: „Navighează pe site-ul Uniqlo pentru tricouri albastre și arată-mi cum aș arăta în trei dintre ele, folosind fotografia mea de la [URL-ul-imagine]”.

În spate, LLM-ul va interpreta cererea, va utiliza serverul Playwright pentru a naviga pe site-ul menționat, va extrage imaginile produselor, iar apoi va apela serverul nostru `vton` pentru a genera compoziții vizuale. Rezultatul va fi prezentat direct în fereastra de chat, oferind o experiență de cumpărare hiper-personalizată.

Concluzii

Combinația dintre Gradio, protocolul MCP și modele AI puternice precum IDM-VTON deschide orizonturi fascinante pentru crearea de asistenți inteligenți și utili. Această arhitectură demonstrează cum putem îmbina capacitățile de navigare web cu cele de generare vizuală, rezolvând probleme concrete ale utilizatorilor. Într-o lume în care fiecare aplicație și site web integrează funcționalități AI, abilitatea de a construi și personaliza acești agenți devine o competență esențială pentru dezvoltatorii moderni. Prin urmarea pașilor prezentați, puteți construi propriul asistent pentru a aborda provocările specifice domeniului dumneavoastră de interes.