Subiect: #Mixture of Experts

DeepSeek prezintă un nou model de AI care „îmbrățișează spațiul” cu modelele de frontieră

DeepSeek lansează modelele V4 Flash și V4 Pro, cu până la 1,6 biliardi de parametri,preturi subțepătoare și performanțe aproape la nivelul modelelor de frontiera, marcând un pas semnificativ în cursa globală de AI.

Alegeri Arhitecturale în Ecosistemul AI Open-Source din China: Construcția Dincolo de DeepSeek

Analiza detaliată a schimbărilor arhitecturale din ecosistemul AI open-source din China post-DeepSeek, evidențiind adoptarea arhitecturii Mixture of Experts (MoE), diversificarea modalităților, preferința pentru modelele mici și trecerea strategică la hardware domestic.

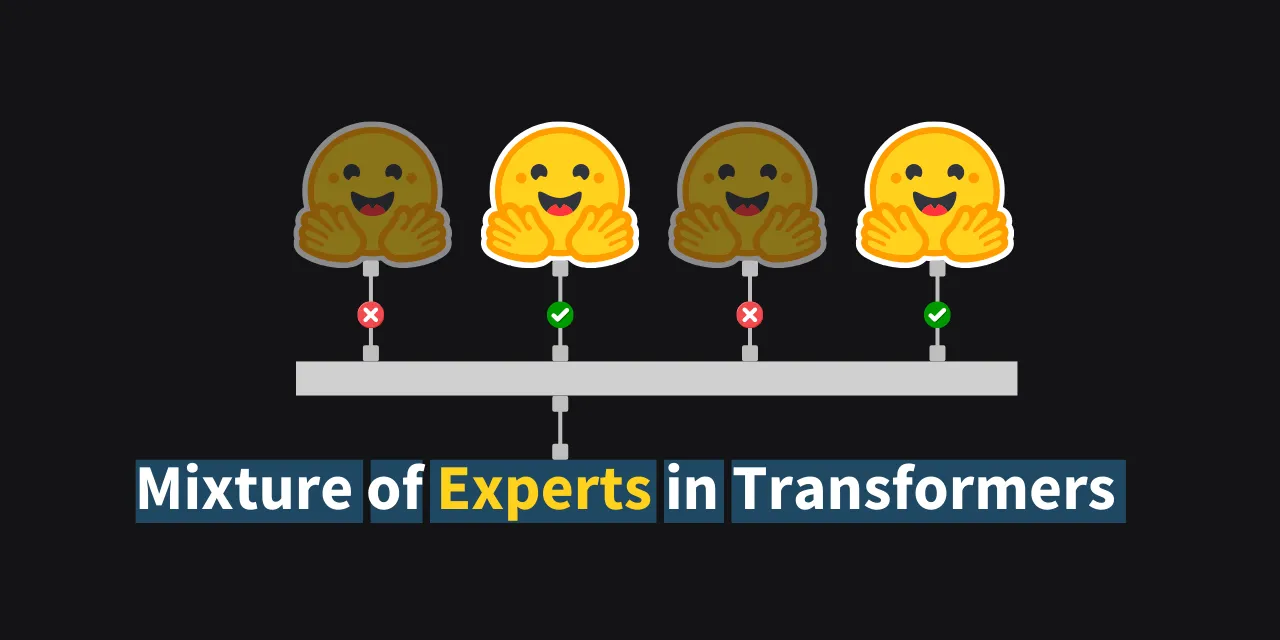

Mixture of Experts (MoE) în Transformers: O Revoluție în Arhitectura Modelelor de Limbaj

Modelele Mixture of Experts (MoE) revoluționează AI-ul prin decuplarea capacității de învățare de costul computațional. Acest articol explorează integrarea lor în Transformers, de la refactorizarea încărcării greutăților și materializarea leneșă a tensorilor, până la backend-uri optimizate și paralelismul experților.