Subiect: #Transformer

Construirea NQS-urilor Bazate pe Transformere pentru Sisteme de Spin Frustrare cu NetKet

O abordare revoluționară la intersecția dintre fizica materiei condensate și învățarea automată, care utilizează arhitecturi transformer pentru a studia sisteme cuantice frustrate prin intermediul platformei NetKet.

Prezentarea Falcon-H1-Arabic: Extinderea limitelor inteligenței artificiale pentru limba arabă printr-o arhitectură hibridă inovatoare

Falcon-H1-Arabic reprezintă un salt tehnologic major în procesarea limbajului natural pentru limba arabă, introducând o arhitectură hibridă Mamba-Transformer inovatoare. Cu modele de 3B, 7B și 34B parametri capabile să proceseze până la 256.000 de tokeni, această familie depășește performanțele modelelor existente, inclusiv pe cele mai mari, stabilind noi standarde în benchmark-urile OALL și 3LM.

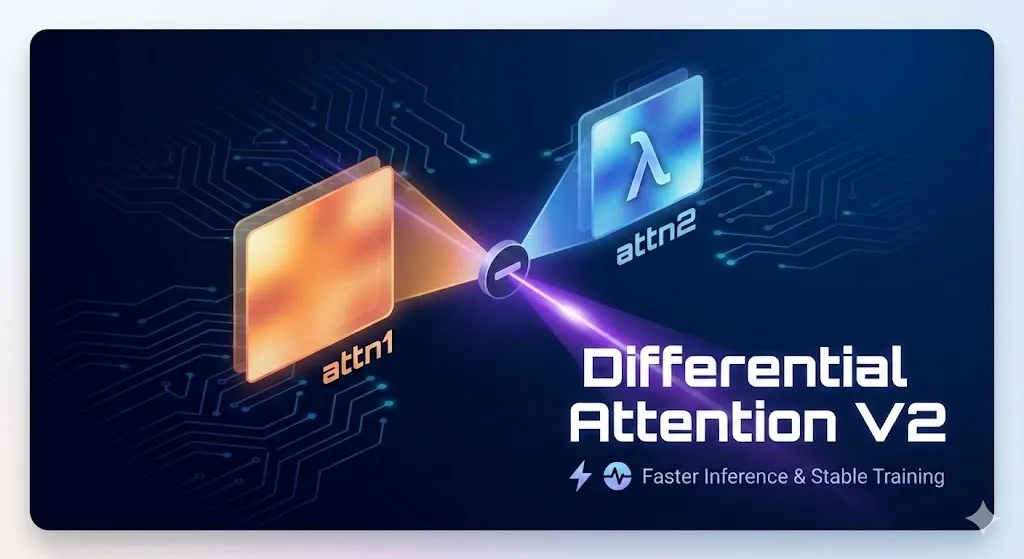

Differential Transformer V2: O nouă eră în eficiența și stabilitatea modelelor de limbaj de mari dimensiuni

Differential Transformer V2 (DIFF V2) revoluționează arhitectura LLM prin optimizarea eficienței inferenței și eliminarea instabilității numerice specifice versiunii anterioare. Prin dublarea capetelor de interogare și o nouă operație diferențială, modelul depășește constrângerile Softmax, oferind o decodare rapidă fără a necesita nuclee personalizate.