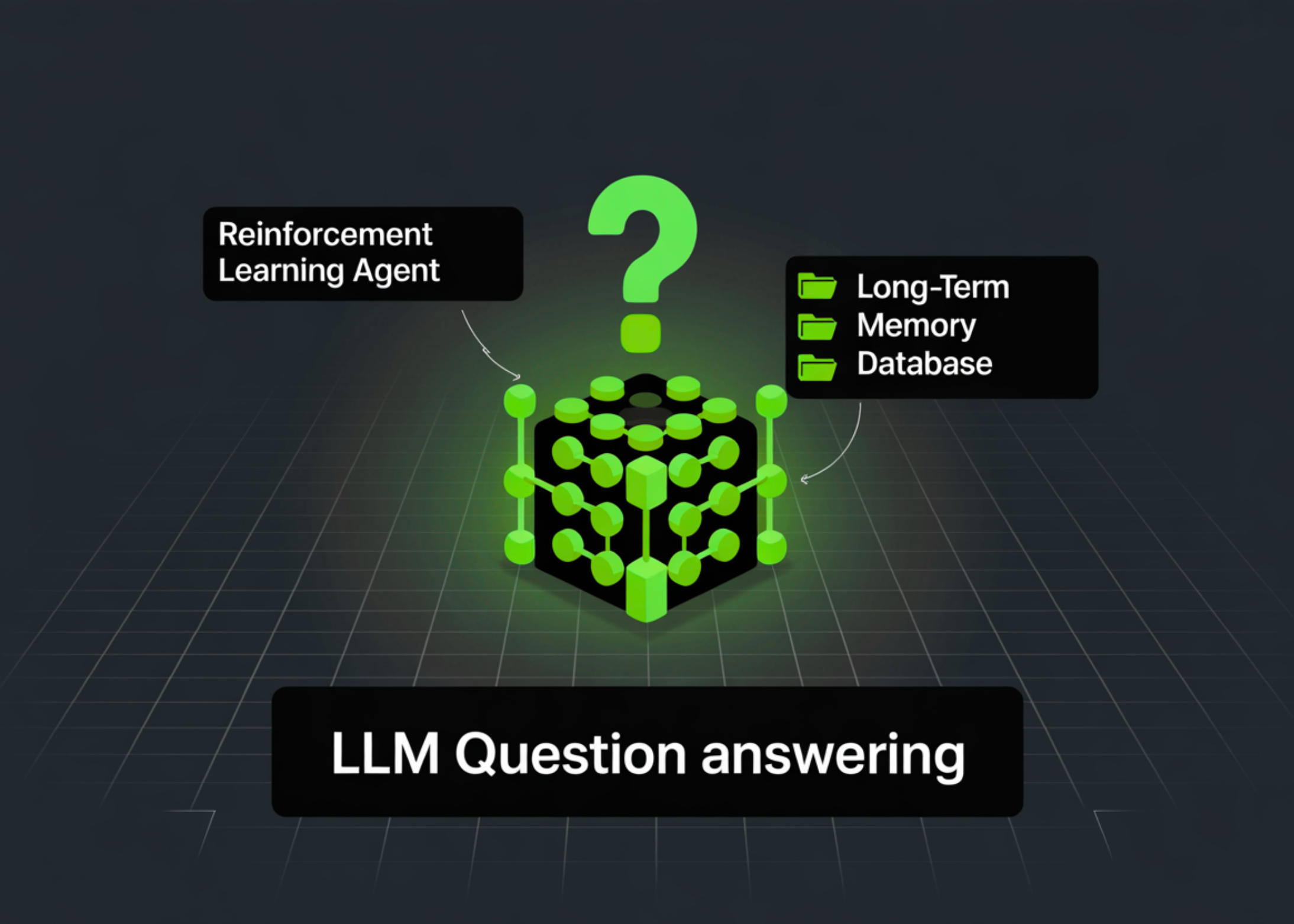

De ce avem nevoie de memorie pe termen lung în LLM-uri?

Modelele de limbaj mari sunt antrenate pe cantități masive de date, dar atunci când răspund la o întrebare, ele pot accesa doar contextul furnizat în promptul curent. De exemplu, dacă un utilizator pune o întrebare despre un eveniment menționat cu o oră mai devreme într-o conversație, modelul va uita acel detaliu dacă nu este reamintit explicit. Aceasta este o problemă majoră pentru aplicații precum chatbot-uri de suport, asistenți personali sau sisteme de dialog pe termen lung. Soluția constă în adăugarea unei baze de memorie externe – un depozit de informații stocate sub formă de vectori sau texte – și a unui mecanism de recuperare care să selecteze cele mai relevante amintiri atunci când este necesar.

Învățarea prin întărire: cheia pentru o recuperare inteligentă

Învățarea prin întărire este o ramură a machine learning-ului în care un agent învață să ia decizii optime prin interacțiunea cu un mediu, primind recompense sau penalități pentru acțiunile sale. În contextul nostru, agentul este responsabil pentru alegerea amintirilor care vor fi incluse în contextul LLM-ului. Scopul său este să maximizeze acuratețea răspunsurilor, minimizând în același timp costul computațional al recuperării.

Arhitectura sistemului

Un sistem tipic de LLM cu memorie pe termen lung și agent RL include următoarele componente:

1. Baza de memorie: O colecție de înregistrări (de exemplu, fragmente de text, rezumate sau vectori de înglobare) care reprezintă informații din interacțiunile anterioare. Fiecare înregistrare are un timestamp și o relevanță potențială.

2. Agentul RL: Un model (de obicei o rețea neuronală) care primește ca intrare întrebarea curentă, contextul imediat și un set de candidați din memoria pe termen lung. Agentul decide ce amintiri să includă în promptul final.

3. LLM-ul: Modelul de limbaj care generează răspunsul pe baza contextului îmbogățit cu amintirile selectate.

4. Funcția de recompensă: O metrică care evaluează calitatea răspunsului – de exemplu, scorul de acuratețe față de un răspuns de referință, sau feedback-ul utilizatorului.

Cum funcționează antrenarea?

Procesul de antrenare se desfășoară în mai multe etape:

Provocări și soluții

Una dintre principalele provocări este spațiul mare de acțiuni – numărul de combinații posibile de amintiri poate fi uriaș. Pentru a face față, se pot folosi tehnici de aproximare a funcției de valoare sau se poate antrena agentul să producă un scor pentru fiecare amintire în parte, selectându-le pe cele cu scorul cel mai mare. De asemenea, este important să se evite supraînvățarea pe un set limitat de date; de aceea, se recomandă utilizarea unor medii de simulare diverse.

Implementare practică: un ghid pas cu pas

Pentru a construi un prototip, poți folosi biblioteci populare precum Hugging Face Transformers pentru LLM, Stable Baselines3 pentru algoritmi RL și FAISS pentru indexarea vectorială a memoriei. Iată pașii esențiali:

1. Colectează date de antrenare: Creează un set de întrebări și răspunsuri corecte, împreună cu un istoric de conversații simulate.

2. Construiește baza de memorie: Transformă fiecare fragment de text într-un vector folosind un model de înglobare (de exemplu, sentence-transformers). Stochează vectorii într-un index FAISS.

3. Definește mediul RL: Creează o clasă care, pentru fiecare pas, primește întrebarea, returnează starea (întrebarea + vectorii candidați) și așteaptă acțiunea (selecția amintirilor). Apoi, apelează LLM-ul și calculează recompensa.

4. Antrenează agentul: Folosește un algoritm RL din Stable Baselines3 (de exemplu, PPO) pentru a antrena agentul. Monitorizează recompensa medie pe episoade.

5. Evaluează și ajustează: Testează agentul pe întrebări noi și ajustează hiperparametrii (rata de învățare, dimensiunea lotului, etc.) pentru a îmbunătăți performanța.

Aplicații reale și impact

Un agent RL care învață să recupereze amintiri relevante poate fi integrat în:

Această abordare reduce semnificativ numărul de tokeni necesari în prompt, deoarece doar amintirile relevante sunt incluse, ceea ce duce la costuri mai mici și latență redusă.

De ce este important:

Construirea unui agent bazat pe învățare prin întărire pentru recuperarea memoriei pe termen lung reprezintă un salt calitativ în domeniul inteligenței artificiale conversaționale. Fără o astfel de memorie, LLM-urile rămân instrumente pasive, incapabile să învețe din interacțiuni și să ofere răspunsuri cu adevărat personalizate. Prin combinarea RL cu memoria externă, deschidem calea către sisteme care nu doar procesează limbaj, ci și își amintesc, se adaptează și evoluează în timp real. Aceasta este cheia pentru a transforma AI-ul dintr-un simplu generator de text într-un partener inteligent și util în viața de zi cu zi.