În data de 17 martie 2026, peisajul inteligenței artificiale a marcat un punct de inflexiune semnificativ odată cu anunțul lansării Holotron-12B de către H Company. Acest nou model multimodal, dedicat utilizării computerelor („computer-use”), reprezintă nu doar o simplă iterație a tehnologiei existente, ci o redefinire a modului în care agenții AI interacționează cu mediile digitale. Construit pe fundația solidă a modelului NVIDIA Nemotron-Nano-2 VL și rafinat prin antrenare suplimentară pe seturi de date proprietare, Holotron-12B este rezultatul unei colaborări strânse între laboratoarele de cercetare, având ca obiectiv principal optimizarea pentru scară și performanță în medii de producție reale.

De ce a fost construit Holotron-12B: O viziune dincolo de instrucțiuni statice

Majoritatea modelelor multimodale actuale sunt optimizate pentru viziune statică sau pentru urmarea simplă a instrucțiunilor. Totuși, cerințele mediului digital modern depășesc cu mult aceste capacități. Holotron-12B, la fel ca predecesorul său Holo2, a fost conceput cu un scop distinct și mult mai complex: să servească drept model de politică („policy model”) pentru agenți care trebuie să perceapă, să decidă și să acționeze eficient în medii interactive. Această distincție este crucială. În timp ce un model tradițional poate descrie o imagine, un „computer-use agent” trebuie să navigheze prin interfețe grafice, să interpreteze butoane, meniuri și texte, și să execute acțiuni complexe pentru a îndeplini un obiectiv.

Echipa H Company a identificat necesitatea unui model care să poată scala eficient în producție, gestionând contexte lungi cu multiple imagini, fără a sacrifica performanța pe benchmark-urile specifice agenților. Arhitectura NVIDIA Nemotron a oferit o bază puternică, iar prin dezvoltarea Holotron-12B, s-a demonstrat capacitățile extinse pe care un model le poate atinge printr-o antrenare suplimentară țintită.

Arhitectura hibridă SSM: Un salt cuantic în eficiența inferenței

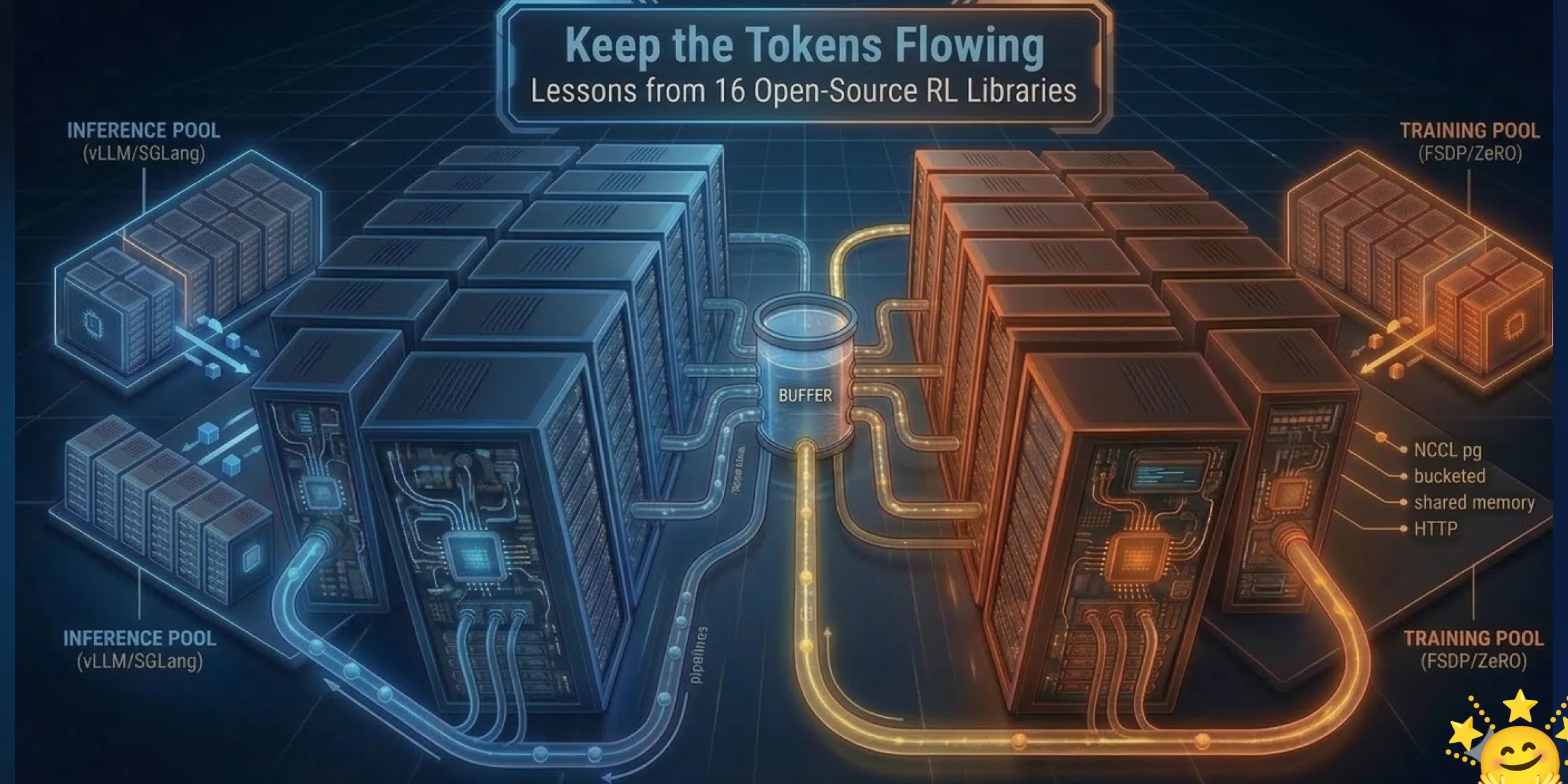

Inima inovației aduse de Holotron-12B constă în arhitectura sa fondată pe modele spațiu-stare (State-Space Models - SSM) hibride, combinată cu mecanisme de atenție. Spre deosebire de modelele bazate exclusiv pe transformere, care suferă de o creștere quadratică a costurilor computaționale pe măsură ce lungimea contextului crește, designul hibrid SSM este optimizat pentru o servire cu debit ridicat („high-throughput serving”).

Modelele spațiu-stată oferă o scalabilitate superioară pentru inferența pe contexte lungi, evitând capcana costurilor computaționale exponențiale asociate mecanismului complet de atenție. Acest lucru este benefic în special pentru sarcinile agenților care implică procesarea a sute de imagini de înaltă rezoluție și istorice lungi de interacțiuni. Contribuția majoră a unui SSM la nivelul inferenței este reducerea dramatică a amprentei de memorie. În timp ce arhitectura tradițională „vanilla attention” stochează activările K (Key) și V (Value) pentru fiecare token și fiecare strat – cunoscut sub numele de KV Cache, o problemă notorie de scalabilitate – SSM-urile funcționează ca modele recurente liniare. Acestea stochează doar o stare constantă per strat per secvență generată, independent de lungimea secvenței. Această inovație tehnică permite procesarea unui volum mult mai mare de date cu resurse hardware identice.

Performanță în condiții reale: Benchmark-ul WebVoyager

Validarea teoretică a arhitecturii a fost confirmată prin teste practice riguroase. Pe benchmark-ul WebVoyager, care simulează sarcini reale de agenți multimodali cu contexte lungi și imagini de înaltă rezoluție, Holotron-12B a excelat. Într-un test de concurență ridicată, folosind 100 de lucrători („benchmark workers”) pe un singur GPU H100 și platforma vLLM cu cele mai recente optimizări SSM (versiunea 0.14.1), Holotron-12B a atins un debit de tokeni de peste două ori mai mare comparativ cu modelul anterior, Holo2-8B.

Datele experimentale relevă o scalare eficientă: debitul total de tokeni a crescut constant până la 8.900 tokeni/secundă la o concurență maximă de 100. În contrast, Holo2-8B a atins un platou rapid la 5.100 tokeni/secundă. Acest comportament subliniază eficiența superioară a arhitecturii Nemotron în utilizarea memoriei video (VRAM), permițând dimensiuni de lot („batch sizes”) mult mai mari pe același hardware. Această caracteristică face din Holotron-12B o alegere ideală pentru sarcini legate de debit, cum ar fi generarea de date, adnotarea automată și învățarea prin întărire online.

Antrenarea și evaluarea: De la fundație la specializare

Procesul de antrenare al Holotron-12B a fost structurat strategic în două etape. Punctul de plecare a fost modelul de bază multimodal Nemotron-Nano-12B-v2-VL-BF16, publicat de NVIDIA. Ulterior, s-a procedat la o ajustare fină supravegheată (Supervised Fine-Tuning) pe un amestec proprietar de date de localizare și navigare de la H Company. Accentul a fost pus pe înțelegerea ecranelor, „grounding” (ancorarea elementelor vizuale în acțiuni) și interacțiuni la nivelul interfeței utilizator (UI).

Rezultatele pe benchmark-urile de agenți au fost remarcabile. Pe setul de teste WebVoyager, performanța a sărit de la 35,1% (modelul de bază) la 80,5%, depășind modelul Holo2-8B. Această creștere masivă ilustrează capacitatea modelului de a opera eficient într-un cadru agențial. De asemenea, pe benchmark-urile de localizare precum OS-World-G, GroundUI și WebClick, Holotron-12B a demonstrat îmbunătățiri substanțiale față de modelul de bază Nemotron, confirmând precizia în identificarea și interacționarea cu elementele vizuale specifice.

Viitorul: Nemotron 3 Omni și inteligența agențială comercială

Lansarea Holotron-12B este doar începutul. NVIDIA a anunțat eliberarea Nemotron 3 Omni, iar H Company se pregătește să utilizeze această nouă generație pentru a-și îmbunătăți modelele. Valorificând fundațiile arhitecturale hibride SSM-Attention și MoE (Mixture of Experts) ale familiei Nemotron 3, scopul este de a livra salturi și mai mari în capacitățile de raționament și precizia multimodală.

Pe măsură ce această tehnologie evoluează din cercetare către aplicații comerciale, ea promite să ofere întreprinderilor performanța de înalt debit și latență redusă necesară pentru implementări autonome de „computer use” la scară largă. Holotron-12B demonstrează că, atunci când este asociată cu infrastructura și setul de date corecte, arhitectura NVIDIA Nemotron VL oferă o fundație robustă pentru agenții multimodali din lumea reală. Modelele și punctele de control sunt disponibile acum pe platforma Hugging Face sub o licență NVIDIA Open Model, invitând comunitatea să exploreze limitele posibilului în interacțiunea om-mașină.

Holotron-12B: O nouă eră în agenții AI pentru utilizarea computerelor – performanță, eficiență și scalabilitate