1. Motivația: Tranziția de la antrenarea sincronă la arhitecturile asincrone

Paradigma antrenării sincrone, deși corectă și simplu de implementat, se lovește de limitări semnificative în contextul scalării moderne. Într-un ciclu sincron tradițional, fiecare pas de antrenare trebuie să aștepte finalizarea tuturor celorlalte etape – de la eșantionarea prompturilor și generarea de text, până la calcularea recompenselor și actualizarea gradientului. Această abordare lasă o mare parte a capacității de calcul a GPU-urilor neutilizată, creând „gulere” de performanță.

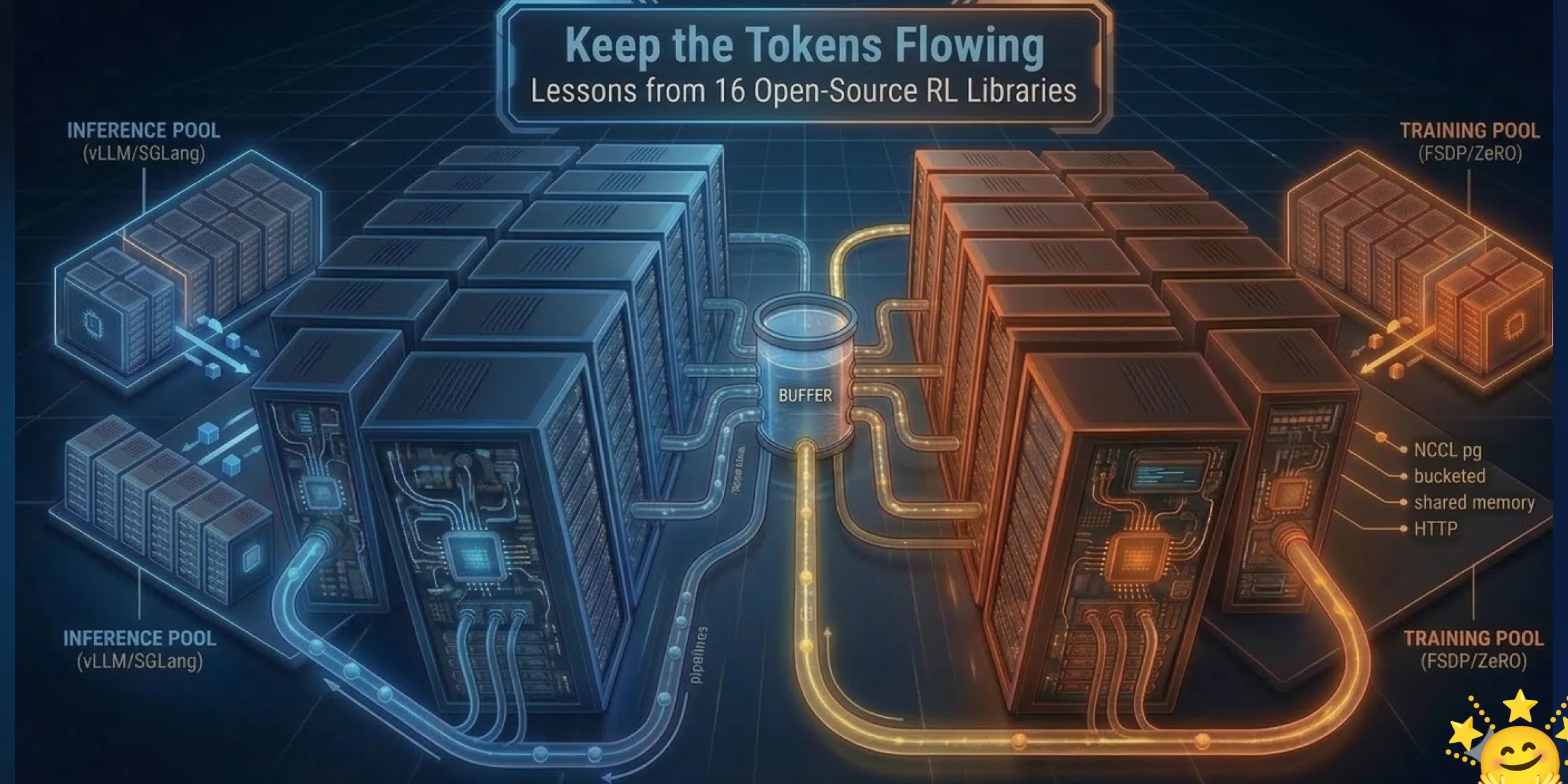

În schimb, antrenarea asincronă a emergat ca soluția dominantă pentru post-antrenarea la scară largă. Ideea centrală este fizicarea separării a două procese fundamentale: inferenta (generarea de text) și antrenarea (actualizarea ponderilor). Astfel, în timp ce un pool de GPU-uri dedicat inferenței produce continuu noi date (rollouts), un alt pool dedicat antrenării procesează datele existente și actualizează modelul. Această decuplare permite suprapunerea eficientă a operațiunilor, eliminând timpii morți.

1.1 Cum funcționează TRL în prezent

În implementarea sa actuală, `GRPOTrainer` din TRL execută un ciclu complet sincron. Acest lucru înseamnă că, pentru fiecare pas de antrenare, sistemul blochează resursele până când toate cele 512 de completări (de exemplu, 8 completări per prompt pentru 64 de prompt-uri) sunt generate. În modelele de raționament complex (reasoning models), unde o singură completare poate genera între 8.000 și 64.000 de token-uri de tip „chain-of-thought”, timpul de așteptare devine prohibitiv. De exemplu, generarea unui lot de date cu un model de 32B de parametri pe un singur GPU H100 poate dura aproximativ 56 de minute pentru completări de lungime medie. Chiar și în scenariul optimist cu 8 GPU-uri, timpul rămâne semnificativ, iar problema „straggler-ului” (secvența cea mai lentă care blochează întregul lot) agravează ineficiența.

1.2 Topologii de implementare: Colocated vs. Disaggregated

Există două modalități principale de a organiza resursele hardware pentru RL:

1. Modul Colocated (Coplasant): Inferența și antrenarea au loc pe aceleași GPU-uri, alternând. Deși economisește hardware, nu permite suprapunerea reală a operațiunilor; GPU-urile fie „dorm” în timpul inferenței, fie așteaptă în timpul antrenării.

2. Modul Disaggregated (Disagregat): Inferența și antrenarea sunt separate fizic pe pool-uri de GPU-uri distincte. Aceasta este arhitectura fundamentală pentru antrenarea asincronă veritabilă. Deși necesită mai multe resurse hardware, permite ca, în timp ce trainer-ul calculează gradientul pentru batch-ul N, pool-ul de inferență să genereze deja date pentru batch-ul N+K.

1.3 Gâtuirea performanței: Generarea

Analiza benchmark-urilor relevă că generația autoregresivă este factorul dominant în timpul total de antrenare. Modelele moderne de raționament necesită secvențe lungi de token-uri pentru a ajunge la o concluzie. Dacă luăm în calcul un model de 7B parametri, throughput-ul este de aproximativ 6.300 token-uri/secundă. Totuși, pentru un model de 32B, acesta scade la 1.200 token-uri/secundă. Această diferență masivă subliniază necesitatea arhitecturilor care să țină GPU-urile active continuu, motiv pentru care separarea fizică a resurselor devine imperativă.

2. Bibliotecile analizate

Pentru a înțelege pe deplin peisajul actual, au fost analizate 16 biblioteci open-source proiectate special pentru antrenare asincronă. Dintre acestea se remarcă nume precum `verl` (ByteDance), cu peste 19.000 de stele pe GitHub, `SLIME` (THUDM), `ART` (CoreWeave) și `AReaL` (Ant Group). Fiecare dintre acestea a adoptat principiul separării inferenței de antrenare, dar implementările variază semnificativ în detaliile tehnice.

3. Cadrul de comparație: Șapte axe fundamentale

Pentru a structura analiza, am definit șapte axe de comparație care determină performanța și complexitatea fiecărei biblioteci:

4. Perspective globale și implicații de design

Studiul relevă o convergență clară: toate bibliotecile eficiente separă fizic inferența de antrenare. Totuși, viitorul aduce noi provocări. Algoritmii fără critic (Critic-Free) reduc cerințele de memorie, dar cresc presiunea asupra sincronizării ponderilor. Recompensele bazate pe procese (Process Rewards) introduc noi bariere de sincronizare, iar evoluția multi-agent exacerbează problema „straggler-ului”.

Mai mult, apare problema nepotrivirii între antrenare și inferență (Training-Inference Mismatch), exemplificată de cazul Deepseek v3.2 MoE, unde arhitectura modelului diferă între fazele de antrenare și inferență. De asemenea, distilarea (Distillation) prezintă aceeași problemă asincronă, doar că sub un nume diferit: un model „student” generează secvențe, iar un model „profesor” le evaluează.

5. Principii de design pentru viitorul antrenor asincron TRL

Pe baza acestor observații, noul antrenor TRL va adopta următoarele principii:

1. Orchestrare ușoară: Menținerea logicii de coordonare simplă pentru a reduce overhead-ul.

2. Cozi limitate cu versiune per token: Fără double-buffering, fiecare token va fi asociat cu versiunea modelului care l-a generat pentru o gestionare precisă a stării.

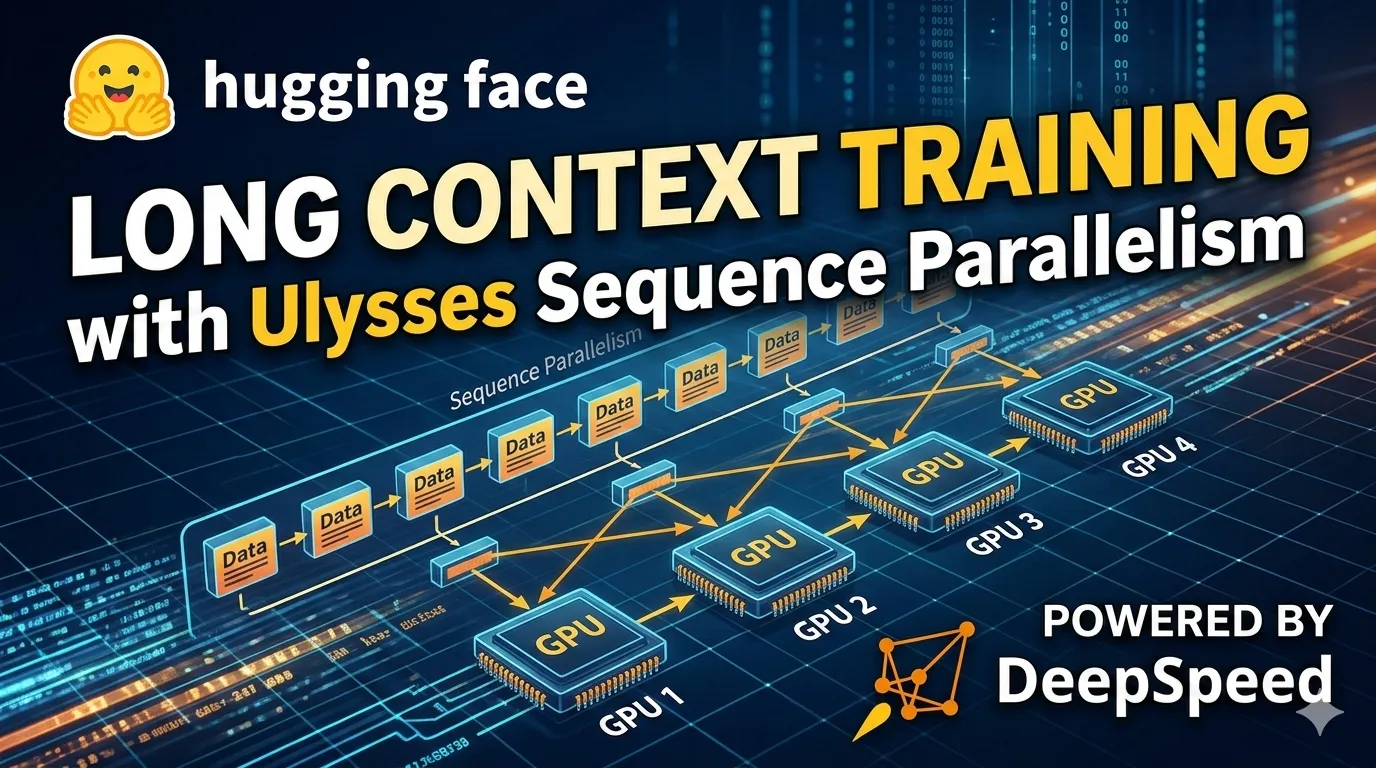

3. Sincronizare eficientă a ponderilor: Utilizarea NCCL cu transferuri împachetate pentru a minimiza latența.

4. Suport pentru rollout-uri parțiale: Esențial pentru workload-urile agentic, unde interacțiunile cu mediul extern pot întrerupe generarea.

În concluzie, trecerea la arhitecturi asincrone și disagregate nu este doar o optimizare, ci o necesitate pentru a scala modelele de limbaj dincolo de capacitățile actuale. Prin adoptarea acestor principii de design, comunitatea open-source poate construi infrastructura necesară pentru următoarea generație de inteligență artificială, asigurând că fiecare token generat contribuie eficient la îmbunătățirea modelului.