Paralelismul de Secvență Ulysses: Antrenarea modelelor AI cu contexte de un milion de token-uri

Publicat la 9 martie 2026

În peisajul în continuă evoluție al inteligenței artificiale, capacitatea de a procesa și de a înțelege contexte extrem de lungi a devenit un „Sfântul Graal” pentru modelele de limbaj mari (LLM). De la analiza unor coduri sursă complexe și a documentelor legale interminabile, până la procesarea unor romane întregi sau a istoricului complet al unei conversații, ferestrele de context extins reprezintă frontiera următoare a performanței AI. Totuși, antrenarea modelelor pentru a gestiona secvențe de sute de mii sau chiar milioane de token-uri prezintă provocări tehnice formidabile. Aici intervine Ulysses Sequence Parallelism (USP), o inovație tehnică ce face parte din protocolul Arctic Long Sequence Training (ALST) dezvoltat de Snowflake AI Research. Această metodă oferă o soluție elegantă și scalabilă prin distribuirea calculului atenției pe multiple GPU-uri, utilizând un mecanism inteligent de paralelism al capetelor de atenție. În acest articol, vom explora în profunzime funcționarea Ulysses și integrarea sa în ecosistemul Hugging Face, de la Accelerate la Transformers Trainer și TRL's SFTTrainer.

Provocarea antrenării cu secvențe lungi

Mecanismul de atenție din arhitectura transformerilor scalează pătratic cu lungimea secvenței. Pentru o secvență de lungime n, atenția standard necesită O(n^2) operații în virgulă mobilă (FLOPs) și O(n^2) memorie pentru a calcula și stoca matricea scorurilor de atenție. Această constrângere reprezintă un blocaj major. Implementările optimizate, precum FlashAttention, reduc amprenta de memorie la O(n) prin tehnici de fragmentare (tiling) și prin evitarea materializării complete a matricei de atenție. Cu toate acestea, complexitatea de calcul O(n^2) rămâne omniprezentă.

Pentru secvențe foarte lungi (peste 32.000 de token-uri), chiar și cu FlashAttention, antrenarea atinge limitele de memorie ale unui singur GPU. Paralelismul tradițional de date (Data Parallelism) nu oferă o soluție viabilă în acest scenariu, deoarece fiecare GPU trebuie să proceseze integral secvența în interiorul blocului de atenție. Astfel, devine imperativă necesitatea unei metode de împărțire a secvenței în sine pe multiple dispozitive, o abordare fundamental diferită față de simpla replicare a modelului.

Mecanismul de funcționare Ulysses

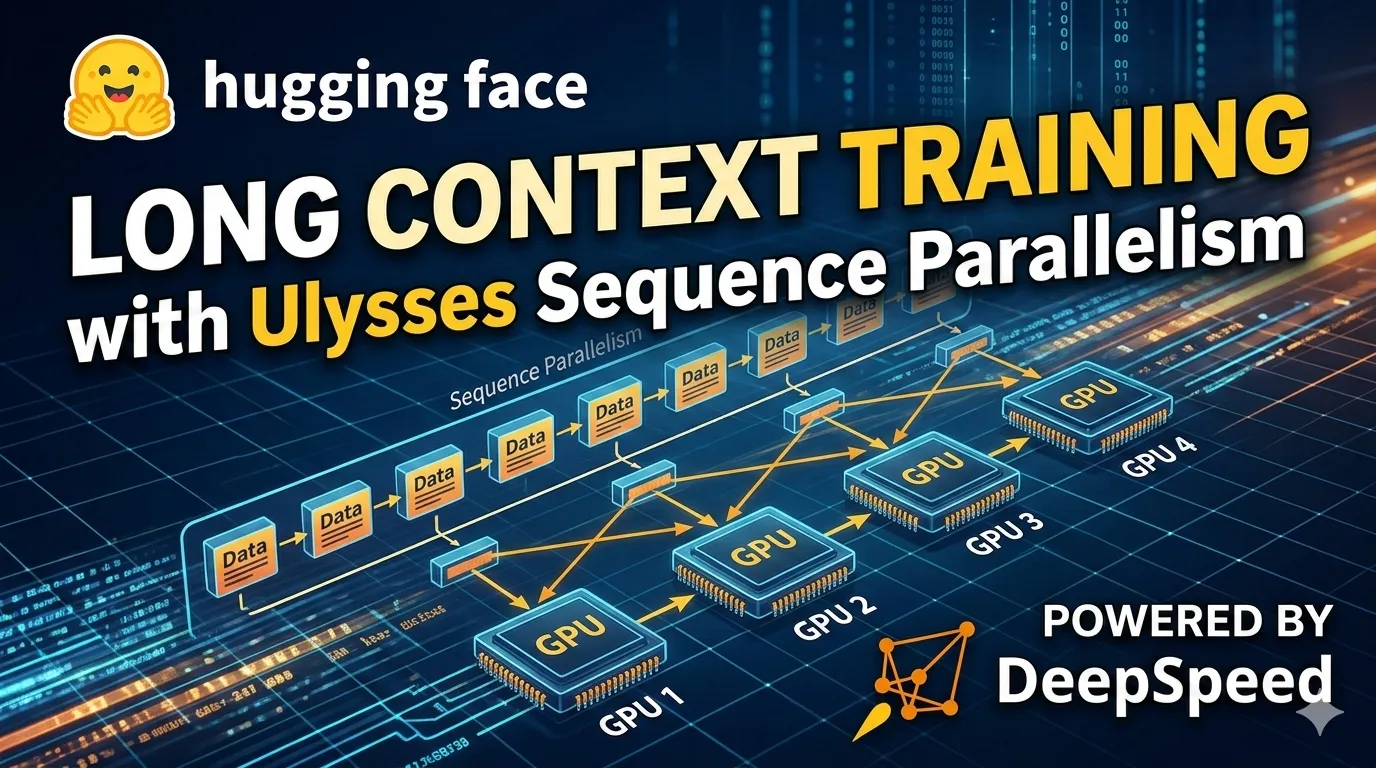

Ulysses Sequence Parallelism (SP), introdus în lucrarea de cercetare DeepSpeed Ulysses, adoptă o abordare ingenioasă: pe lângă împărțirea datelor pe dimensiunea secvenței, partitionează și capetele de atenție (attention heads) pe GPU-uri. Această dualitate permite o paralelizare eficientă. Procesul se desfășoară în următoarele etape esențiale:

1. Fragmentarea secvenței (Sequence Sharding): Secvența de intrare este împărțită pe dimensiunea secvenței pe P GPU-uri. Fiecare GPU i deține un segment de token-uri [i·n/P, (i+1)·n/P).

2. Proiecția QKV: Fiecare GPU calculează proiecțiile pentru query, key și value (Q, K, V) pentru fragmentul său local de secvență.

3. Comunicarea All-to-All (prima): Are loc o operație colectivă de redistribuire a datelor. După această etapă, fiecare GPU deține toate pozițiile secvenței după proiecții, dar doar pentru un subset de capete de atenție. Aceasta este transformarea cheie: se trece de la localizarea pe secvență la localizarea pe capete de atenție.

4. Atenția locală: Fiecare GPU calculează atenția pentru capetele atribuite, utilizând mecanisme standard precum FlashAttention sau SDPA (Scaled Dot Product Attention).

5. Comunicarea All-to-All (a doua): O nouă operație inversează redistribuirea, returnând datele la formatul fragmentat pe secvență.

6. Proiecția de ieșire: Fiecare GPU calculează proiecția finală de ieșire pentru fragmentul său local de secvență.

Intuiția fundamentală este că capetele de atenție sunt independente — fiecare cap poate fi calculat separat. Schimbând localitatea secvenței cu localitatea capetelor, Ulysses permite o paralelizare eficientă cu un cost de comunicare relativ scăzut.

Complexitatea comunicațională

Ulysses necesită două operații all-to-all pe strat de atenție, cu un volum total de comunicare de O(n·d/P) per GPU. În comparație, Ring Attention comunică O(n·d) per GPU — un factor P mai mare — prin transferuri punct-la-punct secvențiale în jurul inelului. Mai mult, Ulysses beneficiază de o latență redusă, deoarece all-to-all poate exploata lățimea de bandă bisecțională completă într-un singur pas colectiv, în timp ce Ring Attention serializează peste P-1 salturi.

Integrarea cu Accelerate

Accelerate oferă infrastructura necesară pentru paralelismul de secvență Ulysses prin clasa ParallelismConfig și integrarea DeepSpeed. Configurarea este relativ simplă, necesitând specificarea backend-ului, dimensiunea paralelismului de secvență (sp_size) și parametrii specifici pentru gestionarea atenției.

La apelul metodei accelerator.prepare(), Ulysses este configurat automat: modelul este înregistrat, iar dataloader-ul este împachetat pentru a gestiona fragmentarea. Un aspect critic este agregarea pierderii (loss aggregation). În cadrul Ulysses, fiecare GPU calculează pierderea pe părți diferite ale secvenței. Pentru a obține gradientul corect, pierderile trebuie agregate și ponderate după numărul de token-uri valide per rank. Dacă se utilizează Transformers Trainer sau TRL, acest proces este gestionat automat. Totuși, pentru bucle de antrenare personalizate, este necesară implementarea manuală a unei agregări ponderate, care să țină cont de token-ii de padding sau de prompt-ii mascați.

Integrarea cu Transformers Trainer și TRL SFTTrainer

Transformers Trainer simplifică drastic utilizarea Ulysses. Prin simpla trecere a obiectului parallelism_config în TrainingArguments, Trainer-ul gestionează automat detaliile specifice SP: împachetarea dataloader-ului, fragmentarea secvenței și agregarea pierderii. Acest lucru elimină necesitatea scrierii codului complex de sincronizare manuală.

Pentru Supervised Fine-Tuning (SFT), TRL's SFTTrainer adaugă optimizări specifice. Configurația SFTConfig permite setarea unor parametri cruciali, precum max_length (lungimea globală a secvenței) și pad_to_multiple_of, care trebuie să fie egal cu sp_size pentru a asigura divizibilitatea corectă a secvenței. De asemenea, suportul pentru lungimi variabile ale secvențelor este activat prin parametrul sp_seq_length_is_variable.

Comparând Ulysses cu Ring Attention

Alegerea între Ulysses și Ring Attention depinde de specificul hardware-ului și al sarcinii. Ulysses excelează în scenariile unde lățimea de bandă a interconexiunii este mare (de exemplu, clustere cu NVLink), datorită eficienței operațiilor all-to-all. Ring Attention poate fi preferat în scenarii cu interconexiuni mai lente sau pentru secvențe extrem de lungi unde memoria per GPU este critică, deși suferă de latență mai mare din cauza comunicației secvențiale.

Cele mai bune practici și recomandări

Pentru a maximiza eficiența Ulysses, cercetătorii de la Snowflake recomandă câteva practici esențiale:

1. Divizibilitatea secvenței: Lungimea secvenței trebuie să fie divizibilă cu sp_size pentru a evita erorile de fragmentare.

2. Utilizarea Flash Attention: Este imperativă utilizarea FlashAttention 2 sau 3 pentru a reduce consumul de memorie și a crește viteza.

3. Combinarea cu DeepSpeed ZeRO: Integrarea cu ZeRO (stages 1, 2 sau 3) permite paralelism 2D (SP × DP), scalând modelele la miliarde de parametri.

4. Alocatorul PyTorch: Utilizarea alocatorului de memorie prietenos cu fragmentarea (memory fragmentation-friendly) previne erorile OOM (Out Of Memory).

5. Liger-Kernel: Utilizarea kernel-urilor optimizate precum Liger poate îmbunătăți performanța.

6. Distribuția token-urilor: Asigurarea unei distribuții echilibrate a token-urilor valide pe rank-uri optimizează agregarea pierderii.

Concluzii și impact

Ulysses Sequence Parallelism reprezintă un pas important în democratizarea antrenării modelelor cu context lung. Prin integrarea sa transparentă în ecosistemul Hugging Face, permite cercetătorilor și inginerilor să depășească barierele de memorie tradiționale, antrenând modele capabile să înțeleagă contexte de milioane de token-uri. Această tehnologie nu doar că optimizează resursele de calcul existente, dar deschide noi orizonturi pentru aplicații AI care necesită o înțelegere profundă și continuă a unor volume masive de informație.

Paralelismul de Secvență Ulysses: Antrenarea modelelor AI cu contexte de un milion de token-uri