Subiect: #Hugging Face

Ghid de codare pentru post-antrenamentul LLM cu TRL: de la Supervised Fine Tuning la DPO și GRPO Reasoning

Un ghid practic de codare pentru post-antrenamentul modelelor de limbaj mari (LLM) folosind biblioteca TRL, acoperind Supervised Fine Tuning (SFT), Direct Preference Optimization (DPO) și Group Relative Policy Optimization (GRPO), cu exemple de cod și explicații detaliate.

Parierea Chinezii în domeniul open-source: Cum modelele gratuite schimbă echilibrul puterii în AI

China a schimbat jocul în AI prin a face modelele sale de top open-source și gratuite, câştigând încrederea dezvoltatorilor global și depăşind SUA în descărcări — o strategie care transformă accesul, costul și suveranitatea tehnologică, chiar și în fața restricțiilor de chip-uri și acuzațiilor de distilare ilegală.

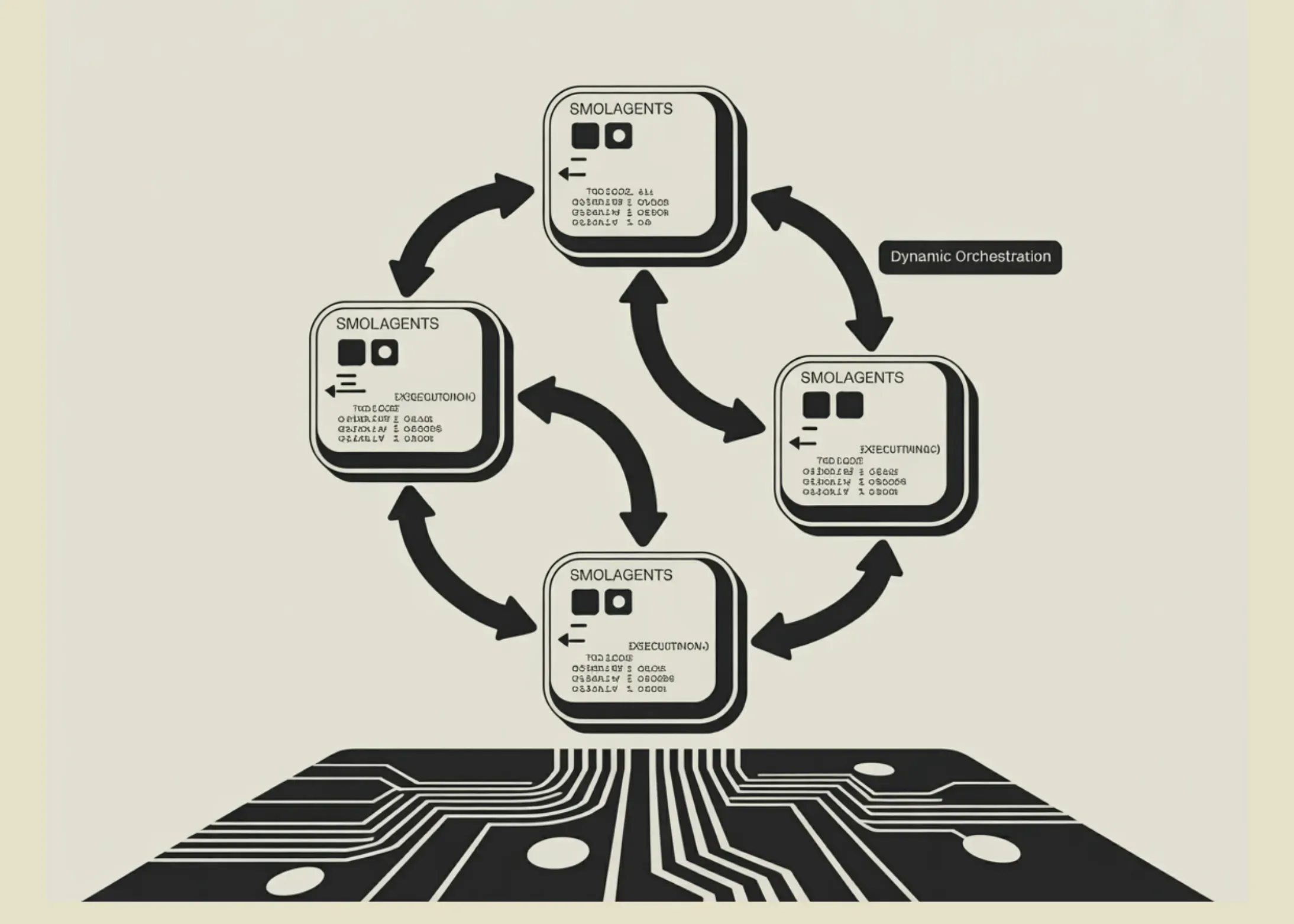

Implementare de Cod pentru Construirea Sistemelor Multi-Agent AI cu SmolAgents: Execuție de Cod, Apelare de Unelte și Orchestrare Dinamică

Descoperă cum să construiești sisteme multi-agent AI sofisticate folosind SmolAgents, cu accent pe execuția de cod, apelarea dinamică a uneltelor și orchestrarea inteligentă a mai multor agenți colaborativi.

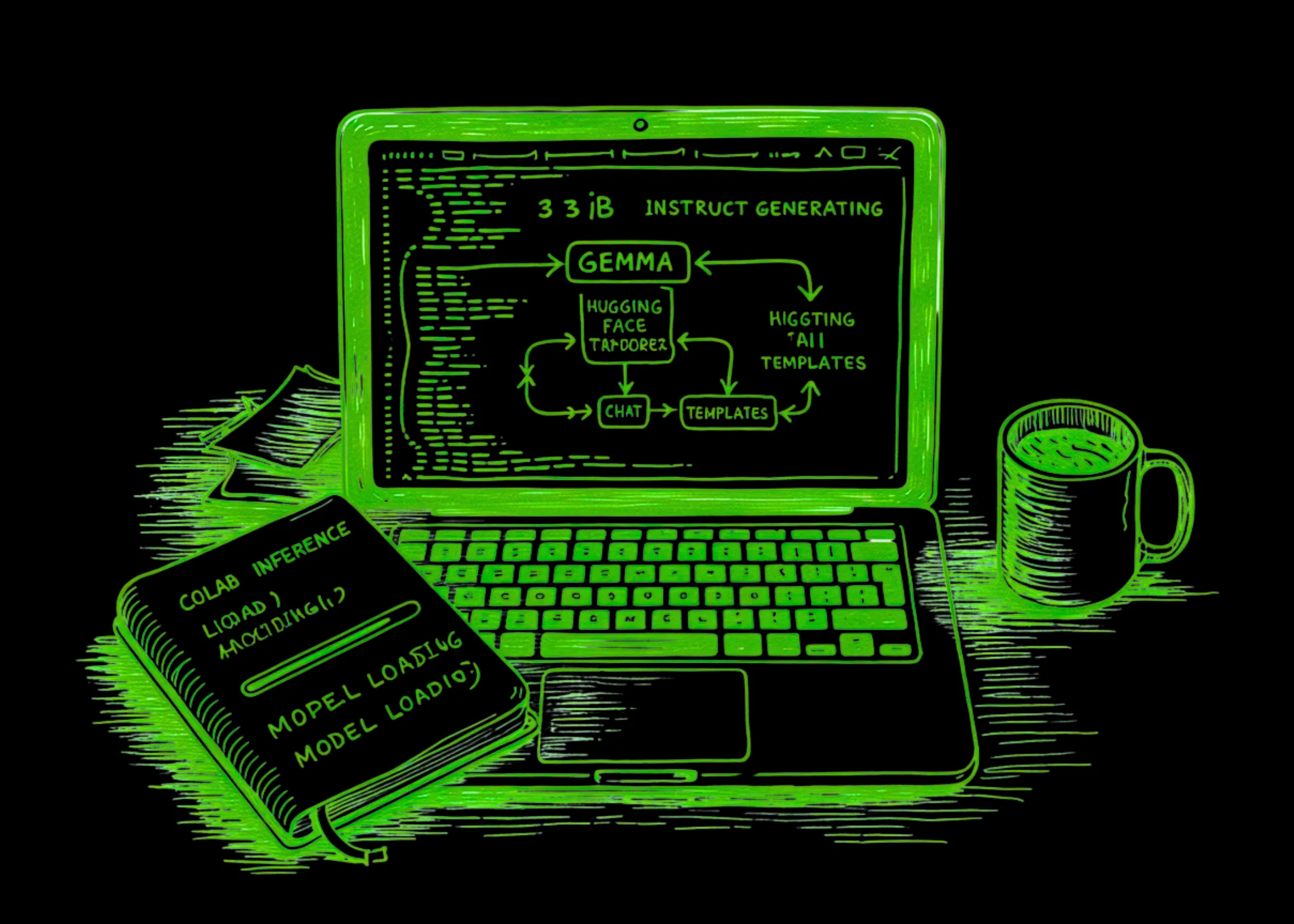

Cum să Construiești un Pipeline de Generare AI cu Gemma 3 1B Instruct Pregătit pentru Producție,folosind Hugging Face Transformers, Șabloane de Chat și Inferență pe Colab

Ghid comprehensiv pentru construirea unui pipeline de generare AI production-ready cu modelul Gemma 3 1B Instruct, folosind Hugging Face Transformers, șabloane de chat și inferență pe Google Colab.

Reachy Mini – Robotul Open-Source care Democratizează Inteligența Artificială și Interacțiunea Om-Mașină

Reachy Mini, un robot open-source rezultat din colaborarea dintre Pollen Robotics și Hugging Face, democratizează accesul la robotică și AI. Cu un preț de pornire de 299$, capabilități multimodale și o comunitate activă, acesta este gata să devină noul standard pentru dezvoltatorii și entuziaștii din întreaga lume.

Construirea serverului MCP Hugging Face: O călătorie tehnică prin standardul de conectare a asistenților AI

Echipa Hugging Face detaliază procesul de construire a unui server MCP (Model Context Protocol) remote, explicând alegerile tehnice dintre transportele STDIO, SSE și Streamable HTTP, și argumentând decizia de a utiliza o configurație Stateless cu Direct Response pentru scalabilitate și eficiență în accesul la Hub.

ScreenEnv: Revoluționarea automatizării desktop prin agenți AI – Mediu sandboxat, control total și integrare flexibilă

ScreenEnv reprezintă o soluție inovatoare pentru automatizarea desktop și dezvoltarea agenților AI, oferind un mediu sandboxat complet care rulează în Docker. Cu control total asupra interfeței grafice și integrare flexibilă prin API direct sau MCP, instrumentul simplifică drastic procesul de creare a agenților capabili să execute sarcini complexe, deschizând calea către automatizarea cross-platform.

Migrarea platformei Hugging Face Hub de la Git LFS la Xet: O revoluție silențioasă în stocarea modelelor AI

Hugging Face a finalizat o migrare istorică și silențioasă de la Git LFS la Xet, afectând peste 1 milion de utilizatori și petabytes de date. Noua infrastructură asigură compatibilitatea retroactivă, transferuri ultra-rapide și o scalabilitate fără precedent pentru modelele AI.

Accelerarea implementării modelelor lingvistice mari (LLM) de pe Hugging Face prin NVIDIA NIM: O revoluție în infrastructura AI enterprise

NVIDIA anunță integrarea microserviciilor NIM cu platforma Hugging Face, deblocând accesul rapid la peste 100.000 de modele LLM. Soluția oferă un singur container Docker capabil să optimizeze automat implementarea, detectând arhitectura și selectând backend-ul ideal pentru performanță maximă.

Inferență rapidă cu LoRA pentru Flux utilizând Diffusers și PEFT: Ghid complet de optimizare

Un ghid tehnic detaliat despre optimizarea inferenței modelului Flux.1-Dev folosind LoRA, Diffusers și PEFT, acoperind strategii de la hotswapping fără recompilare până la rularea eficientă pe GPU-uri de consum precum RTX 4090.

TimeScope: Până unde poate ajunge înțelegerea video în modelele multimodale avansate?

TimeScope este un benchmark open-source care testează limitele reale ale modelelor AI în înțelegerea videoclipurilor de lungă durată, dezvăluind diferența dintre promisiunile de marketing și performanța efectivă în sarcini complexe de sinteză și raționament temporal.

Prezentarea noii interfețe `hf`: un CLI Hugging Face mai rapid și mai prietenos ✨

Hugging Face lansează un nou CLI, `hf`, înlocuind vechiul `huggingface-cli` cu o structură mai clară și intuitivă. Noul instrument aduce o organizare logică a comenzilor, suport pentru migrare și introduce serviciul Hugging Face Jobs pentru rularea de scripturi pe infrastructură dedicată, cu facturare pay-as-you-go.