În era inteligenței artificiale generative, construirea unui pipeline robust și scalabil pentru modelele de limbaj a devenit o competență esențială pentru dezvoltatorii și inginerii de machine learning. Modelul Gemma 3 1B Instruct de la Google reprezintă o alegere excelentă pentru această sarcină, oferind un echilibru optim între performanță computatională și calitatea output-urilor generate. În acest ghid comprehensiv, vom explora în profunzime procesul de construire a unui pipeline complet de generare AI, pornind de la configurarea mediului de lucru și până la implementarea inferenței într-un mediu cloud-ready.

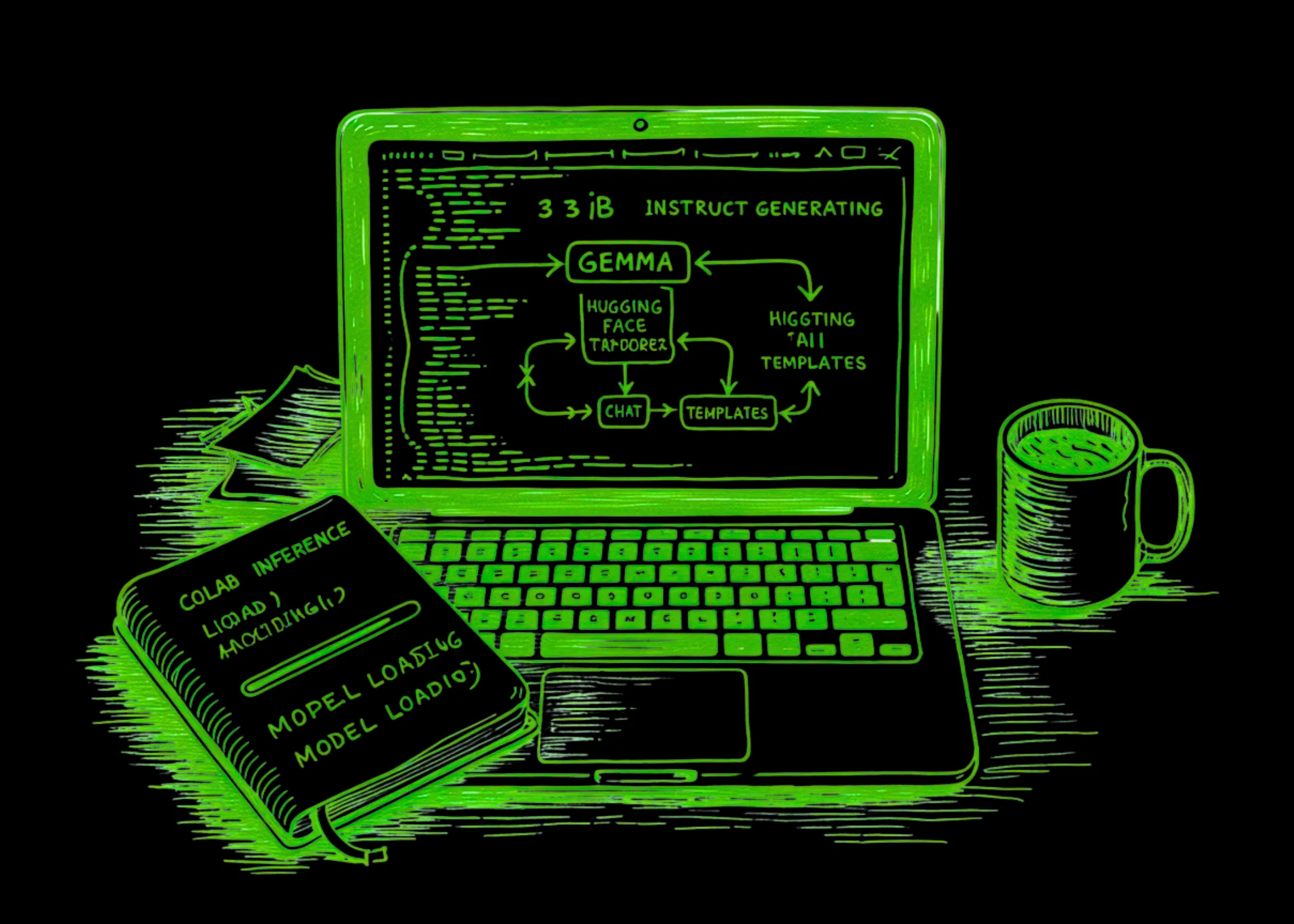

Primul pas fundamental în construirea acestui pipeline constă în configurarea corectă a mediului de dezvoltare. Vom utiliza biblioteca Hugging Face Transformers, care a devenit standardul industriei pentru lucrul cu modele de limbaj. Această bibliotecă oferă o interfață unificată și consistentă pentru sute de modele pre-învățate, inclusiv familia Gemma de la Google. Este esențial să ne asigurăm că avem versiunile corecte ale dependențelor instalate, în special torch, transformers și accelerate, pentru a evita conflictele de compatibilitate care pot apărea între diferite versiuni ale bibliotecilor.

Configurarea tokenizerului reprezintă un aspect critic în construirea pipeline-ului. Modelul Gemma 3 utilizează un tokenizer specializat, optimizat pentru multitasking-ul lingvistic. Acest tokenizer gestionează nu doar tokenizarea textului, ci și aplicarea corectă a șabloanelor de chat, care sunt esențiale pentru funcționarea corectă a modului instruct. Șabloanele de chat definesc structura conversațională în care modelul a fost antrenat, incluzând rolurile utilizatorului, asistentului și, opțional, ale altor participanți în conversație.

Implementarea corectă a șabloanelor de chat reprezintă diferența cheie între un model care generează răspunsuri mediocre și unul care produce output-uri de înaltă calitate. În contextul modelelor instruct, modul în care formulăm promptul poate influența dramatic calitatea și relevanța răspunsurilor generate. Vom explora în detaliu cum să aplicăm manual aceste șabloane, asigurându-ne că fiecare componentă a conversației este formatată corect, de la identificatorii de rol până la separatori și tokenii speciali care ghidează comportamentul modelului.

Structura unui șablon de chat pentru Gemma 3 include de obicei un sistem prompt care stabilește contextul și comportamentul așteptat al modelului, urmat de mesajele alternante ale utilizatorului și ale asistentului. Este crucial să înțelegem că modelul a fost antrenat să recunoască aceste structuri specifice, iar orice deviere poate duce la răspunsuri neconforme sau la comportamente nedorite. Vom analiza cum să construim aceste șabloane în mod programatic, astfel încât să le putem integra seamless în pipeline-ul nostru.

Configurarea parametriilor de generare reprezintă un alt aspect vital pe care îl vom aborda extensiv. Parametri precum temperature, top_p, top_k și max_new_tokens influențează direct caracterul și lungimea output-urilor generate. Alegerea valorilor potrivite pentru acești parametri depinde în mare măsură de cazul de utilizare specific. Pentru sarcini care necesită creativitate, vom utiliza o temperatură mai ridicată, în timp ce pentru sarcini care cer acuratețe și consistență, vom prefera valori mai conservatoare. Vom explora diferite combinații și vom înțelege cum fiecare parametru afectează procesul de generare.

Implementarea inferenței pe Google Colab oferă avantajul semnificativ al accesului la resurse GPU gratuite sau la cost redus, făcând dezvoltarea și testarea pipeline-ului accesibilă pentru o gamă largă de utilizatori. Colab oferă suport nativ pentru bibliotecile de deep learning și permite configurarea rapidă a mediului de lucru. Vom parcurge pașii de configurare a runtime-ului, inclusiv selectarea tipului de accelerator GPU și instalarea dependențelor necesare, asigurându-ne că avem resursele computationale adecvate pentru rularea modelului Gemma 3 1B.

Optimizarea performanței este un aspect pe care nu îl putem ignora când construim un pipeline destinat producției. Deși modelul Gemma 3 1B este compact comparativ cu variantele mai mari, inferența eficientă necesită totuși tehnici de optimizare. Vom explora utilizarea cuantificării pentru a reduce amprenta de memorie, tehnica de batching pentru îmbunătățirea throughput-ului și caching-ul pentru evitarea recalculărilor redundante. Aceste optimizări sunt esențiale pentru deployment în producție, unde eficiența costurilor și timpul de răspuns sunt factori critici.

Gestionarea memoriei reprezintă o provocare constantă în lucrul cu modele de limbaj. Vom discuta despre strategii precum gradient checkpointing, care permite reducerea consumului de memorie în timpul inferenței, și despre importanța curățării corecte a cache-ului GPU pentru a preveni scurgerile de memorie. Aceste aspecte devin cruciale mai ales când pipeline-ul trebuie să deservească multiple cereri simultan sau să proceseze conversații lungi.

Aspectele de securitate și moderare a conținutului sunt, de asemenea, esențiale pentru orice pipeline de generare AI destinat producției. Deși modelele instruct vin cu mecanisme de siguranță integrate, este responsabilitatea dezvoltatorului să implementeze straturi suplimentare de protecție. Vom discuta despre tehnici de filtrare a output-urilor, detectarea conținutului sensibil și stabilirea limitelor pentru tipurile de cereri acceptate. Aceste măsuri sunt cruciale pentru conformitatea cu reglementările în vigoare și pentru protejarea utilizatorilor finali.

Testarea și validarea pipeline-ului reprezintă etapa finală și poate cea mai importantă înainte de deployment. Vom crea un set comprehensiv de teste care acoperă diverse scenarii de utilizare, de la întrebări simple la conversații complexe și multi-turn. Evaluarea calității output-urilor poate include metrici automate precum perplexitate și ROUGE, dar și evaluări umane pentru aspecte precum fluența, acuratețea și relevanța contextuală. Un pipeline robust trebuie să gestioneze elegant cazurile de eroare și să ofere feedback util pentru debugging.

Integrarea în sisteme de producție necesită considerații suplimentare legate de monitoring, logging și scalabilitate. Vom discuta despre importanța logării corecte a input-urilor și output-urilor pentru debugging și audit, despre metrici de performanță precum latența și throughput-ul, și despre strategiile de scaling orizontal și vertical. Un pipeline cu adevărat pregătit pentru producție trebuie să poată fi monitorizat în timp real și să se auto-scaleze în funcție de cerere.

Concluzionând, construirea unui pipeline de generare AI cu Gemma 3 1B Instruct implică multiple straturi de complexitate, de la configurarea tehnică de bază până la considerații avansate de producție. Acest ghid oferă fundamentul necesar pentru dezvoltatorii care doresc să implementeze soluții AI generative robuste și scalabile, punând accent pe bunele practici și pe arhitectura modulară care facilitează mentenanța și extinderea ulterioară a sistemului.

Cum să Construiești un Pipeline de Generare AI cu Gemma 3 1B Instruct Pregătit pentru Producție,folosind Hugging Face Transformers, Șabloane de Chat și Inferență pe Colab