Subiect: #Inferență AI

AI

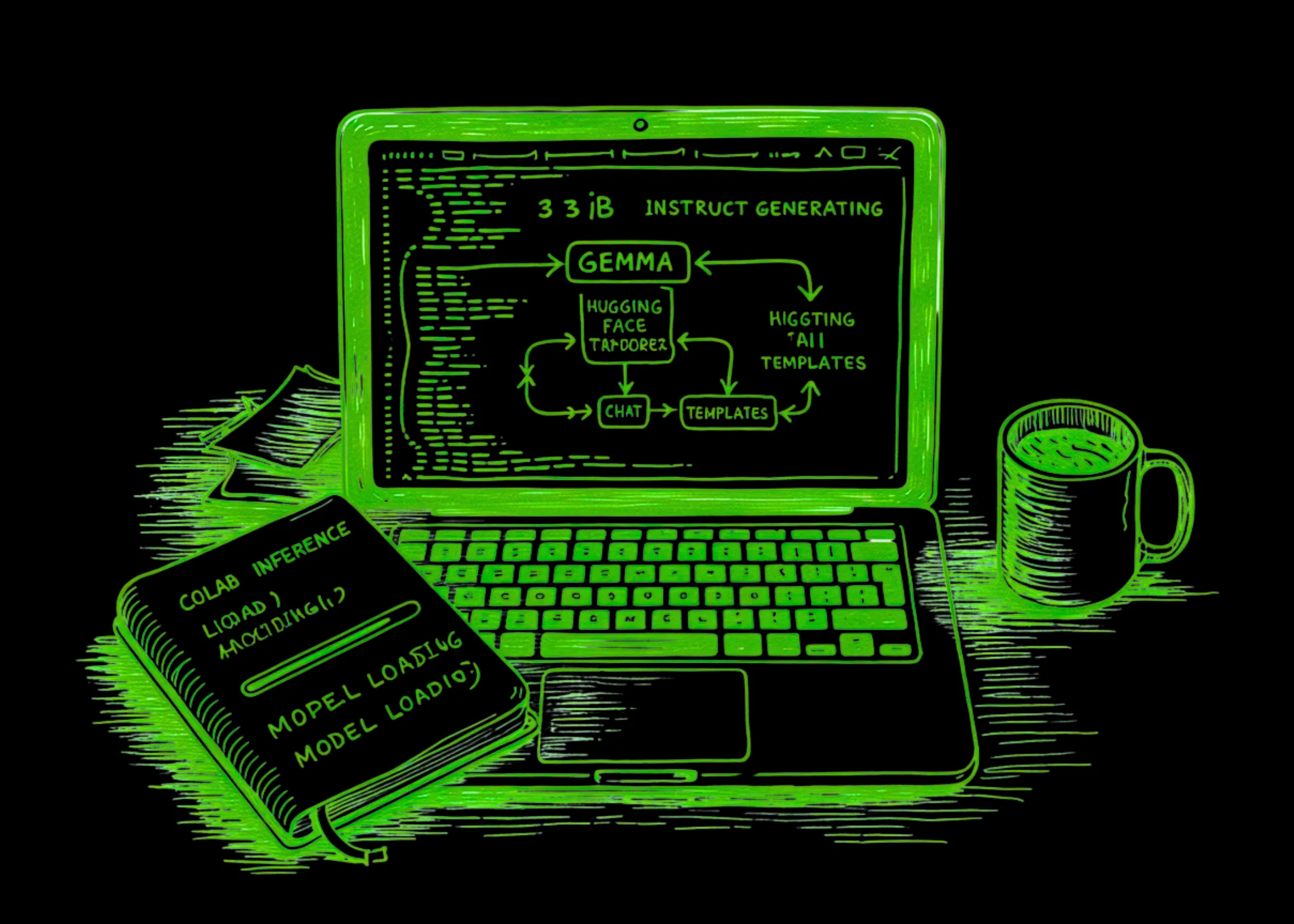

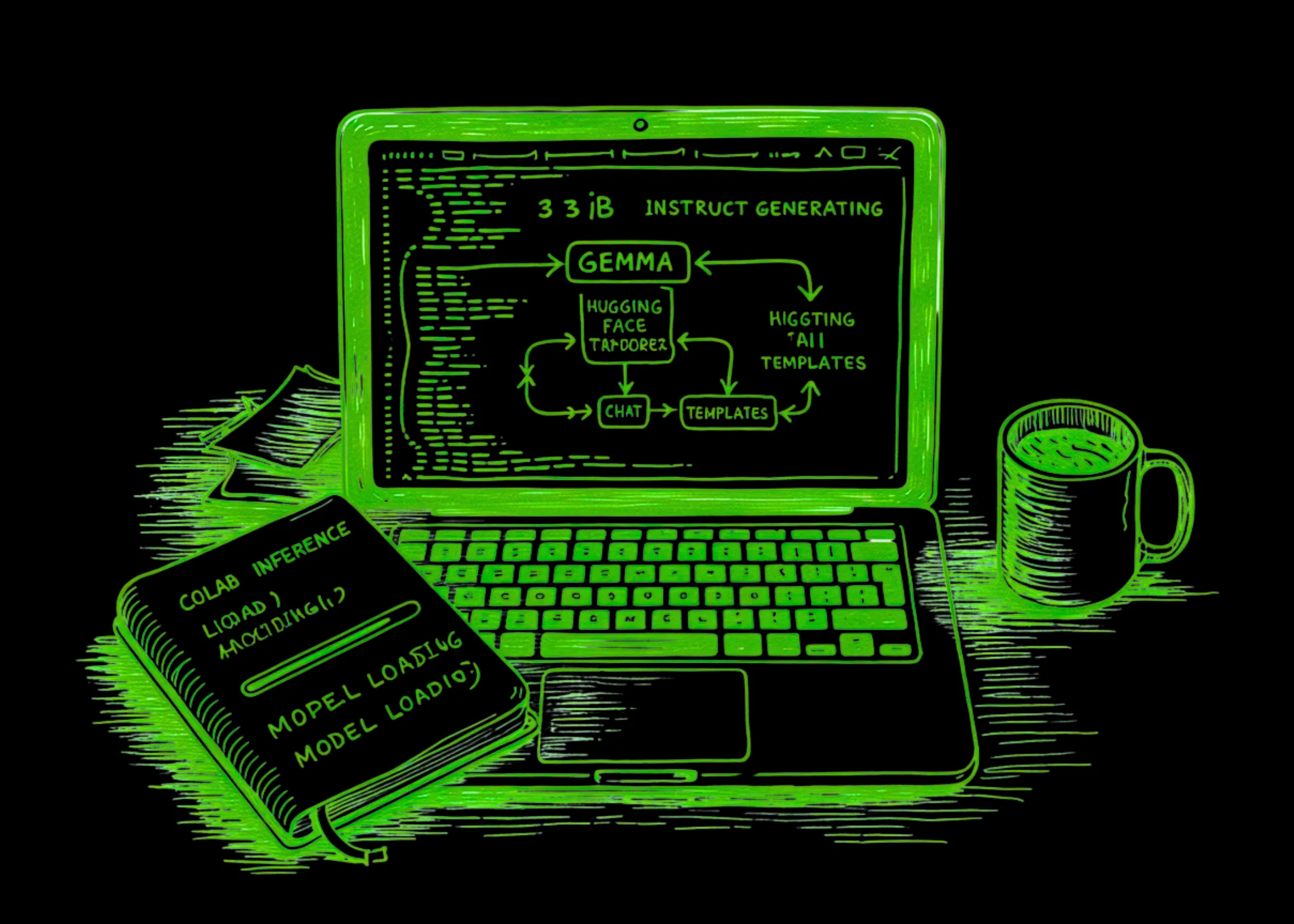

Cum să Construiești un Pipeline de Generare AI cu Gemma 3 1B Instruct Pregătit pentru Producție,folosind Hugging Face Transformers, Șabloane de Chat și Inferență pe Colab

Ghid comprehensiv pentru construirea unui pipeline de generare AI production-ready cu modelul Gemma 3 1B Instruct, folosind Hugging Face Transformers, șabloane de chat și inferență pe Google Colab.

AI

Accelerarea implementării modelelor lingvistice mari (LLM) de pe Hugging Face prin NVIDIA NIM: O revoluție în infrastructura AI enterprise

NVIDIA anunță integrarea microserviciilor NIM cu platforma Hugging Face, deblocând accesul rapid la peste 100.000 de modele LLM. Soluția oferă un singur container Docker capabil să optimizeze automat implementarea, detectând arhitectura și selectând backend-ul ideal pentru performanță maximă.