Subiect: #Transformers

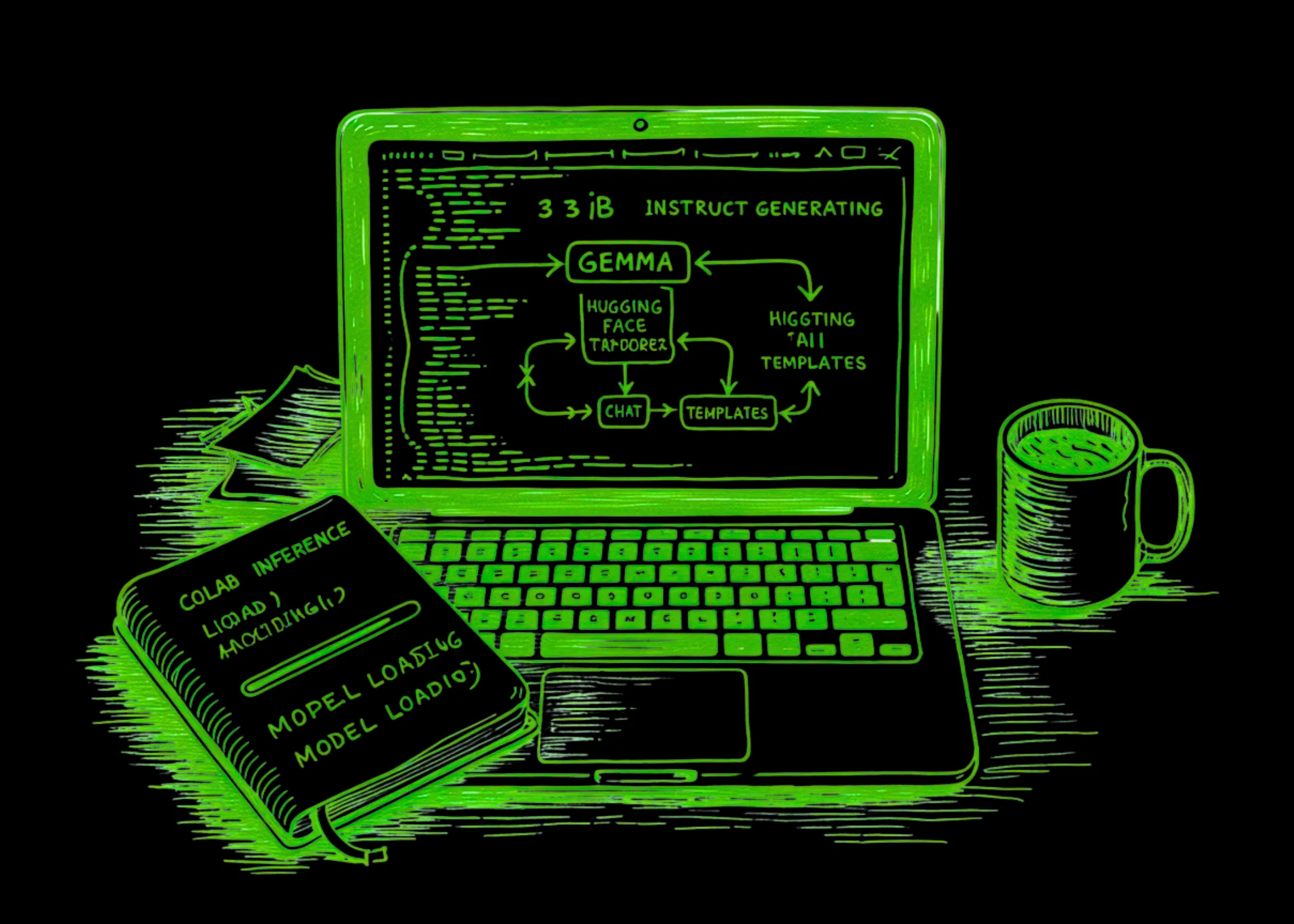

Cum să Construiești un Pipeline de Generare AI cu Gemma 3 1B Instruct Pregătit pentru Producție,folosind Hugging Face Transformers, Șabloane de Chat și Inferență pe Colab

Ghid comprehensiv pentru construirea unui pipeline de generare AI production-ready cu modelul Gemma 3 1B Instruct, folosind Hugging Face Transformers, șabloane de chat și inferență pe Google Colab.

Trucuri de la OpenAI gpt-oss pe care TU 🫵 le poți utiliza cu transformers

Lansarea GPT-OSS de la OpenAI aduce o serie de inovații tehnice în ecosistemul open-source. Acest articol explorează integrarea acestora în biblioteca `transformers`, de la kernel-e zero-build și Flash Attention 3, până la cuantizarea MXFP4 și paralelismul tensorial, oferind un ghid detaliat pentru optimizarea inferenței modelelor de limbaj de mari dimensiuni.

Mixture of Experts (MoE) în Transformers: O Revoluție în Arhitectura Modelelor de Limbaj

Modelele Mixture of Experts (MoE) revoluționează AI-ul prin decuplarea capacității de învățare de costul computațional. Acest articol explorează integrarea lor în Transformers, de la refactorizarea încărcării greutăților și materializarea leneșă a tensorilor, până la backend-uri optimizate și paralelismul experților.