Subiect: #Hugging Face

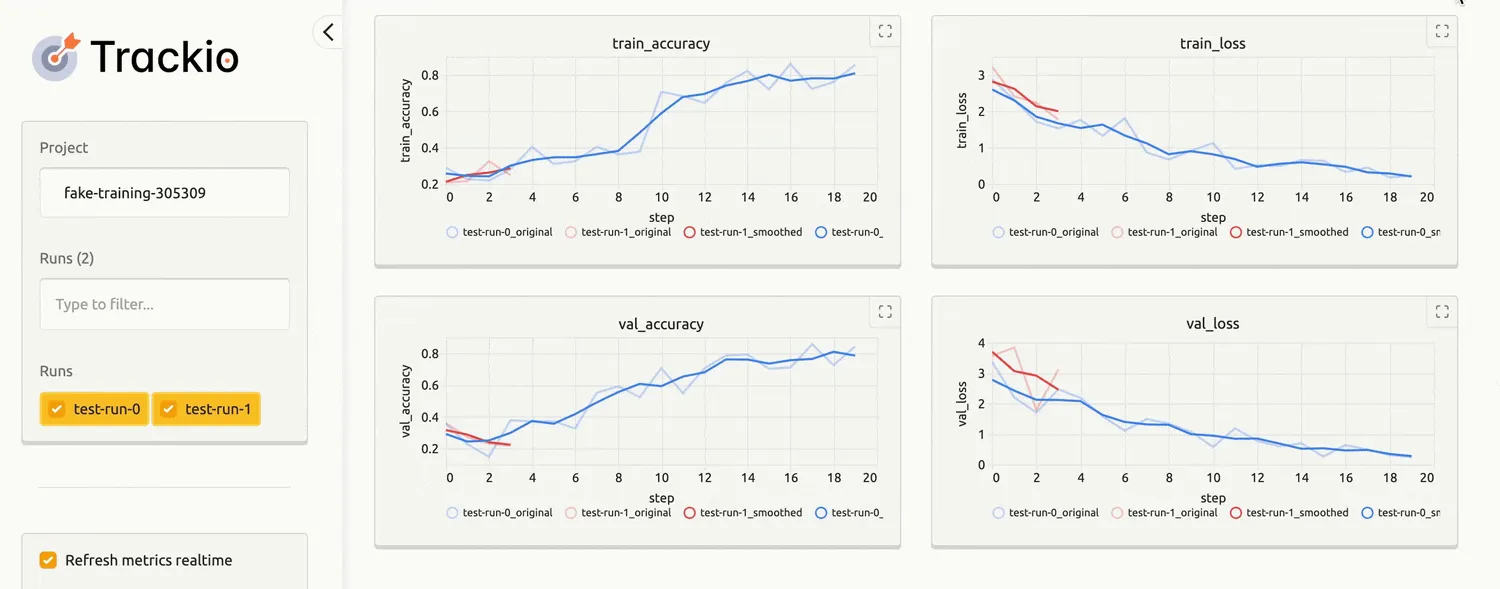

Prezentare Trackio: O bibliotecă ușoară pentru urmărirea experimentelor de la Hugging Face

Hugging Face lansează Trackio, o bibliotecă Python open-source și ușoară pentru urmărirea experimentelor de machine learning, oferind o alternativă gratuită și flexibilă, cu integrare nativă în ecosistemul Hugging Face și focus pe transparență și simplitate.

NVIDIA AI-Q și modelele Llama Nemotron: O nouă eră pentru agenții de cercetare open-source

NVIDIA AI-Q Blueprint, un agent de cercetare profund open-source, a atins performanțe de top pe DeepResearch Bench, demonstrând că modelele deschise pot depăși alternativele proprietare. Arhitectura combină modelele Llama 3.3 și Nemotron pentru a oferi raționament complex, transparență totală și implementare flexibilă.

Bun venit GPT OSS, noua familie de modele open-source de la OpenAI!

OpenAI lansează familia de modele GPT OSS sub licență Apache 2.0, marcând un angajament major față de comunitatea open-source. Cu arhitecturi MoE eficiente de 21B și 117B parametri, optimizări precum cuantizarea mxfp4 și Flash Attention 3, modelele pot rula local pe GPU-uri consumer, democratizând accesul la AI de ultimă generație.

Accelerate ND-Parallel: Ghid complet pentru antrenarea eficientă pe mai multe GPU-uri

Pe măsură ce modelele de inteligență artificială cresc la dimensiuni de zeci sau sute de miliarde de parametri, provocarea principală devine gestionarea memoriei și comunicarea între dispozitive. Acest ghid explorează strategiile de paralelism — de la Data Parallelism la tehnici avansate precum Tensor Parallelism și Fully Sharded Data Parallelism — oferind o perspectivă detaliată asupra modului în care acestea pot fi combinate pentru a optimiza antrenarea modelelor la scară largă.

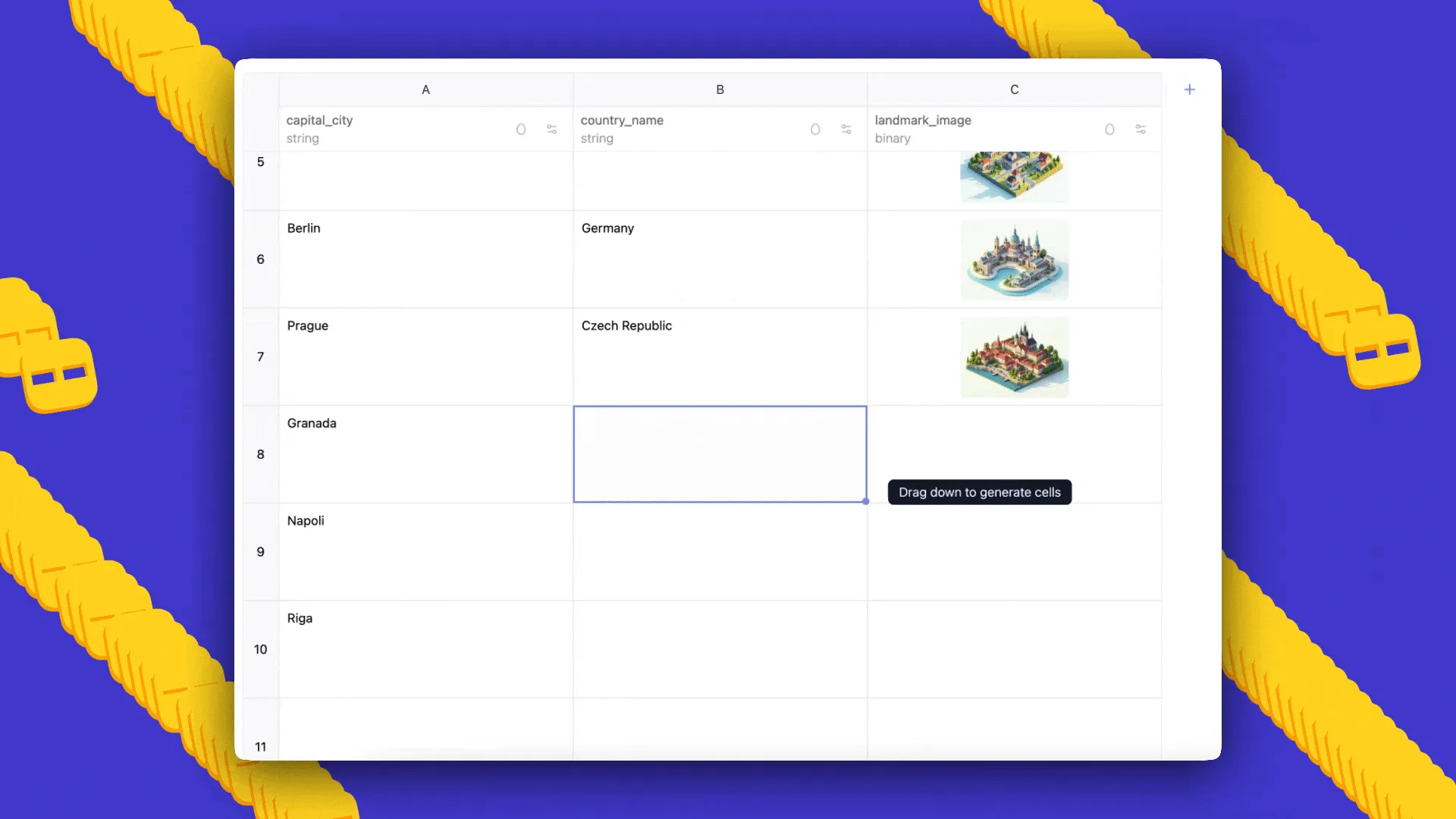

Prezentare AI Sheets: O revoluție în manipularea seturilor de date prin modele AI open-source

Hugging Face lansează AI Sheets, o unealtă revoluționară de tip „no-code” care permite construirea, transformarea și îmbogățirea seturilor de date folosind modele AI open-source, direct dintr-o interfață intuitivă de tip spreadsheet.

MCP pentru Cercetare: Conectarea Inteligenței Artificiale la Instrumentele de Cercetare

Protocolul Model Context (MCP) revoluționează descoperirea științifică, permițând sistemelor AI să utilizeze instrumente de cercetare prin limbaj natural. Articolul explorează cele trei straturi de abstracție în cercetare: manuală, scriptată și integrarea MCP, subliniind trecerea de la efortul repetitiv la o orchestrare inteligentă a informațiilor.

Generarea imaginilor cu Claude și Hugging Face: Ghid complet pentru utilizarea modelelor AI de ultimă generație

Un ghid complet pentru generarea imaginilor folosind integrarea dintre Claude și Hugging Face. Aflați cum să configurați și să utilizați modelele Flux.1 Krea Dev pentru imagini fotorealiste și Qwen-Image pentru design grafic cu text integrat, direct din interfața de chat a lui Claude.

Optimizarea spațiilor ZeroGPU prin compilarea ahead-of-time: Ghid complet pentru performanță maximă

Compilarea ahead-of-time (AoT) revoluționează performanța modelelor ML în spațiile ZeroGPU de la Hugging Face, eliminând timpii de pornire la rece și oferind accelerări de 1.3×-1.8×. Acest ghid detaliază implementarea tehnică, de la capturarea intrărilor până la integrarea în pipeline, explorând și tehnici avansate precum cuantizarea FP8 și FlashAttention-3.

SAIR: Revoluționarea cercetării farmaceutice prin inteligență artificială și inteligență structurală

Datasetul SAIR reprezintă o inovație majoră în cercetarea farmaceutică, oferind peste 5 milioane de structuri 3D proteine-ligand, validate și disponibile gratuit sub licență open-source, cu scopul de a accelera descoperirea medicamentelor prin inteligență artificială.

EmbeddingGemma: Noul model de embedding eficient de la Google revoluționează căutarea semantică pe dispozitive mobile

Google lansează EmbeddingGemma, un model de embedding multilingv de 308M parametri, optimizat pentru dispozitive mobile și performanță de top în căutarea semantică și RAG.

Together AI și Hugging Face revoluționează antrenarea modelelor: Acum poți adapta orice LLM în doar câteva minute

Parteneriatul dintre Together AI și Hugging Face permite dezvoltatorilor să efectueze fine-tuning pe orice model LLM compatibil direct prin infrastructura cloud, eliminând complexitatea tehnică și reducând timpul de la descoperire la implementare la doar câteva minute.

Trucuri de la OpenAI gpt-oss pe care TU 🫵 le poți utiliza cu transformers

Lansarea GPT-OSS de la OpenAI aduce o serie de inovații tehnice în ecosistemul open-source. Acest articol explorează integrarea acestora în biblioteca `transformers`, de la kernel-e zero-build și Flash Attention 3, până la cuantizarea MXFP4 și paralelismul tensorial, oferind un ghid detaliat pentru optimizarea inferenței modelelor de limbaj de mari dimensiuni.