Subiect: #Parallel Computing

Accelerate ND-Parallel: Ghid complet pentru antrenarea eficientă pe mai multe GPU-uri

Pe măsură ce modelele de inteligență artificială cresc la dimensiuni de zeci sau sute de miliarde de parametri, provocarea principală devine gestionarea memoriei și comunicarea între dispozitive. Acest ghid explorează strategiile de paralelism — de la Data Parallelism la tehnici avansate precum Tensor Parallelism și Fully Sharded Data Parallelism — oferind o perspectivă detaliată asupra modului în care acestea pot fi combinate pentru a optimiza antrenarea modelelor la scară largă.

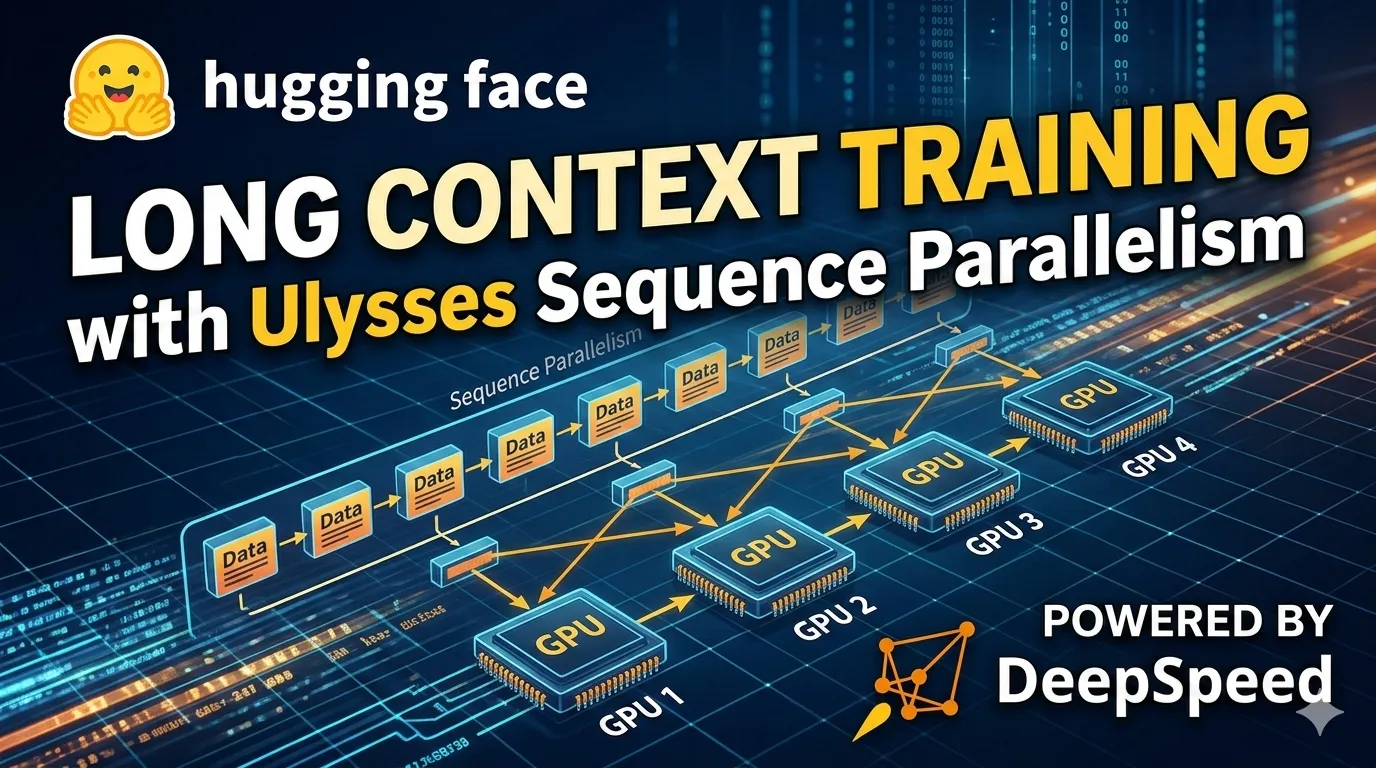

Paralelismul de Secvență Ulysses: Antrenarea modelelor AI cu contexte de un milion de token-uri

Ulysses Sequence Parallelism oferă o soluție revoluționară pentru antrenarea modelelor AI cu contexte de milioane de token-uri, distribuind calculul atenției pe multiple GPU-uri prin paralelismul capetelor de atenție, integrată acum complet în ecosistemul Hugging Face.