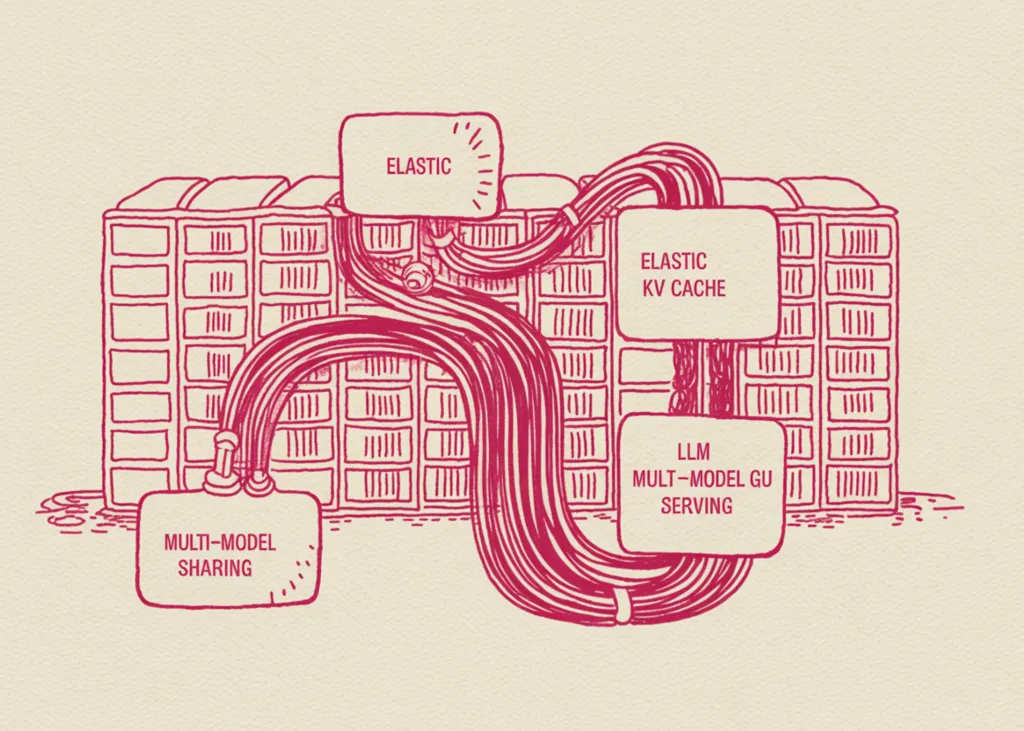

Ce este memoria cache KV și de ce este importantă?

În arhitectura modelelor de tip transformer, memoria cache KV joacă un rol crucial în accelerarea generării textului. Atunci când un LLM generează răspunsuri, el procesează secvențe de tokeni. Pentru a evita recalcularea constantă a stărilor intermediare, modelul stochează perechile cheie-valoare (Key-Value) ale straturilor de atenție. Această cache permite ca, la fiecare pas de generare, modelul să reutilizeze informațiile deja calculate, reducând semnificativ latența și consumul de resurse.

Problema apare atunci când mai multe cereri concurente sau modele diferite încearcă să acceseze aceeași memorie GPU. Cache-ul KV poate ocupa o cantitate mare de memorie, iar gestionarea ineficientă duce la fragmentare, alocări costisitoare și, în cele din urmă, la scăderea performanței. În plus, în scenarii cu trafic exploziv (de exemplu, vârfuri de cereri în timpul unor evenimente), sistemul trebuie să se scaleze rapid, fără a compromite timpii de răspuns.

kvcached: O soluție elastică și eficientă

kvcached este o bibliotecă open-source (sau un modul) care implementează un cache KV distribuit și elastic, special conceput pentru servirea LLM-urilor. Principalele sale caracteristici includ:

Implementare cod: Cum funcționează kvcached?

Să analizăm o implementare simplificată a conceptelor din spatele kvcached. Vom folosi Python și PyTorch pentru a ilustra ideile principale.

1. Gestionarea memoriei cache

În loc să alocăm un tensor fix pentru cache, putem folosi un pool de memorie prealocat, din care extragem segmente după necesități. De exemplu:

```python

import torch

from collections import OrderedDict

class ElasticKVCache:

def init(self, max_size_gb=4, device='cuda'):

self.device = device

self.max_size = max_size_gb 1024*3 # în bytes

self.pool = torch.empty(self.max_size, dtype=torch.uint8, device=device)

self.offset = 0

self.cache = OrderedDict() # cheie -> (offset, dimensiune)

def allocate(self, key, size_bytes):

if self.offset + size_bytes > self.max_size:

# Evacuare LRU

while self.offset + size_bytes > self.max_size and self.cache:

oldest_key, (old_offset, old_size) = self.cache.popitem(last=False)

self.offset = old_offset # eliberăm spațiu (simplificat)

offset = self.offset

self.offset += size_bytes

self.cache[key] = (offset, size_bytes)

return offset

```

Aceasta este o versiune simplistă; în realitate, kvcached folosește alocări mai sofisticate și suportă fragmentare.

2. Cache distribuit pentru mai multe modele

Pentru partajarea între modele, putem introduce un strat de abstractizare care mapează fiecare model la un subset din cache. De exemplu, putem asocia fiecare model cu un ID și putem stoca cache-ul într-un dicționar global:

```python

class MultiModelCache:

def init(self):

self.caches = {} # model_id -> ElasticKVCache

def get_cache(self, model_id):

if model_id not in self.caches:

self.caches[model_id] = ElasticKVCache()

return self.caches[model_id]

```

3. Gestionarea traficului exploziv

Pentru a face față vârfurilor de cereri, kvcached implementează un mecanism de prefetch: atunci când un token este procesat, se estimează următorii tokeni și se încarcă în cache în avans. De asemenea, se pot folosi cozi de așteptare și prioritizare.

```python

import asyncio

class BurstyHandler:

def init(self, cache):

self.cache = cache

self.queue = asyncio.Queue()

async def process_request(self, request):

# Simulare procesare

key = request['key']

size = request['size']

offset = self.cache.allocate(key, size)

# ... scriere date în cache

return offset

```

Beneficii și aplicații practice

Implementarea kvcached aduce multiple avantaje:

Provocări și considerații

Desigur, implementarea unui astfel de sistem nu este lipsită de provocări. Printre acestea se numără:

Concluzie

kvcached reprezintă un pas important în direcția eficientizării servirii modelelor de limbaj. Prin combinarea elasticității, suportului pentru trafic exploziv și partajării multi-model, această implementare oferă o soluție robustă pentru aplicațiile moderne de AI. Pe măsură ce cererea pentru LLM-uri continuă să crească, instrumente precum kvcached vor deveni din ce în ce mai esențiale pentru a menține performanța și a reduce costurile.

De ce este important:

Într-o eră în care inteligența artificială generativă devine omniprezentă, optimizarea resurselor hardware este crucială. kvcached nu doar că îmbunătățește performanța, dar și democratizează accesul la modele mari, permițând chiar și organizațiilor cu bugete reduse să ruleze inferențe complexe. Înțelegerea și implementarea unor astfel de tehnici este vitală pentru orice dezvoltator sau inginer care lucrează cu LLM-uri la scară.