Sfârșitul Chatbot-urilor și Ascensiunea Agenților

Pentru mai mulți ani, standardul de facto în industrie a fost formatul „Chat Completion”. Acesta a fost conceput pentru o lume în care interacțiunea era simplă: un utilizator pune o întrebare, modelul răspunde. Totuși, cerințele moderne depășesc cu mult acest cadru limitat. Dezvoltatorii se orientează acum spre sisteme autonome care trebuie să raționeze pe orizonturi lungi de timp, să planifice acțiuni complexe și să execute sarcini multi-eta. Formatul tradițional eșuează în a susține aceste fluxuri de lucru „agentic”, fiind construit pentru conversații fragmentate, nu pentru acțiuni continue și autonome.

Deși OpenAI a lansat API-ul „Responses” în martie 2025 pentru a aborda aceste limitări, soluția lor a rămas una închisă (proprietary), limitând adoptarea și interoperabilitatea. Aici intervine Open Responses: o inițiativă de a extinde și a open-source acest concept, creând un standard deschis care să unifice ecosistemul fragmentat de astăzi.

Ce este Open Responses?

Open Responses reprezintă o specificație deschisă care extinde API-ul Responses, făcându-l accesibil pentru o gamă largă de furnizori și dezvoltatori. Scopul său principal este de a permite interoperabilitatea între diverși furnizori de inferență și sistemele de rutare, eliminând barierele tehnice care împiedică colaborarea. Este un răspuns direct la nepotrivirea dintre cerințele fluxurilor de lucru agentice și interfețele învechite care domină încă piața.

Arhitectura Tehnică: Cum funcționează

Pentru a înțelege amploarea acestei inovații, trebuie să ne uităm la detaliile de implementare. Open Responses nu este doar o simplă actualizare, ci o restructurare a modului în care cererile sunt formulate și procesate.

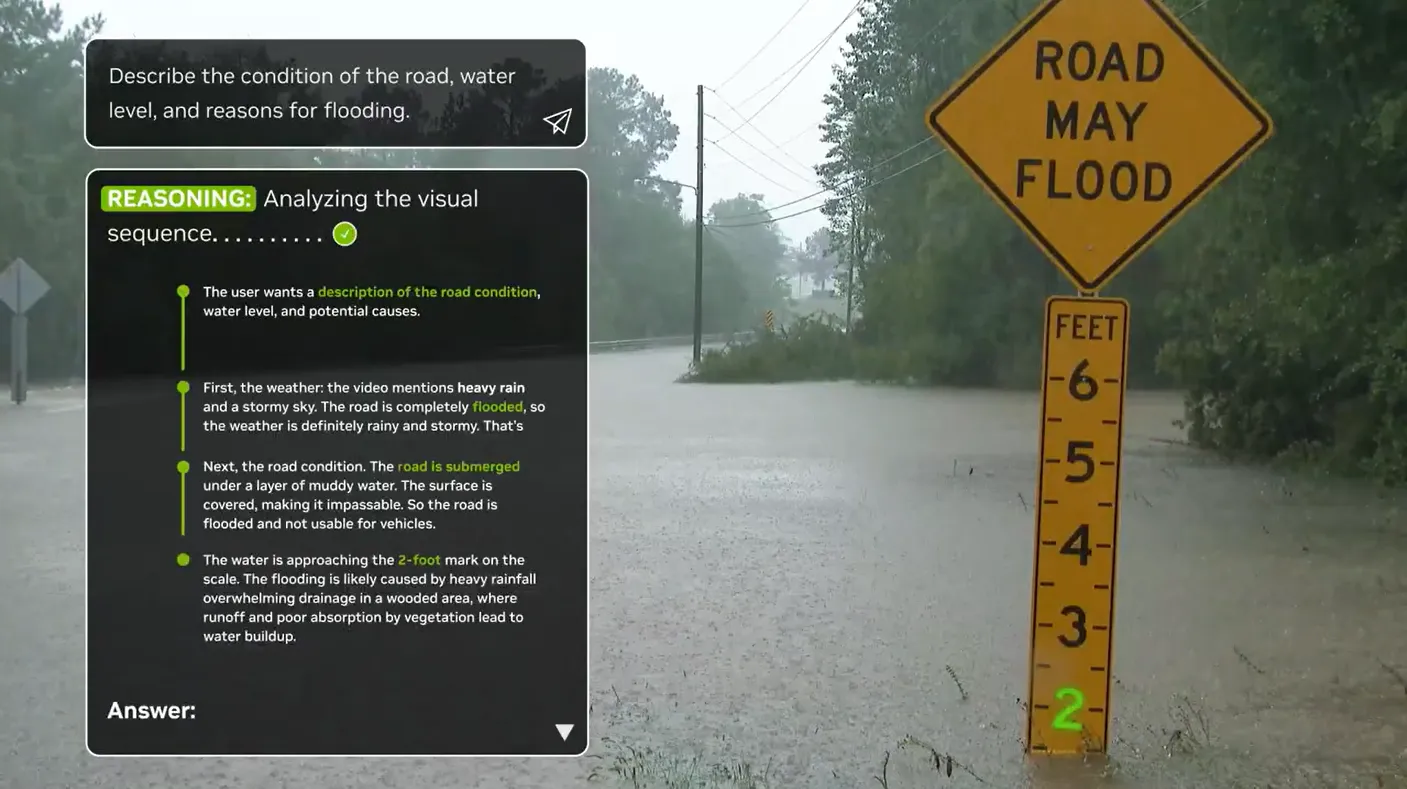

1. Cereri și Răspunsuri Standardizate: Migrația la Open Responses este concepută pentru a fi fluidă. Pentru clienții care suportă deja API-ul Responses, tranziția necesită eforturi minime. Totuși, există o schimbare fundamentală în modul în care este expus conținutul de raționament (reasoning content). Spre deosebire de modelele anterioare care returnau doar sumare sau conținut criptat, Open Responses permite furnizorilor să expună raționamentul brut (raw reasoning) prin API. Aceasta oferă o transparență fără precedent, permițând dezvoltatorilor să înțeleagă „gândirea” modelului în timp real.

2. Diferențierea Raționamentului: Să ne imaginăm un scenariu în care un agent trebuie să recomande un restaurant. În formatul clasic, utilizatorul primea doar recomandarea finală. Cu Open Responses, fluxul de date include evenimente distincte. Modelele cu greutate deschisă (open weight) pot streama raționamentul brut: „Utilizatorul a întrebat: 'Unde să mănânc...' Pasul 1: Analizez locația...”. Această granularitate permite depanarea și optimizarea agenților într-un mod care era imposibil până acum.

Rutarea și Ecosistemul Furnizorilor

Open Responses introduce o distincție clară și necesară între „Furnizorii de Modele” (cei care oferă inferența) și „Routere” (intermediarii care orchestrează cererile între mai mulți furnizori). Această arhitectură permite clienților să specifice nu doar modelul dorit, ci și furnizorul și opțiunile specifice de API. Ruterele pot astfel să standardizeze un endpoint consistent, facilitând o piață competitivă și flexibilă. Pe măsură ce furnizorii inovează, aceste caracteristici vor fi standardizate în specificația de bază, normalizând experiența de inferență și eliminând „hack-urile” și soluțiile temporare ale API-urilor legacy.

Instrumente Native: Internale vs. Externale

O altă inovație majoră o reprezintă suportul nativ pentru două categorii de instrumente (tools):

Buclele Sub-Agent (Sub Agent Loops) și Autonomia

Poate cea mai puternică caracteristică a Open Responses este formalizarea „buclei agentice”. În natură, un agent nu acționează o singură dată; el intră într-un ciclu repetitiv de raționament, invocare de instrumente și generare de răspunsuri. Open Responses permite ca acest ciclu să fie gestionat de furnizor pentru instrumentele internale.

Să luăm un exemplu concret: un utilizator cere „Găsește datele de vânzări din trimestrul 3 și trimite un rezumat pe email echipei”. În trecut, acest lucru ar fi necesitat multiple cereri API și o orchestrare complexă din partea clientului. Cu Open Responses, acest lucru se întâmplă într-o singură cerere. Modelul caută documentele, rezumă, și redactează email-ul, returnând toate etapele intermediare (apeluri de instrumente, rezultate, raționament) într-un singur flux. Dezvoltatorii pot controla acest comportament prin parametri precum `max_tool_calls` (pentru a limita iterațiile) și `tool_choice` (pentru a constrânge ce instrumente sunt disponibile).

Viitorul Inferenței Deschise

Open Responses nu este doar un standard tehnic; este o promisiune a unui viitor mai deschis și mai colaborativ. Prin oferirea unor definiții de conținut mai bogate și opțiuni de implementare flexibile, acesta deschide calea pentru aplicații AI cu adevărat puternice. Colaborarea cu comunitatea și furnizorii de inferență, cum ar fi Hugging Face, va asigura că acest standard evoluează pentru a întâmpina nevoile reale ale dezvoltatorilor.

În concluzie, pe măsură ce asistăm la trecerea de la modele pasive la agenți activi, standardele precum Open Responses devin infrastructura critică necesară pentru a susține această nouă eră. Pentru dezvoltatorii care folosesc endpoint-uri locale (precum vLLM), următorul pas logic va fi suportul pentru instrumente găzduite, un model care promite să democratizeze capacitățile agenților avansați. Open Responses este astăzi disponibil în versiune timpurie pe Hugging Face Spaces, invitând comunitatea să testeze și să contribuie la viitorul inferenței AI.