Subiect: #Inferență

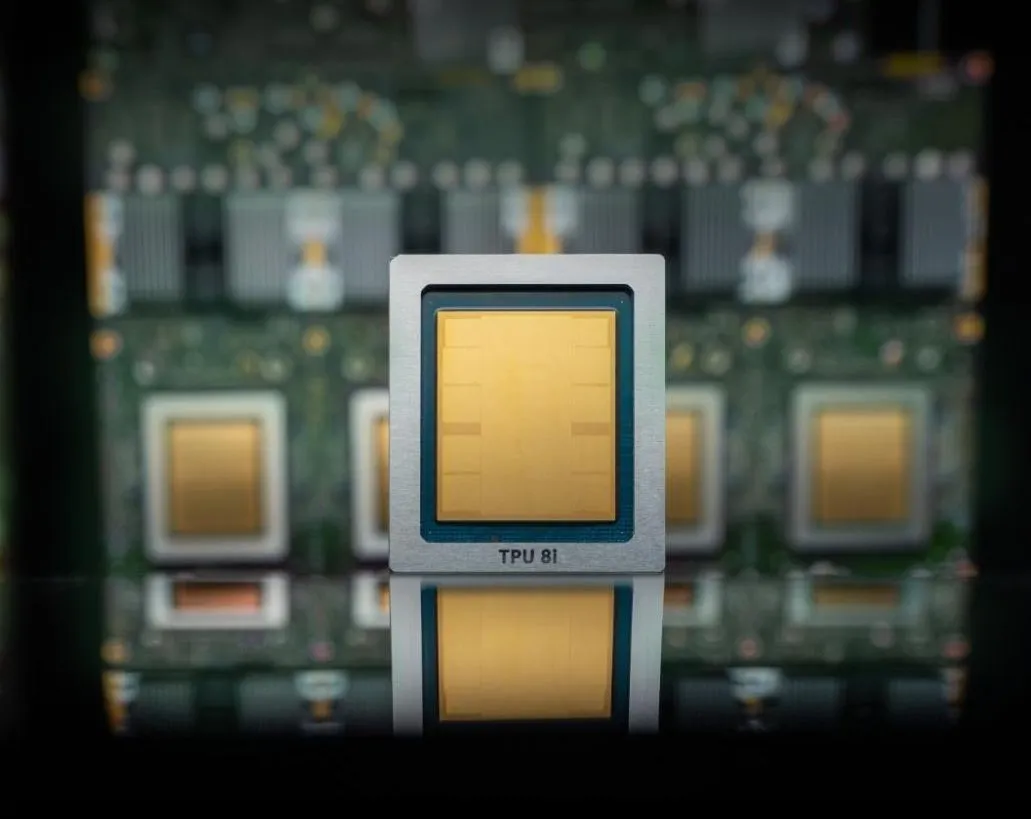

Google Cloud lansează două noi cipuri AI pentru a compete cu Nvidia: TPU 8t și TPU 8i

Google Cloud a lansat două noi cipuri AI — TPU 8t pentru antrenament și TPU 8i pentru inferență — oferind până la 3x mai multă viteză și 80% mai bună performanță pe dolar, în timp ce continuă să colaboreze cu Nvidia pentru a optimiza infrastructura de AI în cloud.

Optimizarea spațiilor ZeroGPU prin compilarea ahead-of-time: Ghid complet pentru performanță maximă

Compilarea ahead-of-time (AoT) revoluționează performanța modelelor ML în spațiile ZeroGPU de la Hugging Face, eliminând timpii de pornire la rece și oferind accelerări de 1.3×-1.8×. Acest ghid detaliază implementarea tehnică, de la capturarea intrărilor până la integrarea în pipeline, explorând și tehnici avansate precum cuantizarea FP8 și FlashAttention-3.

Scaleway devine furnizor oficial de inferență AI pe Hugging Face Hub

Scaleway se integrează oficial pe Hugging Face Hub ca furnizor de inferență, oferind acces serverless la modele AI de top, cu infrastructură europeană, prețuri competitive și latență redusă pentru dezvoltatori.

Batching continuu: De la primele principii la optimizarea inferenței AI

Articolul explorează mecanismele fundamentale ale inferenței în modelele de limbaj de mari dimensiuni, de la atenție și KV caching până la batching-ul continuu, explicând cum aceste tehnici optimizează throughput-ul în scenarii de servire în sarcină ridicată.

Open Responses: Revoluția Inferenței AI dincolo de Era Chatbot-urilor

Open Responses redefinește standardul inferenței AI, trecând de la modelul conversațional la sisteme autonome capabile de raționament complex și execuție de sarcini multi-eta, oferind transparență și interoperabilitate într-un format open-source.