TPU 8t este optimizat pentru antrenamentul modelelor de AI — procesul intensiv de calcul în care rețelele neuronale învăță din mari seturi de date. Google afirmă că acest cip oferă până la 3 ori mai multă viteză în antrenament comparativ cu generația anterioară de TPU, o îmbunătățire semnificativă care poate reduce drastic timpurile de dezvoltare pentru modele mari de limbaj (LLM), modele de difuzie sau sisteme de vedere computerizată. De asemenea, TPU 8t oferă o creștere de 80% în performanța pe dolar, ceea ce îl face atrage pentru start-up-uri și întreprinderi care caută să scaleze experimentele de AI fără a creșteri exponențial costurile infrastructurii.

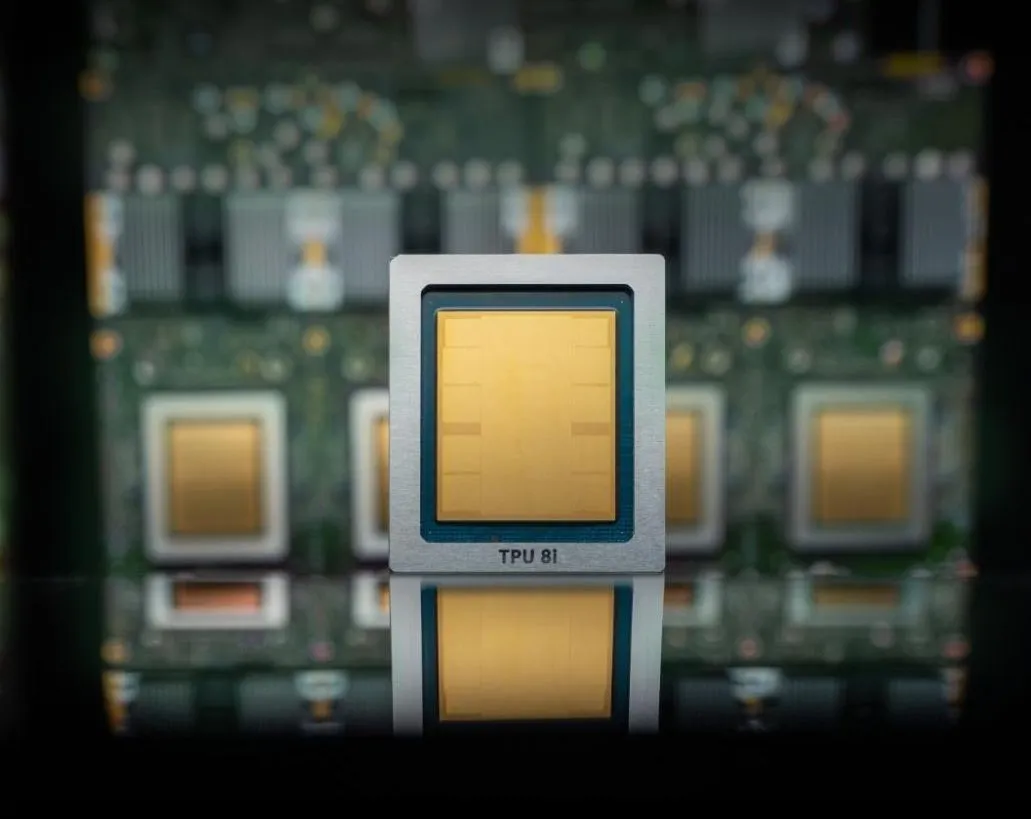

TPU 8i, pe de altă parte, este dedicat inferenței — fază în care modelul antrenat generează predicții în timp real, de la răspunsurile unui chatbot la recunoașterea imaginilor în aplicații mobile. Inferența reprezintă majoritatea consumului de resurse în implementările de AI în producție, iar optimizarea ei este crucială pentru reducerea latenței și costului de operare. Google spune că TPU 8i este proiectat pentru a susține sarcini de inferență de scară masivă, cu capacitatea de a scala până la 1 milion de cipuri într-un singur cluster — o abilitate care îl plasează printre cele mai puternice infrastructuri de AI din lume.

Această arhitectură distribuită, capabilă să integreze peste un milion de cipuri în cadrul unui singur sistem de calcul, este o demonstrație a experțizei Google în proiectarea de sisteme de calcul distribuit de scară hipermasivă — o competență dezvoltată prin ani de exploatare a serviciilor precum Căutarea, Gmail și YouTube. Capacitatea de a coordona eficient un număr atât mare de cipuri reduce nevoia de memorie partajată costisitoare și minimizează gheara de comunicatie, două dintre cele mai mari provocări în calculul distribuit de AI.

Deși Google promovează aceste cipuri ca alternativă puternă la GPU-urile tradiționale, compania subliniază clar că nu dorește să înlocuiască complet Nvidia. Pe contra, Google Cloud continuă să ofere instanțe bazate pe GPU-urile Nvidia — inclusiv cele mai recente, precum chip-ul Vera Rubin, care va fi disponibil în platforma sa mai târziu în acest an. Această abordare hibridă reflectă strategia altor giganti ai cloud-ului, precum Amazon (cu Trainium și Inferentia) și Microsoft (cu Maia), care dezvoltă cipuri proprii pentru a reduce dependența de Nvidia, dar fără să renunțe la compatibilitatea și la accesul la ecosistemul maturat al acestuia.

De fapt, Google a anunțat și o colaborare directă cu Nvidia pentru a îmbunătăți performanța sistemelor Nvidia-based în cloud-ul său prin intermediul tehnologiei de rețea Falcon — un proiect software open-source lansat de Google în 2023 sub egida Open Compute Project. Falcon optimizează comunicația între nodurile dintr-un cluster de AI, reducând latența și creșterea throughput-ului, ceea ce permite sistemelor Nvidia să funcționeze mai eficient chiar și în mediul infrastructurii Google. Această parteneriată subliniază o realitate importantă: în ecosistemul actual de AI, niciuna dintre cele două companii nu poate să-și atingă obiectivele în izolare. Nvidia profite de adoptarea largă a platformei sale, iar Google profite de performanța și maturitatea ecosistemului CUDA, chiar și când dezvoltă soluții alternative.

Analistul de piață Patrick Moore, care în 2016 a batjocorit predicția că TPU-urile Google ar putea fi „rele știri” pentru Nvidia (și Intel), a recunoscut acum cu umor că această prognoză nu a ținut pas cu evoluția reală. Nvidia a ajuns să aibă o capitalizare de piață de aproape 5 bilioane de dolari — o valoare care reflectă nu doar dominanța ei în hardware, ci și controlul ei aproape total peste software-ul de AI prin CUDA, cu biblioteci precum cuDNN, TensorRT și NVIDIA AI Enterprise care sunt fundamentale pentru majoritatea proiectelor de AI în industrie.

Totuși, tendința de la integrare verticală în cloud este ireversibilă. Mai multe întreprinderi migrează sarcenile de AI spre platformele cloud proprii-zise, unde au mai mare control asupra costurilor, securității și personalizării. În acest context, cipurile proprietare precum TPU 8t și TPU 8i devin avantaje strategice: permit companiei să ofere prețuri mai competitive, să reducă dependența de furnizori terți și să optimizeze stiva completă — de la hardware la firmware și software — pentru sarcenile specifice de AI.

Deși Nvidia rămâne forță dominătoare în prezent, lansarea TPU 8t și TPU 8i semnalează o mutare de paradigma: viitorul AI nu va fi dominat exclusiv de un singur furnizor, ci va fi modelat de o competiție între ecosisteme integrate — unde gigantii cloud-ului nu doar consumă cipuri, ci le proiectează, le optimizează și le integrează în sisteme deosebite de performanță, eficiență și cost.

Pentru dezvoltatorii și pentru întreprinderile care construiesc aplicații de AI, această diversificare este o bună veste: mai multe opțiuni înseamnă mai multă inovație, mai puțină dependență de un singur furnizor și mai mare libertate de a alege arhitectura potrivită sarcinii — fie că se vorbește de antrenamentul unui model de limbaj mare de 1 trilion de parametri, fie de implementarea unui asistent vocal pe dispozitivele de margine.

De ce este important:

Lansarea TPU 8t și TPU 8i nu este doar un update tehnic — este un semnal clar că Google investește agresiv în independența tehnologică pentru a-și asigura un loc de lider în viitorul AI. Deși Nvidia rămâne partener esențial și chiar colaborator tehnic, dezvoltarea de cipuri proprii permite Google să controleze mai bine costurile, latența și performanța pentru sarcenile sale specifice de AI — un avantaj critic în o industrie în care eficiența energetică și economică face diferența între profit și pierdere. În același timp, colaborarea cu Nvidia prin proiecte precum Falcon arată că viitorul nu este despre înlocuire, ci despre coevoluție: cei mai jucători mari vor să profite atât de inovația internă, cât și de maturitatea ecosistemelor establishte. Pentru întreprinderi, acest lucru înseamnă mai multe opțiuni, mai bune prețuri și mai puțină risc de blocare la un singur furnizor — ingrediente esențiale pentru o inovație sustentabilă în AI.