Într-o anunțare care marchează un moment semnificativ pentru comunitatea globală de inteligență artificială, biblioteca Sentence Transformers, cunoscută și sub denumirile de SentenceBERT sau SBERT, a devenit parte integrantă a ecosistemului Hugging Face. Această mișcare, anunțată la data de 22 octombrie 2025, nu reprezintă doar o simplă achiziție corporativă, ci o validare a succesului remarcabil pe care această unealtă open-source l-a avut în democratizarea accesului la tehnologii avansate de procesare a limbajului natural (NLP).

O moștenire de inovație în inima Europei

Pentru a înțelege amploarea acestei integrări, trebuie să privim înapoi la originile proiectului. Sentence Transformers a fost fondat în anul 2019 de către Dr. Nils Reimers, în cadrul laboratorului UKP (Ubiquitous Knowledge Processing) de la Universitatea Tehnică din Darmstadt, Germania, sub îndrumarea profesoarei Dr. Iryna Gurevych. Motivația principală care a stat la baza dezvoltării acestei biblioteci a fost necesitatea stringentă de a depăși limitările intrinseci ale embedding-urilor standard BERT.

Deși modelul BERT original a revoluționat domeniul NLP, acesta prezenta deficiențe majore atunci când venea vorba de sarcini la nivel de propoziție, cum ar fi determinarea similarității semantice dintre două fraze. Fără o ajustare specifică, reprezentările vectoriale produse de BERT nu erau ideale pentru comparații directe prin cosine similarity. Aici a intervenit geniul inovației SBERT: utilizarea unei arhitecturi de rețea siameză (Siamese network). Această abordare a permis generarea unor embedding-uri (reprezentări vectoriale) care capturau cu acribie sensul semantic al propozițiilor, făcându-le direct comparabile și extrem de eficiente pentru sarcini precum căutarea semantică, clustering-ul textual sau detectarea parafrazelor.

De la proiect academic la standard industrial

Ceea ce a început ca un proiect de cercetare academică a evoluat rapid într-un standard industrial, adoptat pe scară largă atât de cercetători, cât și de practicieni din industrie. Designul modular și open-source al bibliotecii a facilitat această tranziție, permițând o integrare facilă în diverse aplicații reale. Pe parcursul a peste patru ani de dezvoltare susținută de echipa UKP Lab, biblioteca a cunoscut extinderi majore. În 2020, a fost adăugat suportul multilingv, extinzând capacitățile de embedding la peste 400 de limbi, un pas crucial pentru globalizarea tehnologiilor AI. Un an mai târziu, în 2021, grație contribuțiilor aduse de Nandan Thakur și Dr. Johannes Daxenberger, biblioteca a integrat modele Cross Encoder pentru scorarea perechilor de propoziții, consolidându-și poziția în domeniul recuperării informației.

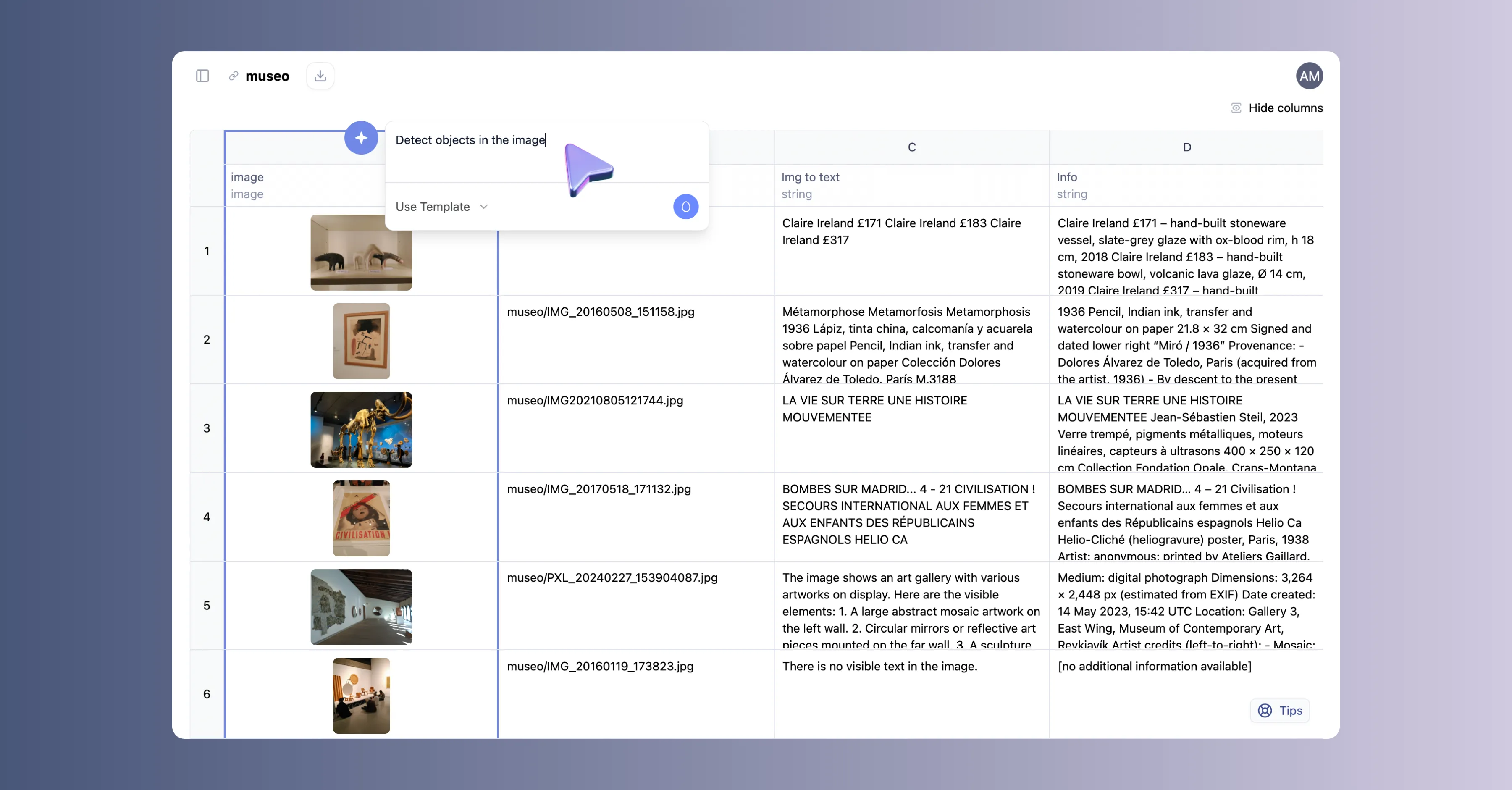

Impactul este cuantificabil și impresionant: pe Hub-ul Hugging Face sunt disponibile public peste 16.000 de modele Sentence Transformers, care servesc unui milion de utilizatori unici lunar. Aceste cifre demonstrează nu doar utilitatea instrumentului, ci și vitalitatea comunității care l-a susținut.

Tranziția către Hugging Face și continuitatea viziunii

Integrarea în familia Hugging Face a fost pregătită treptat. Spre sfârșitul anului 2023, Tom Aarsen de la Hugging Face a preluat responsabilitatea menținerii bibliotecii, introducând o serie de modernizări esențiale. Sub coordonarea sa, biblioteca a lansat versiunea 3.0, care a adus îmbunătățiri semnificative în antrenarea modelelor, urmată de versiunile 4.0 pentru Cross Encoder și 5.0 pentru Sparse Encoder. Această evoluție tehnică a pregătit terenul pentru oficializarea parteneriatului.

În declarațiile oficiale, Prof. Dr. Iryna Gurevych a subliniat că „Sentence Transformers a fost o poveste de succes imensă și o culminație a cercetării noastre îndelungate asupra calculării similarităților semantice pentru întregul laborator”. Ea a mulțumit comunității și lui Nils Reimers pentru viziune, exprimându-și încrederea că Hugging Face va duce mai departe moștenirea proiectului. Din partea Hugging Face, entuziasmul este reciproc: „Suntem încântați să primim oficial Sentence Transformers în familia Hugging Face! (...) Acesta este doar începutul: vom continua să susținem creșterea și inovația sa, rămânând fideli spiritului deschis și colaborativ care l-a făcut să prospere”.

Angajamentul față de Open Source și viitorul

Un aspect crucial al acestui anunț este asigurarea continuității. Sentence Transformers va rămâne un proiect open-source, condus de comunitate, sub aceeași licență Apache 2.0. Această decizie garantează că transparența, colaborarea și accesibilitatea largă vor rămâne valorile fundamentale ale proiectului. Cercetătorii, dezvoltatorii și entuziaștii sunt încurajați să contribuie, modelul de dezvoltare colaborativă fiind esențial pentru inovația viitoare.

Hugging Face și-a exprimat recunoștința față de UKP Lab, subliniind rolul crucial jucat de finanțarea oferită de Fundația Germană de Cercetare (DFG), Ministerul Federal German al Educației și Cercetării (BMBF) și Ministerul de Stat din Hessen pentru Învățământ Superior, Cercetare și Arte (HMWK). Aceste granturi au permis menținerea unui standard ridicat de cercetare și inovație pe parcursul anilor.

În concluzie, trecerea Sentence Transformers sub umbrela Hugging Face nu reprezintă o schimbare de direcție, ci o accelerare a traiectoriei deja trasate. Combinând moștenirea academică solidă a UKP Lab cu infrastructura vastă și comunitatea globală a Hugging Face, viitorul procesării semantice a limbajului natural pare mai promițător ca oricând. Pentru noii utilizatori dornici să exploreze capacitățile bibliotecii, resursele și modelele sunt deja accesibile pe platforma Hugging Face, marcând începutul unei noi ere în înțelegerea automată a limbajului uman.

Sentence Transformers se alătură oficial familiei Hugging Face: Un nou capitol pentru procesarea semantică a limbajului