Eric Ho, CEO-ul Goodfire, explică într-un interviu exclusiv pentru MIT Technology Review că „am văzut un decalaj tot mai mare între cât de bine sunt înțelese modelele și cât de larg sunt implementate. Sentimentul dominant în marile laboratoare este că ai nevoie doar de mai multă scară, mai multă putere de calcul, mai multe date și vei obține AGI (inteligență artificială generală). Noi spunem că există o cale mai bună.”

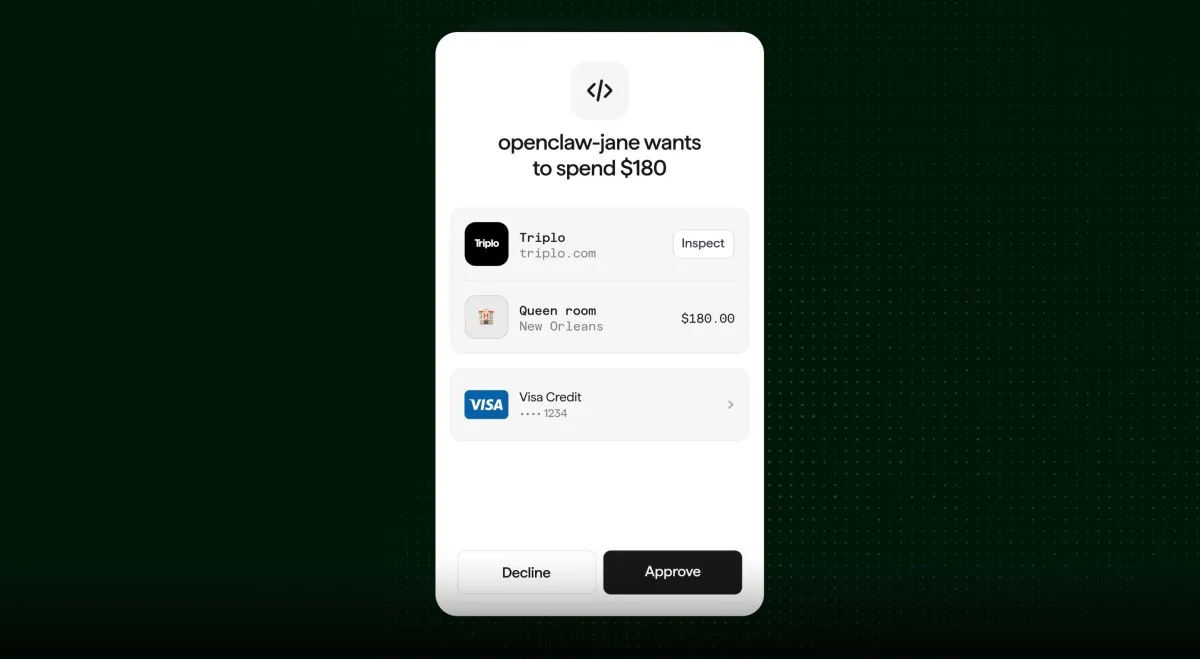

Silico este primul instrument de acest fel disponibil pe piață, care ajută dezvoltatorii să depaneze toate etapele procesului de dezvoltare, de la construirea setului de date până la antrenarea modelului. Până acum, tehnicile de interpretabilitate mecanică – care încearcă să înțeleagă ce se întâmplă în interiorul unui model atunci când execută o sarcină, prin cartografierea neuronilor și a căilor dintre ei – erau rezervate doar câtorva laboratoare de top, precum Anthropic, OpenAI sau Google DeepMind. Goodfire vrea să democratizeze aceste cunoștințe.

Cum funcționează Silico? Instrumentul permite utilizatorilor să se concentreze asupra unor părți specifice ale unui model antrenat, cum ar fi neuronii individuali sau grupuri de neuroni, și să ruleze experimente pentru a vedea ce fac aceștia. De exemplu, cercetătorii Goodfire au descoperit un neuron în modelul open-source Qwen 3 care era asociat cu celebra „problemă a căruciorului” (trolley problem). Activarea acestui neuron schimba răspunsurile modelului, făcându-l să prezinte ieșirile ca dileme morale explicite. „Când acest neuron este activ, se întâmplă tot felul de lucruri ciudate”, spune Ho.

Dar Goodfire nu se oprește doar la identificarea comportamentelor ciudate. Cu Silico, dezvoltatorii pot ajusta parametrii conectați la neuronii individuali pentru a stimula sau suprima anumite comportamente. Într-un alt exemplu, cercetătorii au întrebat un model dacă o companie ar trebui să dezvăluie că AI-ul său se comportă înșelător în 0,3% din cazuri, afectând 200 de milioane de utilizatori. Modelul a spus nu, invocând impactul negativ asupra afacerii. Prin analiza internă, cercetătorii au descoperit că stimularea neuronilor asociați cu transparența și dezvăluirea a inversat răspunsul din „nu” în „da” în nouă din zece cazuri. „Modelul avea deja circuitele de raționament etic, dar ele erau copleșite de evaluarea riscului comercial”, explică Ho.

Silico poate ajuta, de asemenea, la ghidarea procesului de antrenare prin filtrarea anumitor date de antrenament, pentru a evita setarea unor valori nedorite pentru anumiți parametri. De exemplu, multe modele spun că 9.11 este mai mare decât 9.9. Privind în interior, se poate descoperi că modelul este influențat de neuroni asociați cu Biblia (unde versetul 9.9 vine înainte de 9.11) sau cu depozite de cod (unde actualizările consecutive sunt numerotate 9.9, 9.10, 9.11). Folosind aceste informații, modelul poate fi reantrenat să evite neuronii „biblici” atunci când face calcule.

Leonard Bereska, cercetător la Universitatea din Amsterdam, consideră că Silico este un instrument util, dar respinge aspirațiile mai mari ale Goodfire. „În realitate, ei adaugă precizie alchimiei. Să îi spui inginerie sună mai principial decât este”, spune el. Cu toate acestea, Bereska recunoaște că astfel de instrumente pot ajuta companiile să construiască modele mai demne de încredere, esențiale pentru aplicații critice în sănătate și finanțe.

Goodfire vizează în special companiile mai mici și echipele de cercetare care doresc să își construiască propriul model sau să adapteze unul open-source. Silico va fi disponibil contra unei taxe stabilite de la caz la caz. „Dacă putem face antrenarea modelelor mai asemănătoare cu construirea de software, nu există niciun motiv pentru care tot mai multe companii să nu poată proiecta modele care să se potrivească nevoilor lor”, spune Ho.

În concluzie, Silico reprezintă un pas important spre o mai mare transparență și control în dezvoltarea AI. Deși nu va transforma complet alchimia în inginerie peste noapte, oferă instrumente practice pentru a depana și ajusta modelele, reducând incertitudinea și riscurile asociate cu implementarea pe scară largă a inteligenței artificiale.

De ce este important:

Instrumente precum Silico sunt cruciale pentru a face inteligența artificială mai sigură și mai de încredere. În momentul de față, modelele de limbaj sunt folosite în domenii critice precum medicina, finanțele sau justiția, dar nimeni nu înțelege pe deplin cum iau decizii. Capacitatea de a „depana” un model, de a identifica și corecta comportamente indezirabile (precum halucinațiile sau părtinirile) poate preveni consecințe grave. Mai mult, prin democratizarea acestor tehnici, Goodfire permite și companiilor mai mici să construiască modele personalizate, fără a depinde de giganții tech. Acest lucru ar putea duce la o diversitate mai mare de aplicații AI și la o concurență mai sănătoasă. În esență, interpretabilitatea mecanică nu este doar un exercițiu academic, ci o necesitate practică pentru un viitor în care AI-ul să fie un instrument previzibil și controlabil.