Într-o acțiune juridică cu implicații profunde pentru viitorul inteligenței artificiale și al confidențialității digitale, o victimă a notoriului infractor sexual Jeffrey Epstein a depus joi o acțiune colectivă în instanță împotriva Google. Reclamanta, care acționează sub pseudonimul „Jane Doe” pentru a-și proteja identitatea, acuză gigantul tehnologic că noua sa funcție de căutare bazată pe inteligență artificială, cunoscută sub numele de „AI Mode”, a publicat și diseminat informații personale extrem de sensibile despre victimele rețelei de trafic sexual conduse de Epstein.

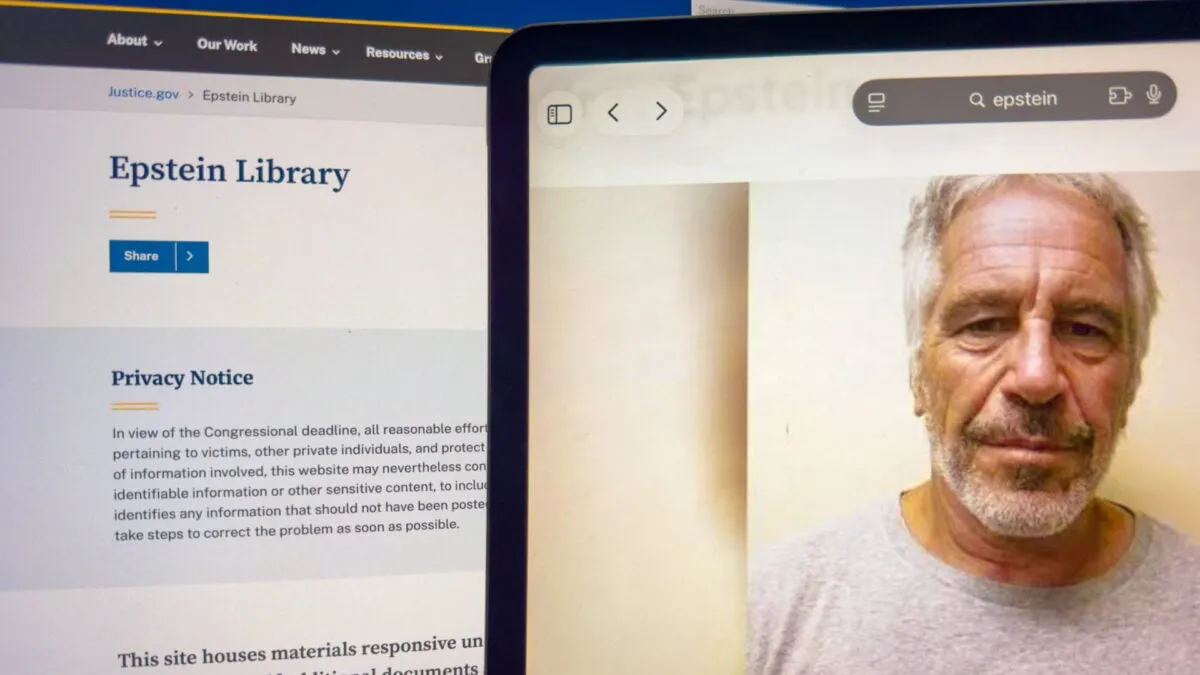

Contextul acestei acțiuni judiciare este complex și își are originile în decizia Departamentului de Justiție al Statelor Unite (DOJ) de a face publice dovezi din dosarul Epstein. Ca răspuns la presiuni legislative și la cererea publică de transparență, DOJ a început să publice, în loturi succesive, peste 3 milioane de pagini de documente probatorii începând cu sfârșitul anului trecut și continuând în primele luni ale acestui an. Totuși, procesul de publicare a fost marcat de erori grave. În timp ce numele anumitor predatori potențiali au fost redate (ascunse) în mod corespunzător, identitățile mai multor supraviețuitori au fost expuse din cauza unor redactări defectuoase sau inexistente.

Potrivit plângerii depuse la Curtea Districtuală a SUA pentru Districtul de Nord al Californiei, guvernul american, acționând prin intermediul DOJ, a făcut o alegere politică deliberată de a prioritiza o dezvăluire rapidă și de mare volum în detrimentul protecției vieții private a supraviețuitorilor lui Epstein. Această decizie a avut consecințe devastatoare. Procesul susține că supraviețuitorii au fost obligați să retrăiască trauma abuzurilor, iar odată ce informațiile lor au devenit publice, aceștia au devenit ținte ale hărțuirii continue.

Deși Departamentul de Justiție a recunoscut ulterior erorile și a retras documentele compromise de pe site-urile oficiale, informația a rămas accesibilă online, fiind indexată și redistribuită de funcția de căutare AI a Google. Reclamanta susține că, în ciuda retragerii oficiale a datelor, entități online precum Google continuă să le republice, refuzând rugămințile victimelor de a le elimina. Aceasta este miza centrală a procesului: capacitatea sistemelor AI de a păstra și reactualiza informații șterse din sursele originale.

Mai alarmant este faptul că, în urma căutării numelui reclamantei „Jane Doe” și al altor victime pe care le reprezintă, AI Mode al Google a afișat nu doar numele lor complete și orașul de reședință, ci și informații de contact directe. În cazul reclamantei, inteligența artificială a mers și mai departe, generând o hiperlegătură (hypertext link) care permitea oricui să trimită un e-mail direct victimei printr-un simplu clic. Această funcționalitate transformă pasiva citire a informațiilor într-o activă hărțuire, facilitând contactul direct cu victimele abuzurilor sexuale.

Procesul detaliază faptul că victima a notificat Google cu privire la această problemă în multiple rânduri pe parcursul ultimelor două luni, dar toate încercările au fost în zadar. „În ciuda primirii unui aviz real cu privire la încălcări, a prejudiciului substanțial cauzat de diseminarea continuă și a statutului multor membri ai grupului de supraviețuitori ai abuzurilor sexuale, care au dreptul la protecții sporite ale vieții private în temeiul legii, Google a eșuat și refuză să elimine, să de-indexeze sau să blocheze accesul la materialele ofensatoare”, se arată în documentul juridic.

Un aspect tehnic crucial invocat în acțiune este comparația cu alte sisteme de inteligență artificială. Reclamanții susțin că, în teste repetate, alte instrumente AI disponibile publicului, precum ChatGPT (OpenAI), Claude (Anthropic) și Perplexity, nu au furnizat nicio informație legată de victime. Această diferențiere este folosită pentru a argumenta că AI Mode al Google nu funcționează ca un simplu motor de căutare neutră, ci ca un „recomandator activ și generator de conținut”. Prin urmare, procesul argumentează că acțiunile Google ar putea fi considerate „doxxing acționabil din punct de vedere juridic” – practica de a publica informații private despre o persoană cu intenția de a o hărțui.

Acest proces se încheie într-o săptămână crucială pentru responsabilitatea juridică a giganților tehnologici. Marți și miercuri, două verdicturi importante au fost pronunțate împotriva Meta și Google în procese legate de siguranța online și dependența de rețelele sociale. Aceste cazuri sunt considerate momente de cotitură, care ar putea redefini modul în care libertatea de exprimare și responsabilitatea platformelor sunt reglementate în Statele Unite.

Punctul central al dezbaterii legislative este Secțiunea 230 a Legii privind Decența în Comunicații (Communications Decency Act). În prezent, această lege scutește giganții tehnologici de responsabilitate pentru conținutul postat de terți. Totuși, cu noile hotărâri judecătorești și procesul intentat de victimele lui Epstein, protecția oferită de Secțiunea 230 este serios contestată. Senatorul Ron Wyden, unul dintre autorii legii, a declarat în ianuarie că inteligența artificială și chatboții nu ar trebui să se bucure de protecția oferită de această secțiune, deoarece ei generează conținut nou, nu doar îl indexează.

În concluzie, procesul intentat de victimele lui Epstein împotriva Google nu este doar un litigiu despre confidențialitate, ci un test major pentru granițele responsabilității în era inteligenței artificiale. Dacă instanța va decide că Google este responsabil pentru conținutul generat și menținut de AI Mode, acest lucru ar putea forța companiile tehnologice să implementeze măsuri mult mai stricte de filtrare a datelor sensibile și să răspundă mai rapid pentru erorile algoritmilor lor. Până la un verdict final, viețile supraviețuitorilor rămân expuse, prinși între erorile birocrației guvernamentale și indiferența algoritmilor corporativi.

Victimele lui Epstein dau în judecată Google: Modul AI ar fi expus informații personale sensibile, declanșând o nouă bătălie juridică privind confidențialitatea