Subiect: #inteligență artificială

Construirea unui viitor deschis: Parteneriatul strategic dintre Hugging Face și Google Cloud

Parteneriatul strategic dintre Hugging Face și Google Cloud, anunțat în noiembrie 2025, revoluționează accesul la modelele AI deschise. Colaborarea integrează peste 2 milioane de modele în servicii precum Vertex AI și GKE, oferind o viteză superioară de descărcare printr-un nou Gateway CDN și securitate avansată prin tehnologii precum Mandiant.

AMD Open Robotics Hackathon: Oportunitate de neratat pentru pasionații de robotică și inteligență artificială

AMD, Hugging Face și Data Monsters organizează AMD Open Robotics Hackathon, o competiție dedicată pasionaților de robotică și AI. Evenimentul va avea loc în Tokyo (5-7 decembrie) și Paris (12-14 decembrie) 2025, oferind participanților acces la hardware de ultimă generație și premii totale consistente.

Apriel-H1: Cheia surprinzătoare pentru distilarea modelelor eficiente de raționament

Descoperă cum Apriel-H1 redefinește eficiența modelelor de raționament prin distilare hibridă, înlocuind straturile de atenție cu Mamba și obținând o creștere a vitezei de 2.1x fără a compromite calitatea gândirii logice.

RapidFire AI: Optimizarea TRL de 20 de ori mai rapidă pentru antrenarea modelelor lingvistice

RapidFire AI revoluționează ajustarea fină a modelelor de limbaj (LLM) prin TRL, oferind o accelerare de până la 20x. Soluția permite rularea concurentă a multiplelor configurații chiar și pe un singur GPU, cu control interactiv în timp real pentru a maximiza eficiența și a reduce timpul de experimentare.

Construirea Deep Research: Cum am atins performanța de ultimă generație (State of the Art)

O analiză detaliată a procesului de dezvoltare a sistemului Deep Research, evidențiind importanța ingineriei contextului, gestionarea eficientă a tokenilor și trecerea de la fluxuri de lucru la agenți autonomi pentru a atinge performanța de ultimă generație.

DeepMath: Un agent ușor de raționament matematic, construit cu smolagents

DeepMath este un agent inovator de raționament matematic bazat pe modelul Qwen3-4B, care utilizează fragmente de cod Python executate într-un mediu securizat pentru a reduce erorile și lungimea output-ului cu până la 66%, demonstrând că modelele mici pot depăși limitările tradiționale ale LLM-urilor prin antrenament GRPO și arhitecturi hibride.

Prezentare swift-huggingface: Clientul Swift complet pentru ecosistemul Hugging Face

swift-huggingface este o bibliotecă Swift completă pentru Hugging Face, care rezolvă problemele de fiabilitate la descărcarea modelelor, introduce autentificare flexibilă (inclusiv OAuth) și permite partajarea cache-ului cu ecosistemul Python, optimizând fluxul de lucru pentru dezvoltatorii de AI pe platformele Apple.

CUGA pe Hugging Face: Democratizarea Agenților AI Configurabili pentru Era Enterprise

CUGA (Configurable Generalist Agent) revoluționează peisajul AI enterprise prin democratizarea accesului la agenți AI complecși. Aflați despre arhitectura sa inovatoare, performanțele de top pe WebArena și integrarea cu platforme open-source precum Hugging Face și Langflow.

AprielGuard: O nouă barieră de protecție pentru siguranță și robustețe adversarială în sistemele LLM moderne

AprielGuard este un model de protecție de 8 miliarde de parametri, lansat în 2025, care unifică detectarea riscurilor de siguranță și a atacurilor adversariale în sistemele LLM moderne, oferind suport pentru contexte lungi și fluxuri de lucru agentice complexe.

Prezentarea Falcon-H1-Arabic: Extinderea limitelor inteligenței artificiale pentru limba arabă printr-o arhitectură hibridă inovatoare

Falcon-H1-Arabic reprezintă un salt tehnologic major în procesarea limbajului natural pentru limba arabă, introducând o arhitectură hibridă Mamba-Transformer inovatoare. Cu modele de 3B, 7B și 34B parametri capabile să proceseze până la 256.000 de tokeni, această familie depășește performanțele modelelor existente, inclusiv pe cele mai mari, stabilind noi standarde în benchmark-urile OALL și 3LM.

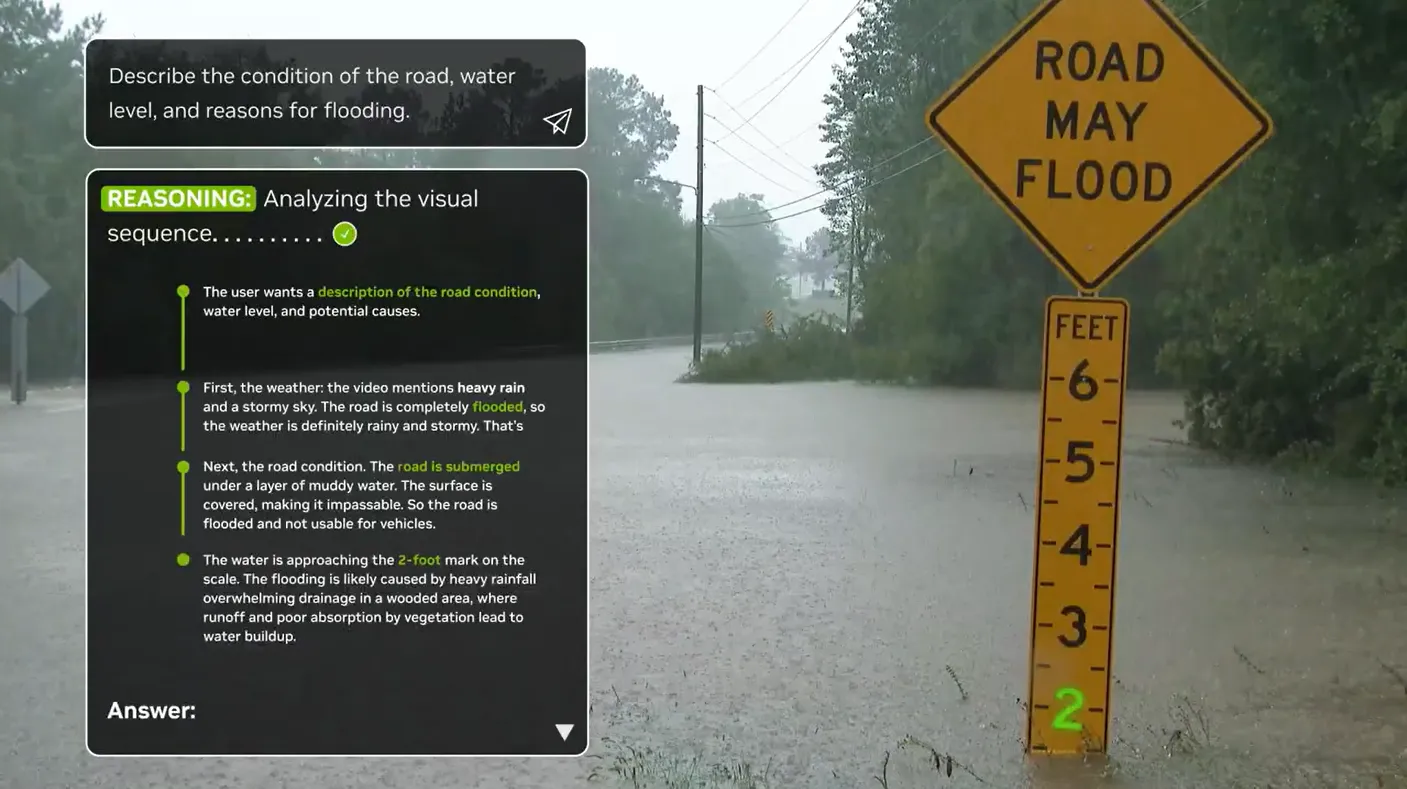

NVIDIA Cosmos Reason 2: O nouă eră în raționamentul artificial pentru roboți și sisteme autonome

NVIDIA lansează Cosmos Reason 2, un model vizual-lingvistic revoluționar care oferă roboților și agenților AI capacitatea de a raționa și planifica în lumea fizică. Cu îmbunătățiri majore în înțelegerea spațio-temporală și suport pentru 256K tokeni, modelul lider pe Physical AI Bench transformă analiza video, adnotarea datelor și planificarea robotică.

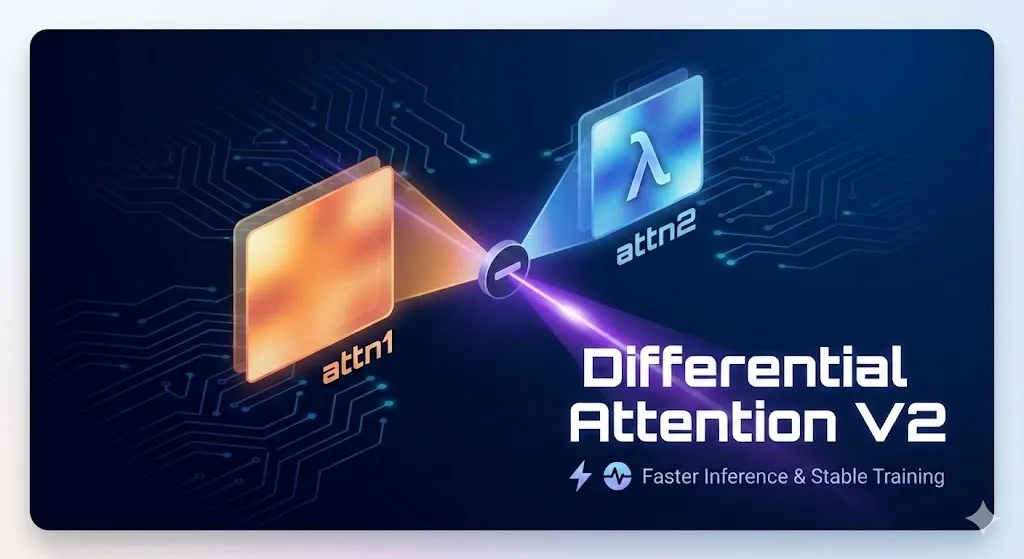

Differential Transformer V2: O nouă eră în eficiența și stabilitatea modelelor de limbaj de mari dimensiuni

Differential Transformer V2 (DIFF V2) revoluționează arhitectura LLM prin optimizarea eficienței inferenței și eliminarea instabilității numerice specifice versiunii anterioare. Prin dublarea capetelor de interogare și o nouă operație diferențială, modelul depășește constrângerile Softmax, oferind o decodare rapidă fără a necesita nuclee personalizate.