Subiect: #Optimizare

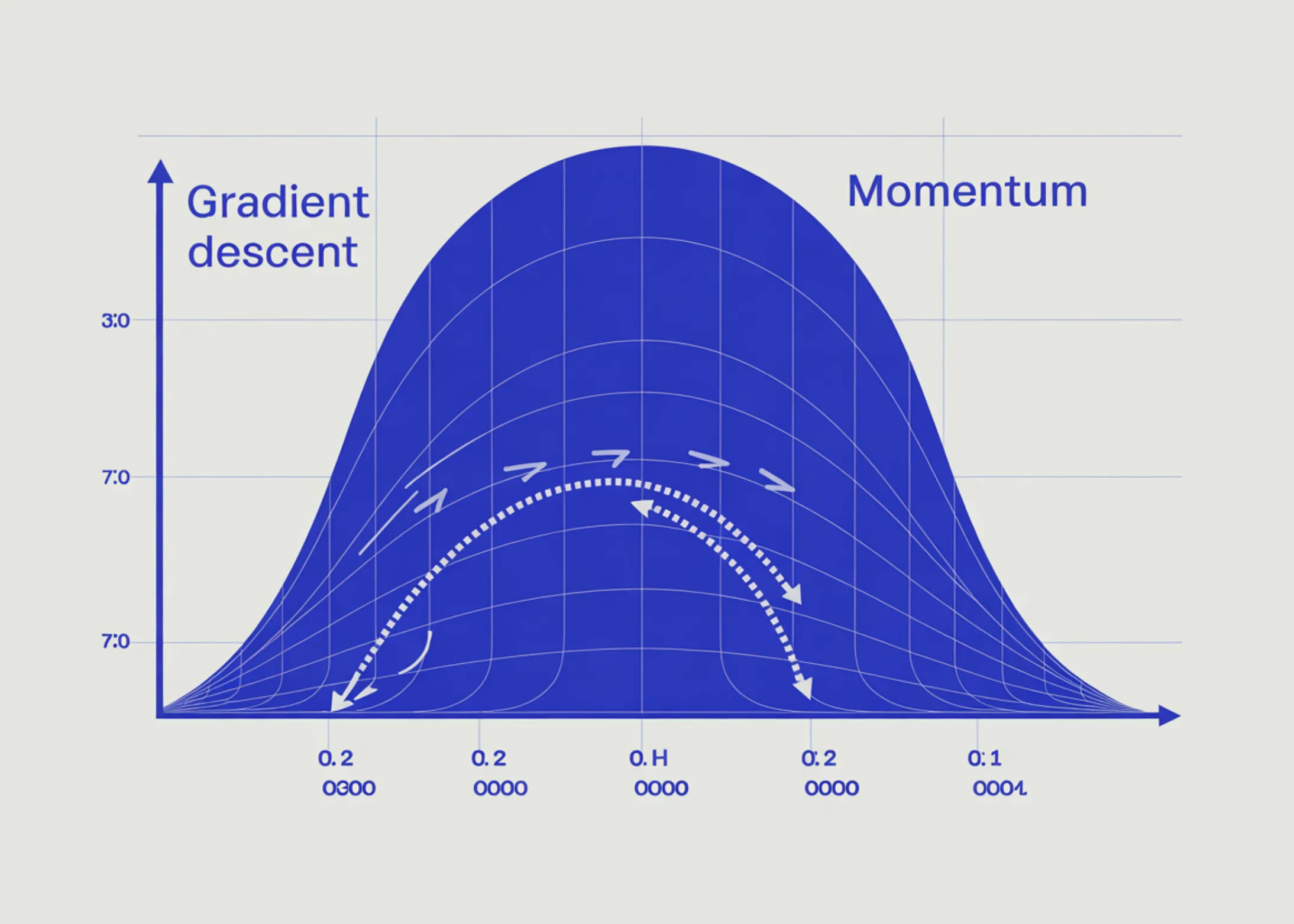

De ce zigzaghează Gradient Descent și cum îl corectează Momentum

Gradient descent zigzaghează din cauza diferențelor mari de magnitudine ale gradientilor pe diferite direcții. Momentum, inspirat din fizică, netezește oscilațiile și accelerează convergența, fiind esențial în antrenarea rețelelor neuronale.

Presupunerea LoRA care eșuează în producție

LoRA este o tehnică populară de fine-tuning, dar în producție, presupunerea că funcționează la fel ca fine-tuning-ul complet se sparge adesea. Află care sunt capcanele și cum să le eviți.

Cum reconfigurează AEO versus GEO descoperirea brandurilor prin AI în 2026

În 2026, descoperirea brandurilor se reconfigurează radical prin prisma a două strategii distincte: AEO și GEO. În timp ce impresiile de căutare cresc, click-urile scad dramatic. Brandurile care înțeleg diferența dintre optimizarea pentru motoare de răspuns și cea pentru motoare generative vor domina vizibilitatea în era AI.

Alinierea Modelelor Viziune-Limbaj în TRL: O Nouă Eră a Optimizării Preferințelor

Modelele Viziune-Limbaj evoluează rapid, dar alinierea lor la preferințele umane rămâne o provocare critică. Acest articol explorează noile tehnici din TRL, precum MPO și GRPO, care depășesc limitările DPO tradițional, oferind o robustete superioară și o capacitate de raționament îmbunătățită pentru modelele multimodale.

Trucuri de la OpenAI gpt-oss pe care TU 🫵 le poți utiliza cu transformers

Lansarea GPT-OSS de la OpenAI aduce o serie de inovații tehnice în ecosistemul open-source. Acest articol explorează integrarea acestora în biblioteca `transformers`, de la kernel-e zero-build și Flash Attention 3, până la cuantizarea MXFP4 și paralelismul tensorial, oferind un ghid detaliat pentru optimizarea inferenței modelelor de limbaj de mari dimensiuni.

Ghid complet: Rularea modelelor VLM locale pe procesoare Intel în 3 pași simpli

Acest ghid detaliat explică cum să rulați modele VLM local pe procesoare Intel folosind Optimum Intel și OpenVINO. Aflați despre conversia modelului, tehnicile de cuantizare pentru eficiență și rezultatele benchmark-urilor care demonstrează creșteri semnificative de performanță.

Batching continuu: De la primele principii la optimizarea inferenței AI

Articolul explorează mecanismele fundamentale ale inferenței în modelele de limbaj de mari dimensiuni, de la atenție și KV caching până la batching-ul continuu, explicând cum aceste tehnici optimizează throughput-ul în scenarii de servire în sarcină ridicată.

Mixture of Experts (MoE) în Transformers: O Revoluție în Arhitectura Modelelor de Limbaj

Modelele Mixture of Experts (MoE) revoluționează AI-ul prin decuplarea capacității de învățare de costul computațional. Acest articol explorează integrarea lor în Transformers, de la refactorizarea încărcării greutăților și materializarea leneșă a tensorilor, până la backend-uri optimizate și paralelismul experților.