Domeniu: AI

Differential Transformer V2: O nouă eră în eficiența și stabilitatea modelelor de limbaj de mari dimensiuni

Differential Transformer V2 (DIFF V2) revoluționează arhitectura LLM prin optimizarea eficienței inferenței și eliminarea instabilității numerice specifice versiunii anterioare. Prin dublarea capetelor de interogare și o nouă operație diferențială, modelul depășește constrângerile Softmax, oferind o decodare rapidă fără a necesita nuclee personalizate.

AssetOpsBench: Puntea dintre benchmark-urile AI și realitatea industrială – Un nou standard pentru evaluarea agenților inteligenți

AssetOpsBench reprezintă o evoluție necesară în evaluarea agenților AI, trecând de la simplul succes binar la o analiză complexă a eșecurilor în medii industriale reale. Acest cadru innovator evidențiază lacunele critice ale modelelor actuale în coordonarea multi-agent și gestionarea incertitudinii operaționale.

Alyah ⭐️: Spre o evaluare robustă a capacităților dialectului emirian în modelele lingvistice arabe

Alyah, un nou benchmark dedicat dialectului emirian, revelează lacune semnificative în modelele lingvistice arabe actuale și deschide calea spre asistenți AI mai cultural conștienți.

Alegeri Arhitecturale în Ecosistemul AI Open-Source din China: Construcția Dincolo de DeepSeek

Analiza detaliată a schimbărilor arhitecturale din ecosistemul AI open-source din China post-DeepSeek, evidențiind adoptarea arhitecturii Mixture of Experts (MoE), diversificarea modalităților, preferința pentru modelele mici și trecerea strategică la hardware domestic.

Claude construiește kernele CUDA și instruiește modelele open-source: O revoluție în optimizarea AI

Un articol detaliat despre utilizarea modelului Claude pentru a genera și transfera abilități de programare CUDA către modele open-source mai mici, democratizând accesul la expertiza avansată în optimizarea GPU.

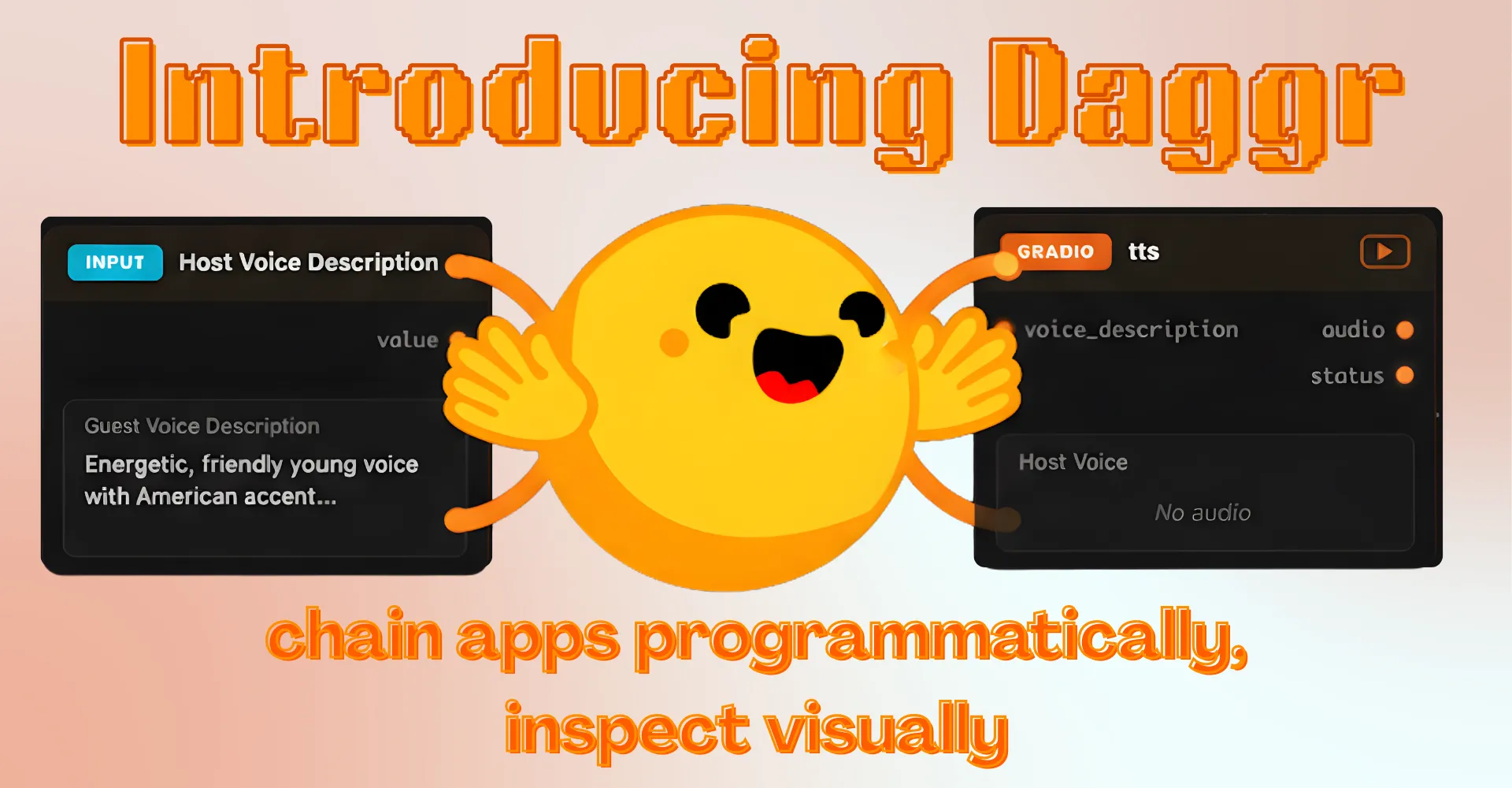

Prezentând Daggr: Înlănțuirea programabilă a aplicațiilor cu inspecție vizuală

Daggr revoluționează dezvoltarea aplicațiilor AI prin combinarea abordării code-first cu vizualizarea automată a fluxurilor de lucru, permițând dezvoltatorilor să inspecteze și reexecute pași individuali fără a relua întregul pipeline.

OpenEnv în Practică: Evaluarea Agenților care Utilizează Instrumente în Medii Reale

OpenEnv, un cadru open-source de la Meta și Hugging Face, standardizează interacțiunea agenților AI cu medii reale. Acest articol explorează Calendar Gym, un benchmark de producție dezvoltat de Turing, și analizează provocările critice în raționamentul multi-pas, rezoluția ambiguităților și utilizarea corectă a instrumentelor, oferind o perspectivă detaliată asupra limitărilor actuale ale agenților AI.

Revoluția Dezvoltării Web cu Gradio: Cum să Creezi Orice Aplicație într-un Singur Fișier Python

Descoperă cum componenta gr.HTML din Gradio revoluționează dezvoltarea web, permițând crearea de aplicații complexe, de la timere de productivitate până la vizualizatoare 3D ML, într-un singur fișier Python, fără pași de compilare.

IBM și UC Berkeley diagnostichează motivele eșecului agenților enterprise folosind IT-Bench și MAST

Un studiu realizat de IBM și UC Berkeley utilizează taxonomia MAST pentru a diseca eșecurile agenților AI în medii enterprise, dezvăluind diferențele critice dintre modelele de frontieră și cele open-source și oferind o metodologie clară pentru diagnosticarea și remedierea erorilor sistematice.

Antrenarea modelelor AI cu Unsloth și Hugging Face Jobs: Ghid Complet Gratuit

Un ghid complet despre cum să antrenați modele AI gratuit folosind Unsloth și Hugging Face Jobs. Aflați cum să utilizați modele mici precum LFM2.5-1.2B-Instruct, să instalați skill-uri pentru agenți de codare și să rulați job-uri de antrenare pe GPU-uri cloud gestionate automat.

GGML și llama.cpp se alătură Hugging Face pentru a garanta progresul pe termen lung al Inteligenței Artificiale Locale

Georgi Gerganov și echipa GGML se alătură Hugging Face pentru a scala proiectul llama.cpp, asigurând resursele necesare pentru viitorul AI-ului local. Parteneriatul promite autonomie deplină pentru proiectul open-source, integrare tehnică fluidă cu biblioteca transformers și o viziune comună pentru democratizarea superinteligenței pe dispozitivele utilizatorilor.

Mixture of Experts (MoE) în Transformers: O Revoluție în Arhitectura Modelelor de Limbaj

Modelele Mixture of Experts (MoE) revoluționează AI-ul prin decuplarea capacității de învățare de costul computațional. Acest articol explorează integrarea lor în Transformers, de la refactorizarea încărcării greutăților și materializarea leneșă a tensorilor, până la backend-uri optimizate și paralelismul experților.