Domeniu: AI

Închiderea Sora: Un moment de trezire pentru industria video cu inteligență artificială

Închiderea aplicației Sora de către OpenAI la doar șase luni după lansare semnalează o schimbare strategică majoră către produse enterprise și o corecție a așteptărilor nerealiste privind înlocuirea imediată a industriei cinematografice prin AI.

Accelerarea agentului Qwen3-8B pe procesoarele Intel® Core™ Ultra folosind modele draft cu eliminare stratificată a profunzimii

Acest articol explorează optimizarea modelului Qwen3-8B pe procesoarele Intel® Core™ Ultra, folosind decodare speculativă și modele draft cu eliminare stratificată. Se detaliază integrarea cu 🤗 smolagents pentru agenți AI locali rapizi.

Prezentând RTEB: Un Noua Standard pentru Evaluarea Recuperării Datelor în Era Inteligenței Artificiale

RTEB (Retrieval Embedding Benchmark) redefinesc evaluarea modelelor de embedding prin utilizarea unei strategii hibride, care combină seturi de date deschise și private pentru a combate supra-ajustarea și a oferi o măsură reală a capacității de generalizare în domenii precum finanțe, drept, cod și sănătate.

Optimizarea recunoașterii optice a caracterelor (OCR) de ultimă generație cu Core ML și Dots.OCR: O călătorie tehnică

Acest articol detaliază procesul tehnic complex de conversie a modelului OCR Dots.OCR pentru a rula pe dispozitivele Apple, folosind Core ML și Motorul Neural. Autorii descriu strategia de simplificare a modelului, provocările întâmpinate în compatibilitatea dintre PyTorch și Core ML și rezultatele benchmark-urilor inițiale, care evidențiază necesitatea optimizărilor ulterioare.

BigCodeArena: Evaluarea generării de cod prin execuție efectivă și judecată comunitară

BigCodeArena revoluționează evaluarea modelelor AI de generare de cod prin introducerea execuției în timp real într-un mediu sandbox. Cu peste 14.000 de conversații și 4.700 de voturi colectate, platforma dezvăluie ierarhii clare între modelele de top precum o3-mini și cele open-source, subliniind că execuția efectivă este singura metodă fiabilă de judecare a calității codului.

Arm la Conferința PyTorch 2025: O nouă eră în dezvoltarea aplicațiilor AI

Arm participă la Conferința PyTorch 2025 (22-23 octombrie), invitând dezvoltatorii să exploreze noile tehnologii AI, să participe la ateliere de dezvoltare responsabilă și să contribuie la formarea viitoarelor instrumente software prin sesiuni dedicate de feedback și networking.

Nemotron-Personas-India: Date sintetice pentru dezvoltarea unei Inteligențe Artificiale Suverane

NVIDIA lansează Nemotron-Personas-India, primul set de date sintetice open-source pentru profiluri demografice indiene, facilitând dezvoltarea unor sisteme AI suverane, culturale și multilingve, protejând în același timp confidențialitatea datelor.

Ghid complet: Rularea modelelor VLM locale pe procesoare Intel în 3 pași simpli

Acest ghid detaliat explică cum să rulați modele VLM local pe procesoare Intel folosind Optimum Intel și OpenVINO. Aflați despre conversia modelului, tehnicile de cuantizare pentru eficiență și rezultatele benchmark-urilor care demonstrează creșteri semnificative de performanță.

Google Cloud C4 și Intel Xeon 6: O revoluție în eficiența costurilor pentru modelele AI de tip MoE

Noile instanțe Google Cloud C4, echipate cu procesoare Intel Xeon 6, demonstrează o reducere de 70% a Costului Total de Proprietate (TCO) pentru inferența modelelor AI MoE, grație optimizărilor hardware și software realizate în colaborare cu Hugging Face.

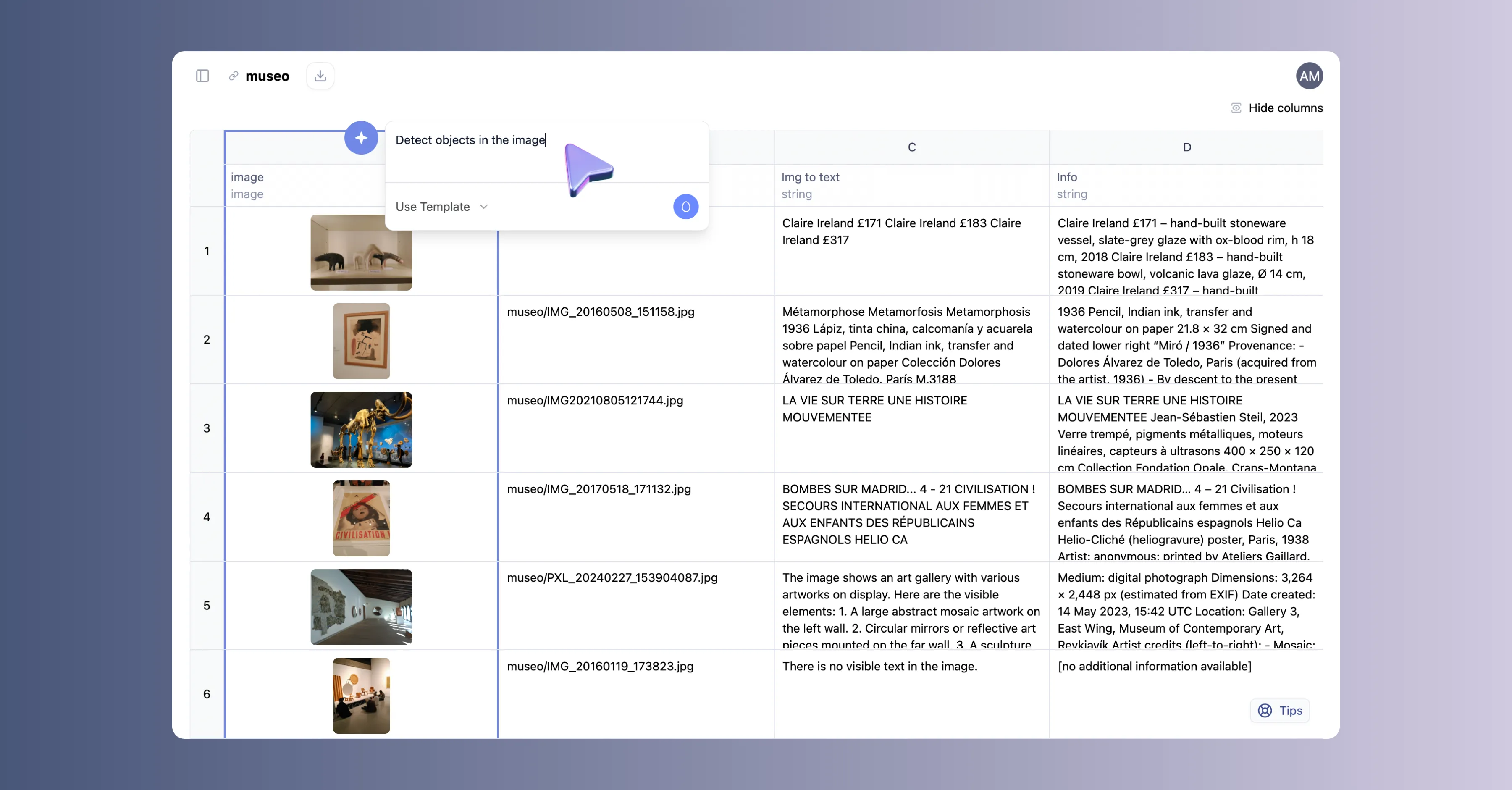

Deblochează puterea imaginilor cu AI Sheets: O nouă eră în procesarea vizuală a datelor

Hugging Face lansează un update major pentru AI Sheets, integrând capabilități de viziune artificială care permit extragerea de text din imagini, generarea și editarea vizuală direct în foi de calcul, democratizând accesul la modele AI complexe pentru utilizatori non-tehnici.

Sentence Transformers se alătură oficial familiei Hugging Face: Un nou capitol pentru procesarea semantică a limbajului

Biblioteca Sentence Transformers (SBERT), un instrument esențial pentru generarea de embedding-uri semantice, se alătură oficial Hugging Face. Fondat în 2019 la UKP Lab Darmstadt, proiectul a evoluat de la o soluție academică la un standard industrial cu peste 16.000 de modele și un milion de utilizatori, păstrându-și totodată angajamentul față de principiile open-source.

Construirea Ecosistemului Open Agent Împreună: Prezentarea OpenEnv

Meta-PyTorch și Hugging Face lansează OpenEnv, un standard deschis pentru medii agențiale care redefinesc antrenamentul și implementarea AI. Acest ecosistem oferă siguranță, scalabilitate și un cadru standardizat pentru dezvoltarea agenților autonomi.