În era inteligenței artificiale globale, o întrebare crucială devine tot mai presantă: pot modelele de limbaj de mari dimensiuni (LLM) să înțeleagă și să comunice eficient în limbi care nu sunt predominante în seturile de date de antrenament? Această provocare stă la baza dezvoltării FilBench, o suită de evaluare cuprinzătoare lansată pe 12 august 2025, menită să testeze capacitățile modelelor AI pentru limbile vorbite în arhipelagul filipinez.

Contextul și necesitatea unui benchmark regional

Deși limba engleză domină peisajul dezvoltării AI-ului, există mii de limbi vorbite în întreaga lume, fiecare cu structuri gramaticale, nuanțe culturale și particularități lingvistice unice. FilBench se concentrează pe Tagalog, Filipino (forma standardizată a Tagalog-ului) și Cebuano, oferind o perspectivă necesară asupra modului în care tehnologia interacționează cu diversitatea lingvistică din Asia de Sud-Est. Motivația acestui proiect este clară: lipsa unui instrument specializat care să evalueze nu doar fluența lingvistică, ci și cunoștințele culturale specifice și capacitatea de traducere fidelă.

Dezvoltatorii au creat FilBench ca un răspuns direct la această nevoie, construind o platformă capabilă să evalueze modelele pe patru categorii majore: Cunoștințe Culturale, NLP Clasic, Înțelegerea Textului și Generare. Aceste categorii sunt împărțite în 12 sarcini distincte, variind de la analiza sentimentelor până la traduceri complexe. Un aspect remarcabil este faptul că majoritatea conținutului din aceste categorii este format din text original, netradus, asigurând astfel autenticitatea evaluării și evitând distorsiunile care pot apărea în urma traducerilor automate.

Structura tehnică și metodologia de evaluare

Pentru a asigura rigurozitatea științifică, FilBench a fost construit pe baza unui studiu istoric al cercetării în procesarea limbajului natural (NLP) pentru limbile filipineze, acoperind perioada din 2006 până la începutul anului 2024. Această abordare asigură că benchmark-ul reflectă tendințele și prioritățile reale ale comunității științifice locale. Fiecare categorie oferă o metrică agregată, iar pentru a obține un scor reprezentativ unic, numit FilBench Score, se calculează o medie ponderată bazată pe numărul de exemple din fiecare categorie.

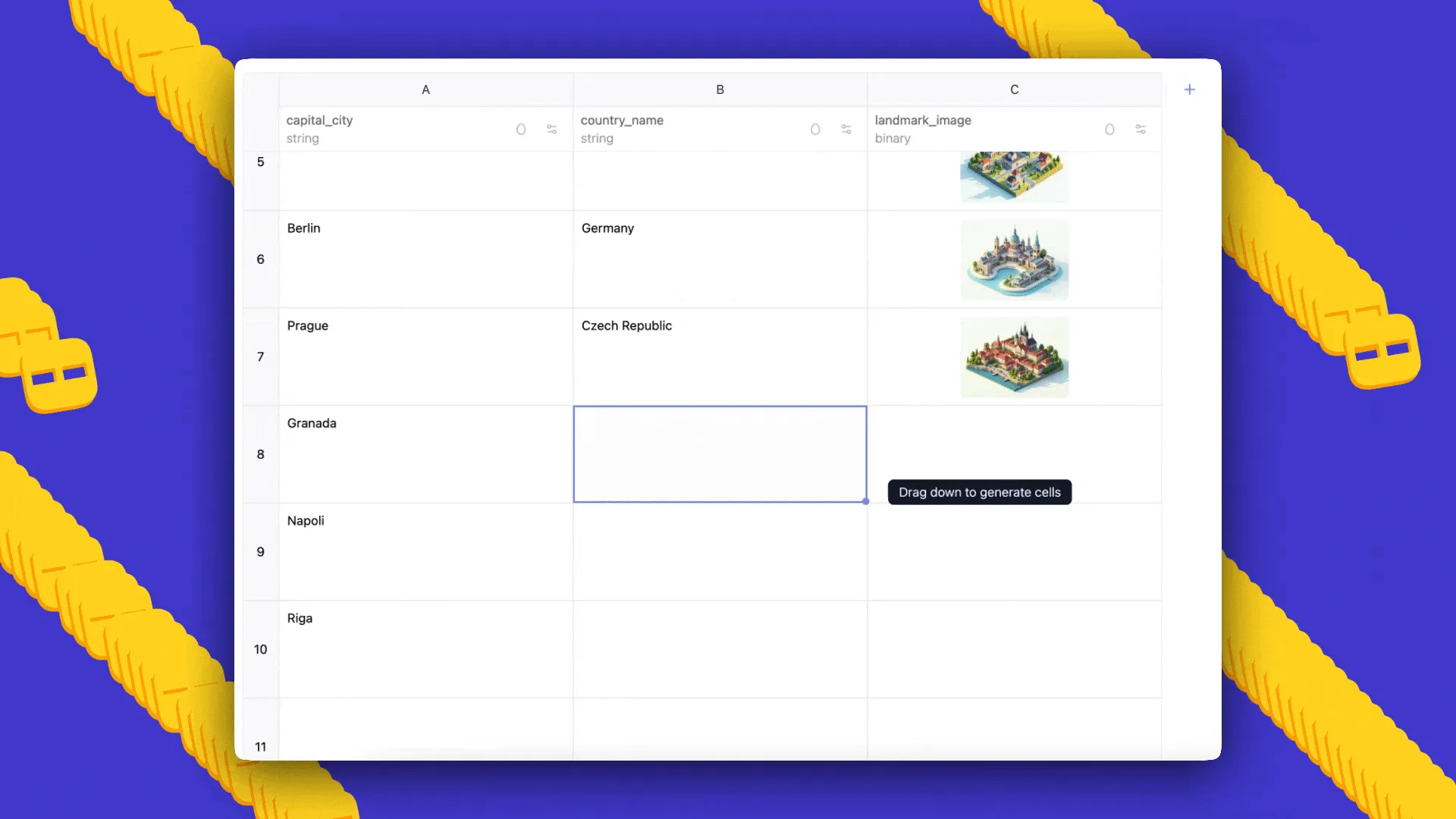

Din punct de vedere tehnic, FilBench este construit peste Lighteval, un cadru de evaluare „all-in-one” dezvoltat de Hugging Face. Această alegere simplifică utilizarea și configurarea, permițând dezvoltatorilor să definească perechi de traducere specifice pentru termeni comuni de evaluare, precum „yes” (oo), „no” (hindi) sau „true” (totoo). Suită este acum disponibilă ca un set de sarcini comunitare în depozitarul oficial Lighteval, facilitând accesul pentru cercetători și dezvoltatori din întreaga lume.

Principalele descoperiri și implicațiile lor

Evaluarea a cuprins peste 20 de modele LLM de ultimă generație, oferind o imagine clară a peisajului actual. Rezultatele au evidențiat trei concluzii majore care conturează direcția viitoare a cercetării în acest domeniu.

Prima concluzie subliniază un paradox interesant: deși modelele specifice regiunii rămân în urma gigantului GPT-4, eforturile de a colecta date pentru antrenarea acestora rămân o direcție promițătoare. În ultimii ani, am asistat la o creștere a modelelor LLM care vizează limbile din Asia de Sud-Est (SEA-specific), precum SEA-LION și SeaLLM. Aceste modele cu greutăți deschise, descărcabile liber de pe HuggingFace, s-au dovedit a fi cele mai eficiente parametric pentru limbile locale, obținând scoruri FilBench superioare altor modele de dimensiuni similare. Totuși, cel mai bun model specific regiunii este încă depășit de modelele cu sursă închisă, cum ar fi GPT-4o. Cu toate acestea, diferența nu este insurmontabilă; s-a observat o creștere a performanței cu 2-3% atunci când un model de bază este ajustat fin cu date de instruire specifice regiunii. Aceasta sugerează că investiția în curarea și curatoria datelor de antrenament filipineze rămâne extrem de relevantă.

A doua descoperire evidențiază dificultatea persistenta a traducerii. FilBench a arătat că, în categoria Generare, majoritatea modelelor întâmpină dificultăți semnificative. Analiza modurilor de eșec a relevat probleme precum nerespectarea instrucțiunilor de traducere, generarea de texte excesiv de verbose sau, și mai grav, halucinarea unei alte limbi în loc să utilizeze Tagalog sau Cebuano. Această descoperire subliniază complexitatea limbilor filipineze și necesitatea unor modele care să înțeleagă nu doar vocabularul, ci și contextul cultural și structura sintactică specifică.

A treia concluzie aduce în discuție aspectul economic și accesibilitatea. Filipinele se confruntă cu o infrastructură internet limitată și venituri medii mai scăzute, ceea ce face ca accesibilitatea modelelor AI să fie o necesitate, nu un lux. FilBench a permis identificarea modelelor aflate pe frontiera eficienței Pareto. Concluzia este clară: modelele LLM cu greutăți deschise sunt mult mai ieftine decât cele comerciale, fără a sacrifica semnificativ performanța. Pentru cei care caută o alternativă la GPT-4o pentru sarcini în limba filipineză, recomandarea cercetătorilor este Llama 4 Maverick, un model care echilibrează excelent costul cu capacitatea computațională.

Impactul asupra comunității și viitorul cercetării

Lansarea FilBench nu reprezintă doar un instrument de evaluare tehnică, ci și un catalizator pentru avansarea cercetării NLP în Filipine. Prin punerea la dispoziție a unui clasament public pe Hugging Face Space, autorii speră să ofere o imagine clară a capacităților modelelor actuale și să încurajeze dezvoltarea de soluții mai adaptate contextului local.

Proiectul a beneficiat de sprijinul Cohere Labs, prin granturi de cercetare care au permis rularea seriei de modele Aya, și de credite computaționale de la Together AI. Recunoașterea merge și către echipa Hugging Face, în special către echipa OpenEvals (Clémentine Fourrier și Nathan Habib) și Daniel van Strien, pentru suportul tehnic și editorial.

În concluzie, FilBench marchează un pas important spre democratizarea inteligenței artificiale. Dovedind că modelele regionale pot fi competitive și că există o cale eficientă din punct de vedere a costurilor pentru implementarea AI în țări în dezvoltare, acest benchmark deschide uși pentru inovație locală. Pe măsură ce tehnologia continuă să evolueze, instrumente precum FilBench vor fi esențiale pentru a ne asigura că progresul AI-ului este inclusiv și reflectă diversitatea lingvistică a lumii noastre.

🇵🇭 FilBench: Pot modelele de limbaj să înțeleagă și să genereze filipineză?