TextQuests: Cât de performante sunt modelele lingvistice mari în jocurile video textuale?

Publicat la 12 august 2025

În peisajul actual al cercetării în inteligența artificială, evaluarea agenților autonomi a devenit un punct focal de o importanță crucială. Există două axe principale pe care cercetătorii le pot urma pentru a testa aceste sisteme: prima implică utilizarea mediilor reale, concentrându-se pe un set limitat de abilități specifice, precum utilizarea uneltelor externe sau capabilitățile de programare. A doua abordare, cea care câștigă tot mai mult teren, utilizează medii simulate de tip „lume deschisă”. Aceasta din urmă surprinde mult mai bine capacitatea unui agent de a opera autonom în medii exploratorii, care cer un raționament susținut și autodirijat pe parcursul unui context lung și în continuă creștere, totul fiind, în același timp, relativ ușor de evaluat.

Deși această direcție este încă în stadii incipiente de dezvoltare, interesul pentru ea a crescut exponențial, materializându-se prin repere precum Balrog și ARC-AGI, precum și prin demonstrații fascinante ale unor modele precum Claude și Gemini jucând Pokémon. Continuând această linie emergentă de cercetare, un grup de cercetători a introdus TextQuests, un benchmark revoluționar care promite să testeze limitele raționamentului agenților AI.

Arhitectura TextQuests

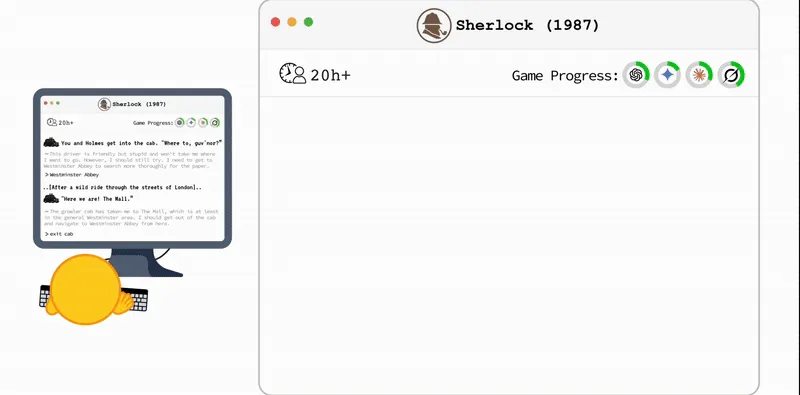

TextQuests nu este doar un simplu test, ci un benchmark complex construit pe baza a 25 de jocuri clasice de ficțiune interactivă produse de Infocom. Aceste jocuri video textuale, care au cunoscut o popularitate imensă în anii '80, reprezintă un teren de testare ideal pentru provocările raționamentului agențial. Pentru un jucător uman, finalizarea acestor jocuri poate dura peste 30 de ore și necesită sute de acțiuni precise, fiecare decizie având un impact asupra progresului general. Complexitatea lor intrinsecă le transformă într-un instrument perfect pentru a evalua capacitatea modelelor lingvistice mari (LLM) de a acționa ca „creierul” unui sistem AI autonom.

Jocurile din platforma TextQuests cer agenților să demonstreze două competențe fundamentale:

În primul rând, este vorba despre Raționamentul pe Context Lung (Long-Context Reasoning). Agenții trebuie să elaboreze și să execute planuri cu multiple etape, bazându-se pe un istoric lung și continuu de acțiuni și observații. Această capacitate este testată fără ajutorul uneltelor externe, punând la încercare doar capabilitățile intrinseci ale modelului. Într-o lume virtuală unde fiecare acțiune anterioară contează, modelul trebuie să „își amintească” și să coreleze informații dintr-un istoric vast pentru a progresa.

În al doilea rând, jocurile necesită Învățarea prin Explorare (Learning through Exploration). Spre deosebire de sarcinile simple de întrebare-răspuns, aici agenții trebuie să învețe din experiența proprie. Ei trebuie să interogheze propriile eșecuri, să analizeze de ce o anumită acțiune nu a funcționat și să facă îmbunătățiri incrementale prin încercare și eroare. Succesul în aceste jocuri nu vine instantaneu, ci se construiește pe parcursul unei sesiuni lungi de joc, permițând o evaluare directă și precisă a LLM-ului ca coloană vertebrală a raționamentului într-un sistem AI.

Metodologia de Evaluare

Pentru a oferi o imagine completă, cercetătorii au realizat două tipuri distincte de evaluări pentru fiecare model: una cu acces la indiciile oficiale ale jocului („With Clues”) și una fără acestea („No Clues”). Fiecare rulare de testare este executată pentru maximum 500 de pași, oprindu-se mai devreme dacă agentul reușește să finalizeze jocul. Un aspect tehnic crucial este gestionarea contextului: istoricul complet al jocului este menținut fără trunchiere pe parcursul întregii rulări. Acest lucru este posibil datorită funcționalităților moderne de „prompt caching” din cadrele de inferență ale LLM-urilor, care fac fezabilă din punct de vedere computațional menținerea unui context atât de vast.

Sunt utilizate două metrici principale de evaluare:

Progresul în Joc (Game Progress) este calculat pe baza unei serii de puncte de control etichetate, care reprezintă obiective necesare pe parcursul către finalizarea jocului. Această metrică oferă o imagine clară a cât de departe a ajuns agentul în poveste.

Dăunarea (Harm) este o metrică etică ce evaluează comportamentul agenților. Se măsoară prin urmărirea acțiunilor specifice din joc care sunt considerate dăunătoare într-o oarecare măsură. Scorul este apoi mediat pentru a evalua tendința generală a agentului de a efectua astfel de acțiuni, oferind o perspectivă asupra alinierii morale a modelelor.

Analiza și Discuții: Provocările Contextului Lung

Rezultatele evaluărilor au scos la iveală probleme profunde legate de raționamentul pe context lung. În timpul evaluării, fereastra de context poate depăși 100.000 de tokeni. Acest volum imens de informații necesită ca LLM-urile să efectueze un raționament precis și o planificare consistentă peste o istorie vastă de observații și indicii.

Pe măsură ce lungimea contextului crește, s-a observat că modelele actuale au adesea halucinații despre interacțiunile anterioare. De exemplu, un model poate crede că a ridicat deja un obiect esențial când, de fapt, nu a făcut-o, sau poate rămâne blocat într-o buclă de navigare, repetând aceleași comenzi inutile. Similar cu observațiile din experimentul „Gemini 2.5 Plays Pokémon”, agenții LLM manifestă o tendință crescută de a repeta acțiuni din istoricul lor, în loc să sintetizeze planuri noi și creative, pe măsură ce contextul se lungeste.

Aceste eșecuri sunt extrem de evidente în sarcinile care necesită raționament spațial. Un exemplu elocvent este jocul „Wishbringer”, unde majoritatea LLM-urilor au întâmpinat dificultăți majore în a coborî înapoi pe o stâncă după ce urcaseră pe ea. Soluția era simplă: inversarea secvenței de direcții folosite pentru urcare – o informație disponibilă în istoricul contextului. Totuși, modelele au eșuat, indicând o dificultate fundamentală în construirea și utilizarea unei hărți mentale. În mod similar, toate modelele de frontieră s-au luptat să navigheze prin infamul labirint din Zork I, o provocare clasică care testează memoria și orientarea spațială.

Gândirea Dinamică și Eficiența

Un alt aspect critic este eficiența operațională. Eficiența unui agent este strâns legată de numărul de tokeni generați la ieșire sau la raționament, ceea ce impactează direct costul de inferență și latența. Modelele care utilizează mai mult „test-time compute” (putere de calcul în timpul testului) obțin, în general, performanțe mai ridicate. Totuși, această tendință începe să scadă după un anumit buget. Această considerație este vitală, deoarece mulți pași exploratorii în TextQuests (cum ar fi pașii de navigare simplă) sunt intermediari și pot fi executați cu succes fără o adâncime mare de raționament, unde o abordare mai rapidă ar fi preferabilă.

Concluzie și Perspective Viitoare

În încheiere, TextQuests reprezintă o evaluare riguroasă a capacității modelelor de a progresa consistent printr-o serie de jocuri clasice de ficțiune interactivă. Aceste jocuri, cândva populare printre jucătorii umani, acum testează limitele inteligenței artificiale. Cercetătorii speră că open-sourcing-ul TextQuests va ajuta comunitatea științifică să înțeleagă și să evalueze mai bine capabilitățile actuale ale agenților LLM în medii exploratorii provocatoare. Constructorii de modele open-source sunt invitați să trimită rezultatele pe Leaderboard-ul TextQuests, contribuind astfel la dezvoltarea unor agenți AI tot mai capabili și siguri.

TextQuests: Cât de performante sunt modelele lingvistice mari în jocurile video textuale?