Subiect: #AI

Construirea serverului MCP Hugging Face: O călătorie tehnică prin standardul de conectare a asistenților AI

Echipa Hugging Face detaliază procesul de construire a unui server MCP (Model Context Protocol) remote, explicând alegerile tehnice dintre transportele STDIO, SSE și Streamable HTTP, și argumentând decizia de a utiliza o configurație Stateless cu Direct Response pentru scalabilitate și eficiență în accesul la Hub.

ScreenEnv: Revoluționarea automatizării desktop prin agenți AI – Mediu sandboxat, control total și integrare flexibilă

ScreenEnv reprezintă o soluție inovatoare pentru automatizarea desktop și dezvoltarea agenților AI, oferind un mediu sandboxat complet care rulează în Docker. Cu control total asupra interfeței grafice și integrare flexibilă prin API direct sau MCP, instrumentul simplifică drastic procesul de creare a agenților capabili să execute sarcini complexe, deschizând calea către automatizarea cross-platform.

Ettin Suite: O nouă eră în arhitectura AI – Encodere și Decodere de ultimă generație

Ettin Suite introduce primele modele pereche (encodere și decodere) antrenate identic, oferind o comparație riguroasă și performanțe de ultimă oră. Proiectul depășește standardele actuale precum ModernBERT și Llama 3.2, demonstrând superioritatea specifică a fiecărei arhitecturi în funcție de task-ul dorit.

Cinci îmbunătățiri majore aduse serverelor Gradio MCP: Suport fișiere locale, notificări în timp real și integrare API automatizată

Versiunea Gradio 5.38.0 aduce cinci inovații majore pentru serverele MCP: suport automat pentru încărcarea fișierelor locale, notificări de progres în timp real, transformarea specificațiilor OpenAPI în servere MCP printr-o singură linie de cod, îmbunătățiri ale autentificării prin header-e și posibilitatea personalizării descrierilor instrumentelor.

TimeScope: Până unde poate ajunge înțelegerea video în modelele multimodale avansate?

TimeScope este un benchmark open-source care testează limitele reale ale modelelor AI în înțelegerea videoclipurilor de lungă durată, dezvăluind diferența dintre promisiunile de marketing și performanța efectivă în sarcini complexe de sinteză și raționament temporal.

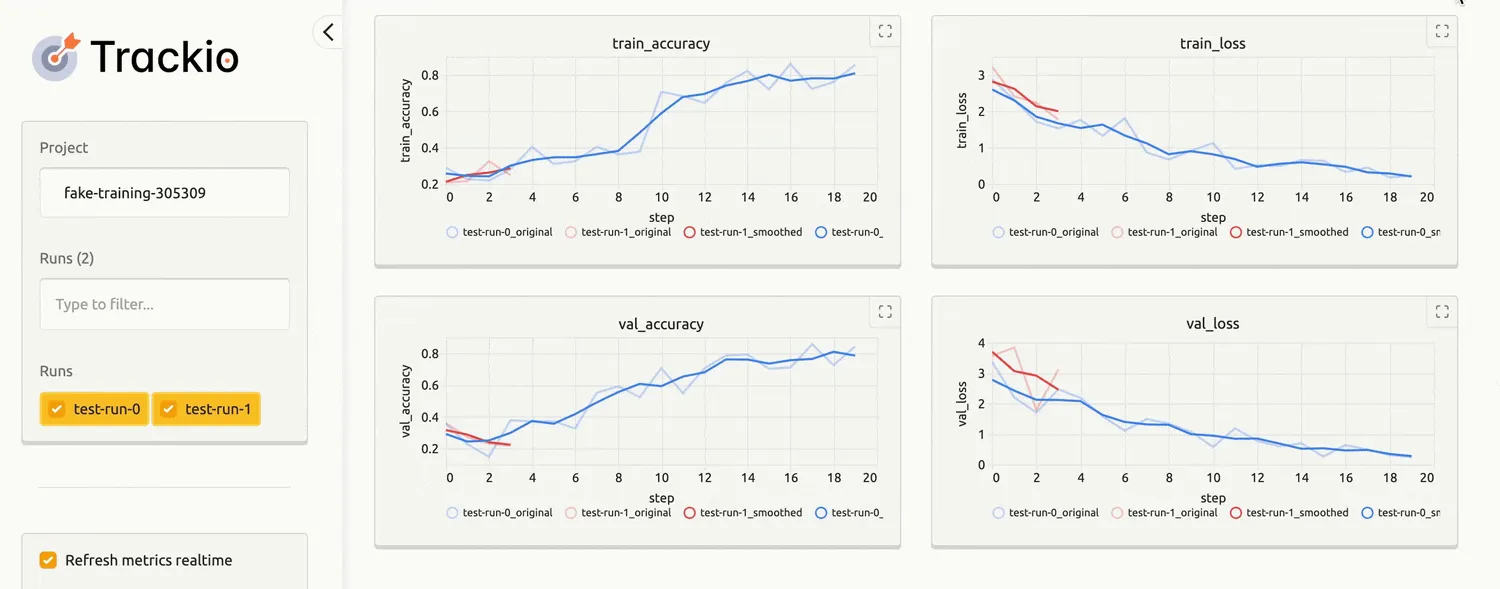

Prezentare Trackio: O bibliotecă ușoară pentru urmărirea experimentelor de la Hugging Face

Hugging Face lansează Trackio, o bibliotecă Python open-source și ușoară pentru urmărirea experimentelor de machine learning, oferind o alternativă gratuită și flexibilă, cu integrare nativă în ecosistemul Hugging Face și focus pe transparență și simplitate.

Implementarea serverelor MCP în Python: Un asistent AI pentru cumpărături cu Gradio

Acest articol detaliază procesul de creare a unui asistent AI pentru cumpărături folosind Python, Gradio și protocolul MCP. Explorăm integrarea modelului IDM-VTON pentru încercări virtuale de haine și configurarea mediului VS Code pentru o interacțiune seamless cu agentul AI.

📚 3LM: Un nou punct de referință pentru modelele de limbaj arabe în domeniile STEM și programare

3LM (علم) reprezintă primul benchmark dedicat evaluării modelelor de limbaj arabe în domeniile STEM și generarea de cod, adresând o lacună majoră în peisajul actual al NLP-ului arab prin introducerea a trei seturi de date distincte: întrebări educaționale native, întrebări sintetice de dificultate ridicată și sarcini de programare traduse.

Accelerate ND-Parallel: Ghid complet pentru antrenarea eficientă pe mai multe GPU-uri

Pe măsură ce modelele de inteligență artificială cresc la dimensiuni de zeci sau sute de miliarde de parametri, provocarea principală devine gestionarea memoriei și comunicarea între dispozitive. Acest ghid explorează strategiile de paralelism — de la Data Parallelism la tehnici avansate precum Tensor Parallelism și Fully Sharded Data Parallelism — oferind o perspectivă detaliată asupra modului în care acestea pot fi combinate pentru a optimiza antrenarea modelelor la scară largă.

Ochelarii inteligenti Ray-Ban cu rețetă de la Meta: o lovitură strategică de distribuție, nu un salt tehnologic

Meta lansează modelele de ochelari inteligenti Ray-Ban destinate purtătorilor de lentile corectoare, o mișcare strategică ce vizează capturarea unei cote semnificative din piața globală de optică, transformând o necesitate medicală într-o poartă de acces către ecosistemul AI.

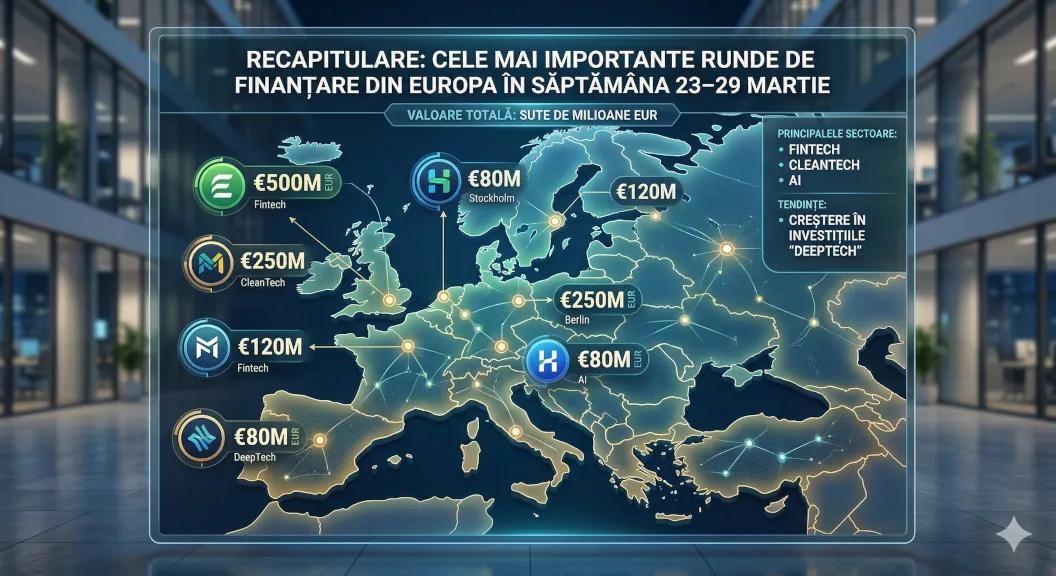

Recapitulare: Cele mai importante runde de finanțare din Europa în săptămâna 23–29 martie

Săptămâna 23-29 martie a adus o serie de finanțări semnificative în ecosistemul european, evidențiind o tendință clară de susținere a infrastructurii critice. De la tehnologia semiconductorilor Kandou AI, care a ridicat 225 de milioane de dolari, până la fondul Air Street Capital și aplicația Granola, investitorii pariază pe fundațiile tehnologice care vor defini viitorul.

Tehnologia Neural Super Sampling a ajuns și pe mobil: Arm revoluționează grafica din jocuri prin inteligența artificială

Arm lansează Neural Super Sampling (NSS), o tehnologie revoluționară de upscaling bazată pe AI, care reduce încărcarea GPU cu 50% și permite randarea 1080p din 540p în doar 4ms. Optimizată pentru dispozitive mobile și integrată în Unreal Engine, NSS deschide calea către grafică de înaltă fidelitate cu consum redus de energie.