Cinci îmbunătățiri majore aduse serverelor Gradio MCP: Suport fișiere locale, notificări în timp real și integrare API automatizată

Versiunea Gradio 5.38.0 aduce cinci inovații majore pentru serverele MCP: suport automat pentru încărcarea fișierelor locale, notificări de progres în timp real, transformarea specificațiilor OpenAPI în servere MCP printr-o singură linie de cod, îmbunătățiri ale autentificării prin header-e și posibilitatea personalizării descrierilor instrumentelor.

Înapoi în Viitor: Evaluarea Agenților AI în Predicția Evenimentelor Viitoare

Un nou benchmark revoluționar, FutureBench, propune evaluarea agenților AI pe baza capacității lor de a prezice evenimente viitoare, trecând de la testarea memorării faptelor istorice la măsurarea raționamentului complex și a înțelegerii cauzale.

Consilium: Când modelele de limbaj colaborează – O revoluție în inteligența artificială distribuită

Consilium reprezintă o platformă revoluționară care permite multiplelor modele de limbaj mari (LLM) să colaboreze și să discute pentru a atinge consensuri, depășind limitările analizei individuale și validată de cercetări recente care arată că sistemele multi-AI pot atinge 85.5% acuratețe în diagnostic medical comparativ cu doar 20% pentru medicii umani.

Arc Virtual Cell Challenge: O inițiere în modelarea celulară virtuală

Arc Virtual Cell Challenge propune o revoluție în biologia computațională: antrenarea unui model AI capabil să simuleze efectele perturbărilor genetice fără a necesita experimente fizice costisitoare. Articolul explorează arhitectura modelului STATE, utilizarea modelelor de limbaj proteic și metricile complexe de evaluare.

Accelerarea implementării modelelor lingvistice mari (LLM) de pe Hugging Face prin NVIDIA NIM: O revoluție în infrastructura AI enterprise

NVIDIA anunță integrarea microserviciilor NIM cu platforma Hugging Face, deblocând accesul rapid la peste 100.000 de modele LLM. Soluția oferă un singur container Docker capabil să optimizeze automat implementarea, detectând arhitectura și selectând backend-ul ideal pentru performanță maximă.

Inferență rapidă cu LoRA pentru Flux utilizând Diffusers și PEFT: Ghid complet de optimizare

Un ghid tehnic detaliat despre optimizarea inferenței modelului Flux.1-Dev folosind LoRA, Diffusers și PEFT, acoperind strategii de la hotswapping fără recompilare până la rularea eficientă pe GPU-uri de consum precum RTX 4090.

TimeScope: Până unde poate ajunge înțelegerea video în modelele multimodale avansate?

TimeScope este un benchmark open-source care testează limitele reale ale modelelor AI în înțelegerea videoclipurilor de lungă durată, dezvăluind diferența dintre promisiunile de marketing și performanța efectivă în sarcini complexe de sinteză și raționament temporal.

Prezentarea noii interfețe `hf`: un CLI Hugging Face mai rapid și mai prietenos ✨

Hugging Face lansează un nou CLI, `hf`, înlocuind vechiul `huggingface-cli` cu o structură mai clară și intuitivă. Noul instrument aduce o organizare logică a comenzilor, suport pentru migrare și introduce serviciul Hugging Face Jobs pentru rularea de scripturi pe infrastructură dedicată, cu facturare pay-as-you-go.

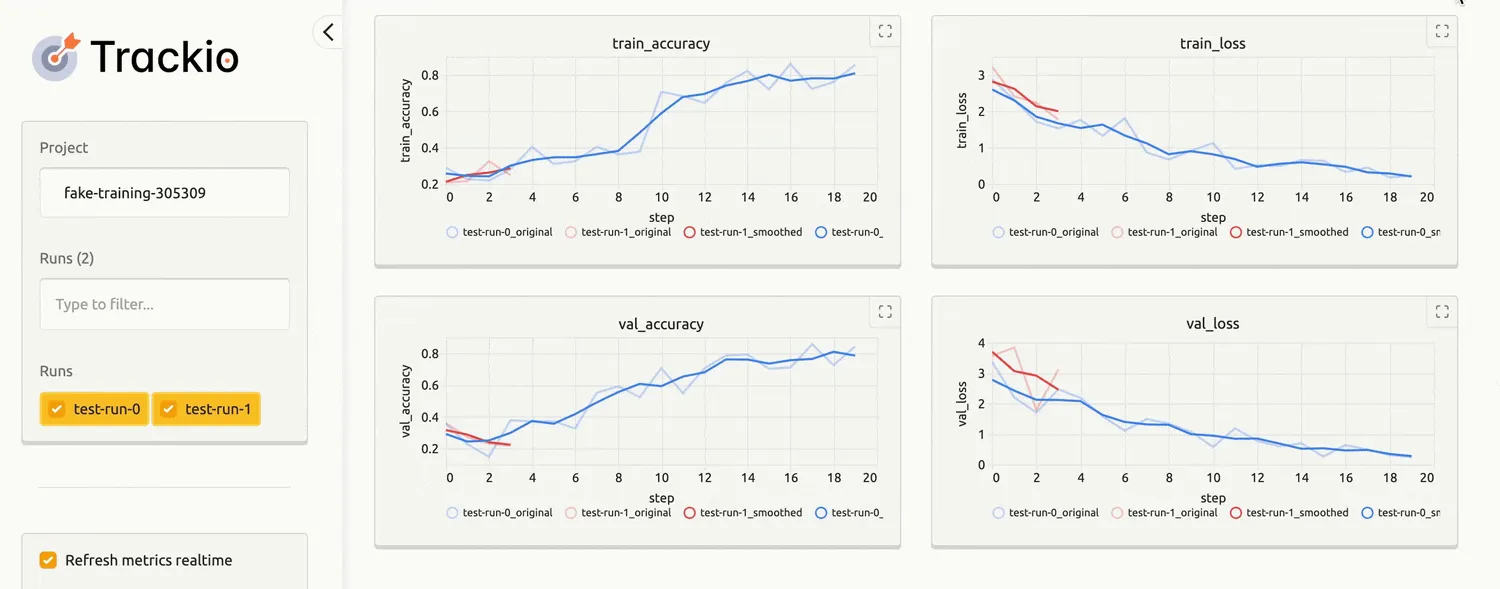

Prezentare Trackio: O bibliotecă ușoară pentru urmărirea experimentelor de la Hugging Face

Hugging Face lansează Trackio, o bibliotecă Python open-source și ușoară pentru urmărirea experimentelor de machine learning, oferind o alternativă gratuită și flexibilă, cu integrare nativă în ecosistemul Hugging Face și focus pe transparență și simplitate.

Implementarea serverelor MCP în Python: Un asistent AI pentru cumpărături cu Gradio

Acest articol detaliază procesul de creare a unui asistent AI pentru cumpărături folosind Python, Gradio și protocolul MCP. Explorăm integrarea modelului IDM-VTON pentru încercări virtuale de haine și configurarea mediului VS Code pentru o interacțiune seamless cu agentul AI.

📚 3LM: Un nou punct de referință pentru modelele de limbaj arabe în domeniile STEM și programare

3LM (علم) reprezintă primul benchmark dedicat evaluării modelelor de limbaj arabe în domeniile STEM și generarea de cod, adresând o lacună majoră în peisajul actual al NLP-ului arab prin introducerea a trei seturi de date distincte: întrebări educaționale native, întrebări sintetice de dificultate ridicată și sarcini de programare traduse.

NVIDIA AI-Q și modelele Llama Nemotron: O nouă eră pentru agenții de cercetare open-source

NVIDIA AI-Q Blueprint, un agent de cercetare profund open-source, a atins performanțe de top pe DeepResearch Bench, demonstrând că modelele deschise pot depăși alternativele proprietare. Arhitectura combină modelele Llama 3.3 și Nemotron pentru a oferi raționament complex, transparență totală și implementare flexibilă.

Bun venit GPT OSS, noua familie de modele open-source de la OpenAI!

OpenAI lansează familia de modele GPT OSS sub licență Apache 2.0, marcând un angajament major față de comunitatea open-source. Cu arhitecturi MoE eficiente de 21B și 117B parametri, optimizări precum cuantizarea mxfp4 și Flash Attention 3, modelele pot rula local pe GPU-uri consumer, democratizând accesul la AI de ultimă generație.