Subiect: #Benchmark

GPT-5.5: Cel mai avansat model AI agentic al OpenAI până în prezent

OpenAI a lansat GPT-5.5, cel mai avansat model AI agentic, cu performanțe superioare pe benchmark-uri cheie, dar cu prețuri duble față de predecesor. Articolul analizează capabilitățile, costurile și implicațiile pentru utilizatori.

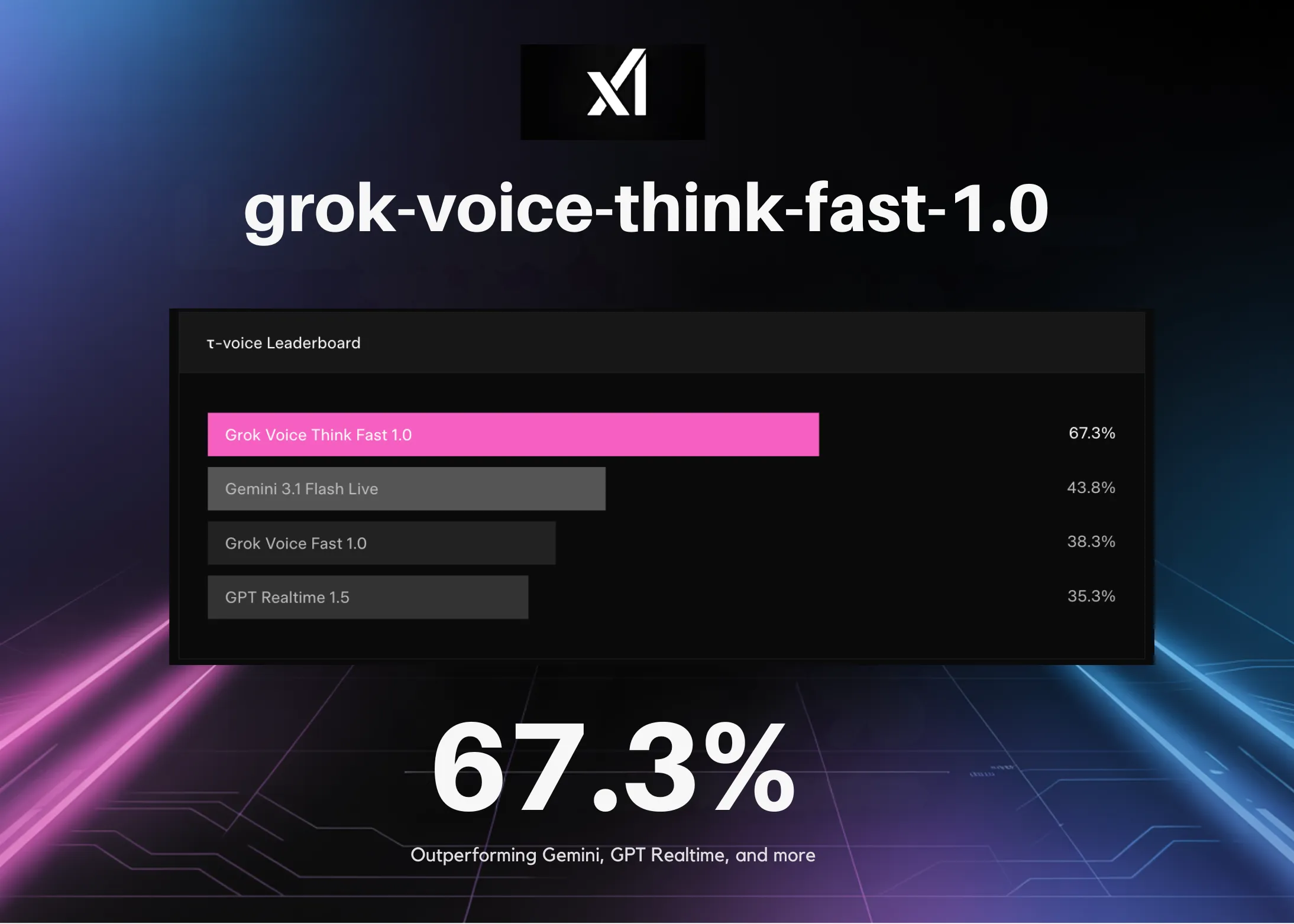

xAI lansează grok-voice-think-fast-1.0: Depășește τ-voice Bench cu 67,3%, surclasând Gemini, GPT Realtime și altele

xAI a lansat grok-voice-think-fast-1.0, un model vocal care a obținut 67,3% pe benchmark-ul τ-voice, depășind Gemini, GPT Realtime și altele. Articolul analizează tehnologia, performanța, aplicațiile și impactul asupra industriei AI.

Sierra, compania lui Bret Taylor, achiziționează startup-ul YC Fragment pentru a întări capacitățile de AI în Europa

Sierra, companía fondată de Bret Taylor și Clay Bavor, a achiziționat startup-ul francez Fragment, sprijinit de Y Combinator, pentru a întări echipa de dezvoltare a agenților AI în Europa — o mișcare care subliniază shift-ul spre AI locală, responsabilă și integrată în piețele regionale.

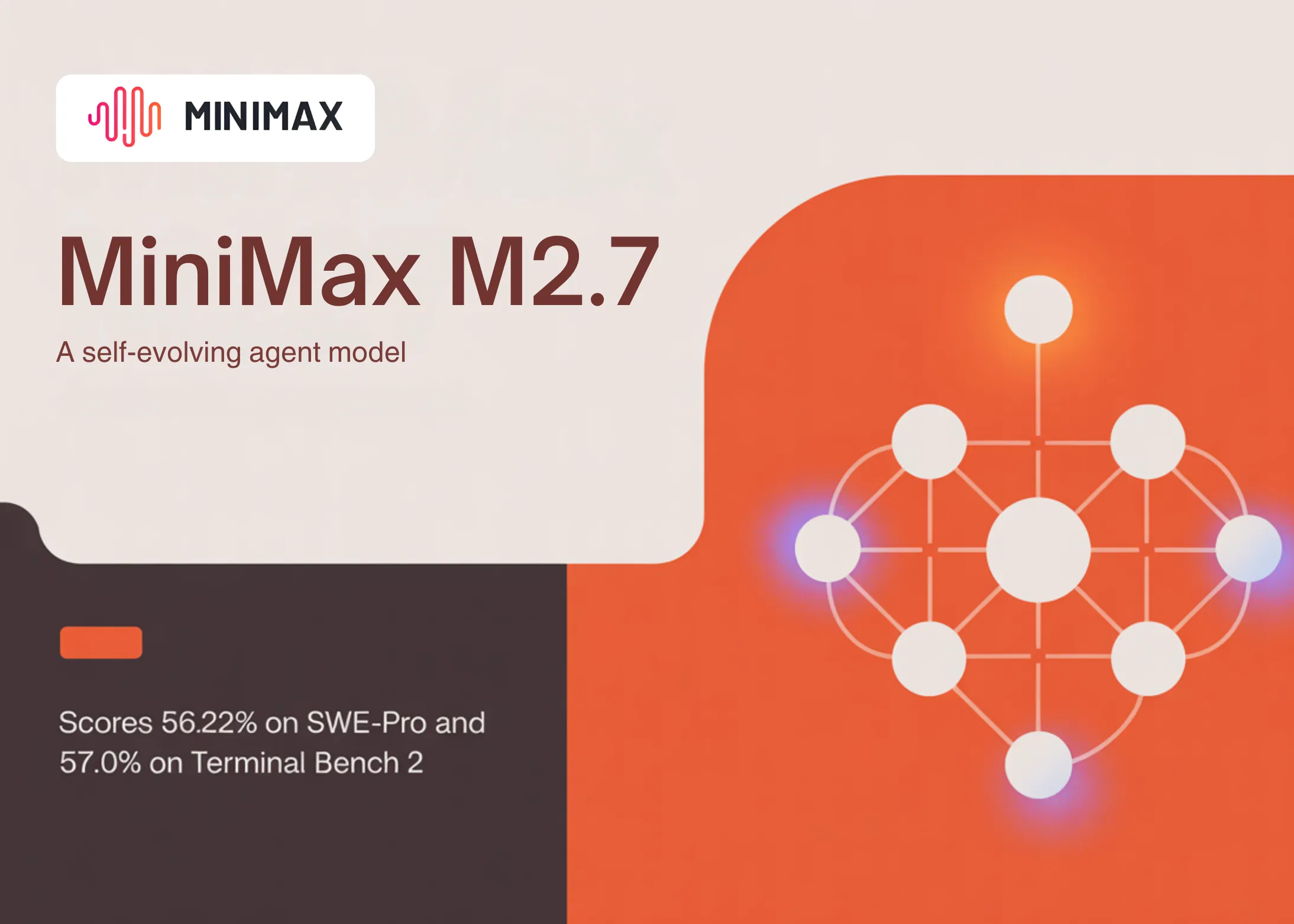

MiniMax a Lansat Open-Source MiniMax M2.7: Un Model de Agent Auto-Evolutiv care Obține 56,22% pe SWE-Pro și 57,0% pe Terminal Bench 2

MiniMax a lansat open-source modelul M2.7, un agent AI auto-evolutiv care obține rezultate impresionante: 56,22% pe SWE-Pro și 57,0% pe Terminal Bench 2, demonstrând capacitatea sistemelor de a se îmbunătăți autonom.

Cum să Construiești și să Evoluezi un Agent OpenAI Personalizat cu A-Evolve: Benchmarks, Abilități, Memorie și Mutații ale Spațiului de Lucru

Ghid complet pentru dezvoltarea agenților OpenAI adaptivi folosind framework-ul A-Evolve, cu accent pe benchmarks, abilități, memorie pe termen lung și mutații ale spațiului de lucru.

Înapoi în Viitor: Evaluarea Agenților AI în Predicția Evenimentelor Viitoare

Un nou benchmark revoluționar, FutureBench, propune evaluarea agenților AI pe baza capacității lor de a prezice evenimente viitoare, trecând de la testarea memorării faptelor istorice la măsurarea raționamentului complex și a înțelegerii cauzale.

TimeScope: Până unde poate ajunge înțelegerea video în modelele multimodale avansate?

TimeScope este un benchmark open-source care testează limitele reale ale modelelor AI în înțelegerea videoclipurilor de lungă durată, dezvăluind diferența dintre promisiunile de marketing și performanța efectivă în sarcini complexe de sinteză și raționament temporal.

📚 3LM: Un nou punct de referință pentru modelele de limbaj arabe în domeniile STEM și programare

3LM (علم) reprezintă primul benchmark dedicat evaluării modelelor de limbaj arabe în domeniile STEM și generarea de cod, adresând o lacună majoră în peisajul actual al NLP-ului arab prin introducerea a trei seturi de date distincte: întrebări educaționale native, întrebări sintetice de dificultate ridicată și sarcini de programare traduse.

TextQuests: Cât de performante sunt modelele lingvistice mari în jocurile video textuale?

TextQuests este un nou benchmark bazat pe 25 de jocuri clasice de ficțiune interactivă, menit să evalueze capacitatea modelelor lingvistice mari de a raționa pe termen lung și de a învăța prin explorare, relevând dificultăți semnificative în raționamentul spațial și gestionarea contextului extins.

Gaia2 și ARE: Noile Frontiere în Evaluarea și Dezvoltarea Agenților AI Autonomi

Lansarea Gaia2 și a framework-ului Meta Agents Research Environments (ARE) marchează o evoluție majoră în evaluarea agenților AI, trecând de la teste statice la scenarii interactive complexe, care includ gestionarea timpului, ambiguității și eșecurilor tehnice.

Prezentând RTEB: Un Noua Standard pentru Evaluarea Recuperării Datelor în Era Inteligenței Artificiale

RTEB (Retrieval Embedding Benchmark) redefinesc evaluarea modelelor de embedding prin utilizarea unei strategii hibride, care combină seturi de date deschise și private pentru a combate supra-ajustarea și a oferi o măsură reală a capacității de generalizare în domenii precum finanțe, drept, cod și sănătate.

BigCodeArena: Evaluarea generării de cod prin execuție efectivă și judecată comunitară

BigCodeArena revoluționează evaluarea modelelor AI de generare de cod prin introducerea execuției în timp real într-un mediu sandbox. Cu peste 14.000 de conversații și 4.700 de voturi colectate, platforma dezvăluie ierarhii clare între modelele de top precum o3-mini și cele open-source, subliniind că execuția efectivă este singura metodă fiabilă de judecare a calității codului.