Subiect: #Machine Learning

Batching continuu: De la primele principii la optimizarea inferenței AI

Articolul explorează mecanismele fundamentale ale inferenței în modelele de limbaj de mari dimensiuni, de la atenție și KV caching până la batching-ul continuu, explicând cum aceste tehnici optimizează throughput-ul în scenarii de servire în sarcină ridicată.

Diffusers întâmpină cu brațele deschise noul model FLUX.2: O revoluție în generația imaginelor prin inteligență artificială

Black Forest Labs lansează FLUX.2, un model revoluționar de generare a imaginilor, integrat în ecosistemul Hugging Face Diffusers. Cu o arhitectură nouă, bazată pe un singur encoder de text (Mistral Small 3.1) și un DiT optimizat, FLUX.2 oferă capacități avansate de editare și generare ghidată de imagini multiple, fiind accesibil și pe hardware-uri cu resurse limitate datorită tehnicilor de cuantizare și offloading.

DeepMath: Un agent ușor de raționament matematic, construit cu smolagents

DeepMath este un agent inovator de raționament matematic bazat pe modelul Qwen3-4B, care utilizează fragmente de cod Python executate într-un mediu securizat pentru a reduce erorile și lungimea output-ului cu până la 66%, demonstrând că modelele mici pot depăși limitările tradiționale ale LLM-urilor prin antrenament GRPO și arhitecturi hibride.

Prezentare swift-huggingface: Clientul Swift complet pentru ecosistemul Hugging Face

swift-huggingface este o bibliotecă Swift completă pentru Hugging Face, care rezolvă problemele de fiabilitate la descărcarea modelelor, introduce autentificare flexibilă (inclusiv OAuth) și permite partajarea cache-ului cu ecosistemul Python, optimizând fluxul de lucru pentru dezvoltatorii de AI pe platformele Apple.

Differential Transformer V2: O nouă eră în eficiența și stabilitatea modelelor de limbaj de mari dimensiuni

Differential Transformer V2 (DIFF V2) revoluționează arhitectura LLM prin optimizarea eficienței inferenței și eliminarea instabilității numerice specifice versiunii anterioare. Prin dublarea capetelor de interogare și o nouă operație diferențială, modelul depășește constrângerile Softmax, oferind o decodare rapidă fără a necesita nuclee personalizate.

AssetOpsBench: Puntea dintre benchmark-urile AI și realitatea industrială – Un nou standard pentru evaluarea agenților inteligenți

AssetOpsBench reprezintă o evoluție necesară în evaluarea agenților AI, trecând de la simplul succes binar la o analiză complexă a eșecurilor în medii industriale reale. Acest cadru innovator evidențiază lacunele critice ale modelelor actuale în coordonarea multi-agent și gestionarea incertitudinii operaționale.

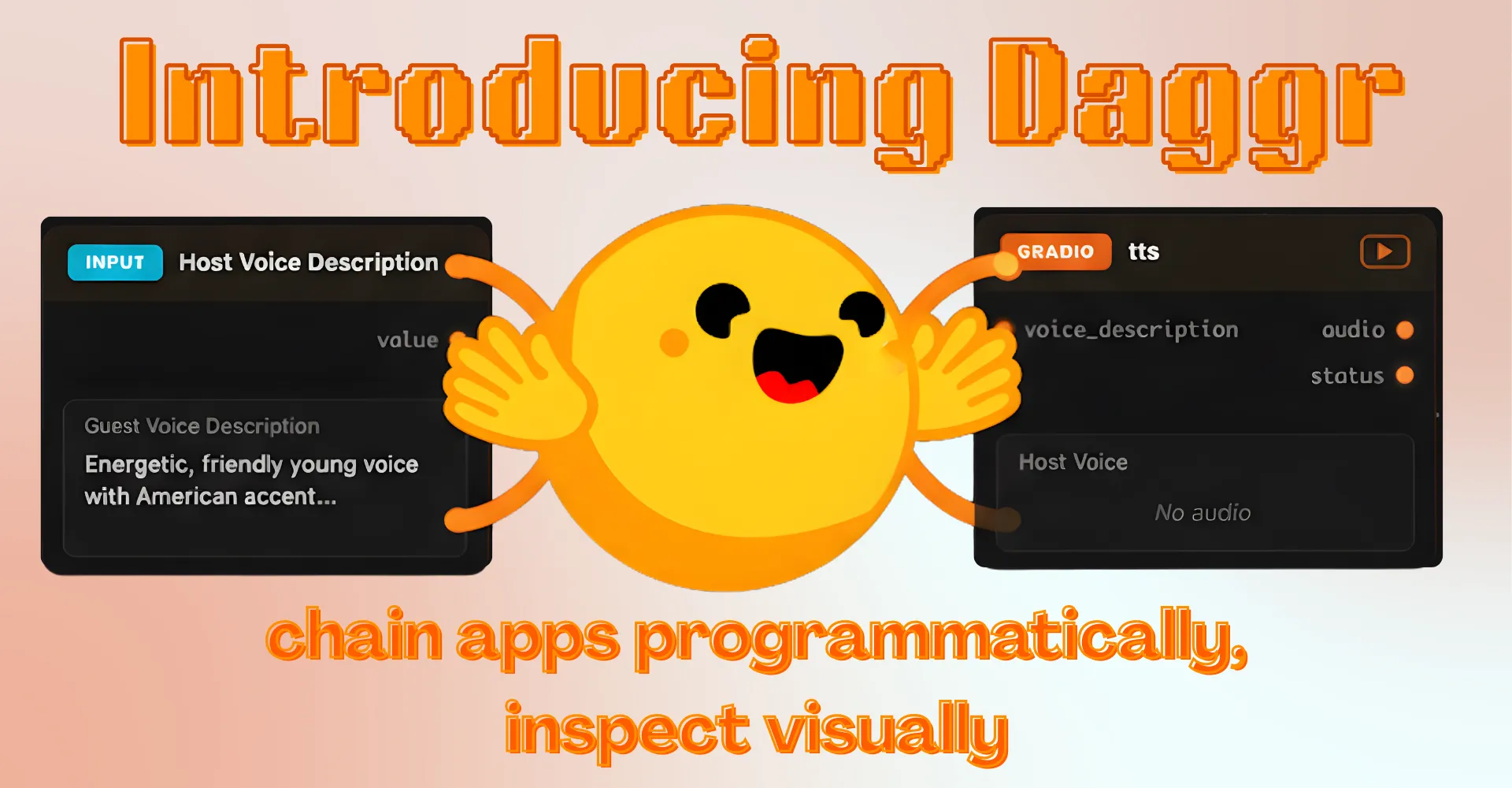

Prezentând Daggr: Înlănțuirea programabilă a aplicațiilor cu inspecție vizuală

Daggr revoluționează dezvoltarea aplicațiilor AI prin combinarea abordării code-first cu vizualizarea automată a fluxurilor de lucru, permițând dezvoltatorilor să inspecteze și reexecute pași individuali fără a relua întregul pipeline.

Noul model Holo2 de la H Company stabilește noi standarde în localizarea interfețelor grafice (UI)

H Company lansează Holo2-235B-A22B Preview, un model revoluționar de localizare UI care stabilește recorduri SOTA în benchmark-uri precum Screenspot-Pro și OSWorld G, utilizând o abordare agentică pentru a naviga interfețele complexe 4K.

Evaluări Comunitare: De ce nu mai avem încredere în clasamentele „cutie neagră” în detrimentul comunității

În 2026, discrepanța dintre scorurile la benchmark-uri și performanța reală a modelelor AI a atins un nivel critic. Hugging Face răspunde prin lansarea Community Evals, o inițiativă care descentralizează raportarea rezultatelor, permite comunității să contribuie prin PR-uri și standardizează evaluările prin formatul Inspect AI.

Revoluția Dezvoltării Web cu Gradio: Cum să Creezi Orice Aplicație într-un Singur Fișier Python

Descoperă cum componenta gr.HTML din Gradio revoluționează dezvoltarea web, permițând crearea de aplicații complexe, de la timere de productivitate până la vizualizatoare 3D ML, într-un singur fișier Python, fără pași de compilare.

Antrenarea modelelor AI cu Unsloth și Hugging Face Jobs: Ghid Complet Gratuit

Un ghid complet despre cum să antrenați modele AI gratuit folosind Unsloth și Hugging Face Jobs. Aflați cum să utilizați modele mici precum LFM2.5-1.2B-Instruct, să instalați skill-uri pentru agenți de codare și să rulați job-uri de antrenare pe GPU-uri cloud gestionate automat.

Mixture of Experts (MoE) în Transformers: O Revoluție în Arhitectura Modelelor de Limbaj

Modelele Mixture of Experts (MoE) revoluționează AI-ul prin decuplarea capacității de învățare de costul computațional. Acest articol explorează integrarea lor în Transformers, de la refactorizarea încărcării greutăților și materializarea leneșă a tensorilor, până la backend-uri optimizate și paralelismul experților.