Subiect: #Machine Learning

Ettin Suite: O nouă eră în arhitectura AI – Encodere și Decodere de ultimă generație

Ettin Suite introduce primele modele pereche (encodere și decodere) antrenate identic, oferind o comparație riguroasă și performanțe de ultimă oră. Proiectul depășește standardele actuale precum ModernBERT și Llama 3.2, demonstrând superioritatea specifică a fiecărei arhitecturi în funcție de task-ul dorit.

Accelerarea implementării modelelor lingvistice mari (LLM) de pe Hugging Face prin NVIDIA NIM: O revoluție în infrastructura AI enterprise

NVIDIA anunță integrarea microserviciilor NIM cu platforma Hugging Face, deblocând accesul rapid la peste 100.000 de modele LLM. Soluția oferă un singur container Docker capabil să optimizeze automat implementarea, detectând arhitectura și selectând backend-ul ideal pentru performanță maximă.

Prezentarea noii interfețe `hf`: un CLI Hugging Face mai rapid și mai prietenos ✨

Hugging Face lansează un nou CLI, `hf`, înlocuind vechiul `huggingface-cli` cu o structură mai clară și intuitivă. Noul instrument aduce o organizare logică a comenzilor, suport pentru migrare și introduce serviciul Hugging Face Jobs pentru rularea de scripturi pe infrastructură dedicată, cu facturare pay-as-you-go.

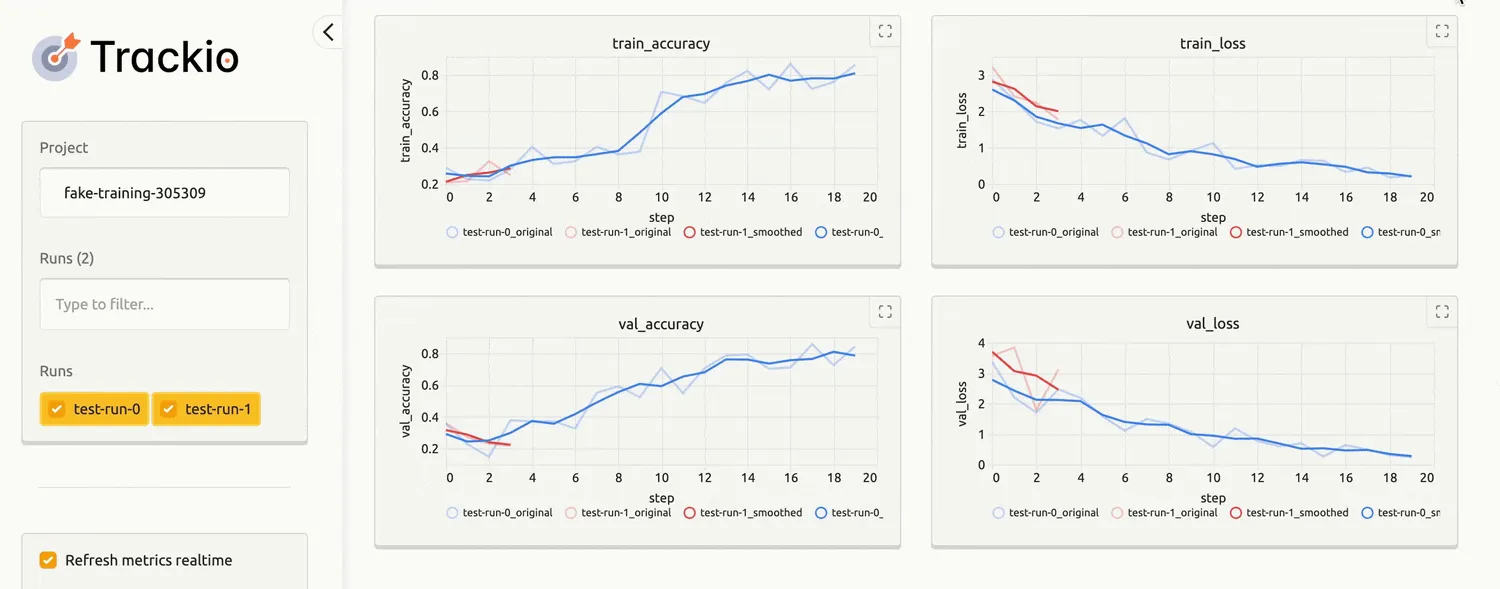

Prezentare Trackio: O bibliotecă ușoară pentru urmărirea experimentelor de la Hugging Face

Hugging Face lansează Trackio, o bibliotecă Python open-source și ușoară pentru urmărirea experimentelor de machine learning, oferind o alternativă gratuită și flexibilă, cu integrare nativă în ecosistemul Hugging Face și focus pe transparență și simplitate.

Implementarea serverelor MCP în Python: Un asistent AI pentru cumpărături cu Gradio

Acest articol detaliază procesul de creare a unui asistent AI pentru cumpărături folosind Python, Gradio și protocolul MCP. Explorăm integrarea modelului IDM-VTON pentru încercări virtuale de haine și configurarea mediului VS Code pentru o interacțiune seamless cu agentul AI.

NVIDIA AI-Q și modelele Llama Nemotron: O nouă eră pentru agenții de cercetare open-source

NVIDIA AI-Q Blueprint, un agent de cercetare profund open-source, a atins performanțe de top pe DeepResearch Bench, demonstrând că modelele deschise pot depăși alternativele proprietare. Arhitectura combină modelele Llama 3.3 și Nemotron pentru a oferi raționament complex, transparență totală și implementare flexibilă.

Bun venit GPT OSS, noua familie de modele open-source de la OpenAI!

OpenAI lansează familia de modele GPT OSS sub licență Apache 2.0, marcând un angajament major față de comunitatea open-source. Cu arhitecturi MoE eficiente de 21B și 117B parametri, optimizări precum cuantizarea mxfp4 și Flash Attention 3, modelele pot rula local pe GPU-uri consumer, democratizând accesul la AI de ultimă generație.

Alinierea Modelelor Viziune-Limbaj în TRL: O Nouă Eră a Optimizării Preferințelor

Modelele Viziune-Limbaj evoluează rapid, dar alinierea lor la preferințele umane rămâne o provocare critică. Acest articol explorează noile tehnici din TRL, precum MPO și GRPO, care depășesc limitările DPO tradițional, oferind o robustete superioară și o capacitate de raționament îmbunătățită pentru modelele multimodale.

Accelerate ND-Parallel: Ghid complet pentru antrenarea eficientă pe mai multe GPU-uri

Pe măsură ce modelele de inteligență artificială cresc la dimensiuni de zeci sau sute de miliarde de parametri, provocarea principală devine gestionarea memoriei și comunicarea între dispozitive. Acest ghid explorează strategiile de paralelism — de la Data Parallelism la tehnici avansate precum Tensor Parallelism și Fully Sharded Data Parallelism — oferind o perspectivă detaliată asupra modului în care acestea pot fi combinate pentru a optimiza antrenarea modelelor la scară largă.

NVIDIA lansează un set de date masiv de raționament multilingv: 6 milioane de intrări pentru a democratiza inteligența artificială deschisă

NVIDIA lansează un set de date masiv de raționament multilingv, extinzând suportul pentru AI-ul deschis. Noul model Nemotron Nano 2 9B introduce o arhitectură hibridă și un „buget de gândire” configurabil, promițând costuri de raționament cu 60% mai mici.

Optimizarea spațiilor ZeroGPU prin compilarea ahead-of-time: Ghid complet pentru performanță maximă

Compilarea ahead-of-time (AoT) revoluționează performanța modelelor ML în spațiile ZeroGPU de la Hugging Face, eliminând timpii de pornire la rece și oferind accelerări de 1.3×-1.8×. Acest ghid detaliază implementarea tehnică, de la capturarea intrărilor până la integrarea în pipeline, explorând și tehnici avansate precum cuantizarea FP8 și FlashAttention-3.

EmbeddingGemma: Noul model de embedding eficient de la Google revoluționează căutarea semantică pe dispozitive mobile

Google lansează EmbeddingGemma, un model de embedding multilingv de 308M parametri, optimizat pentru dispozitive mobile și performanță de top în căutarea semantică și RAG.