Subiect: #Machine Learning

Arm la Conferința PyTorch 2025: O nouă eră în dezvoltarea aplicațiilor AI

Arm participă la Conferința PyTorch 2025 (22-23 octombrie), invitând dezvoltatorii să exploreze noile tehnologii AI, să participe la ateliere de dezvoltare responsabilă și să contribuie la formarea viitoarelor instrumente software prin sesiuni dedicate de feedback și networking.

Nemotron-Personas-India: Date sintetice pentru dezvoltarea unei Inteligențe Artificiale Suverane

NVIDIA lansează Nemotron-Personas-India, primul set de date sintetice open-source pentru profiluri demografice indiene, facilitând dezvoltarea unor sisteme AI suverane, culturale și multilingve, protejând în același timp confidențialitatea datelor.

Ghid complet: Rularea modelelor VLM locale pe procesoare Intel în 3 pași simpli

Acest ghid detaliat explică cum să rulați modele VLM local pe procesoare Intel folosind Optimum Intel și OpenVINO. Aflați despre conversia modelului, tehnicile de cuantizare pentru eficiență și rezultatele benchmark-urilor care demonstrează creșteri semnificative de performanță.

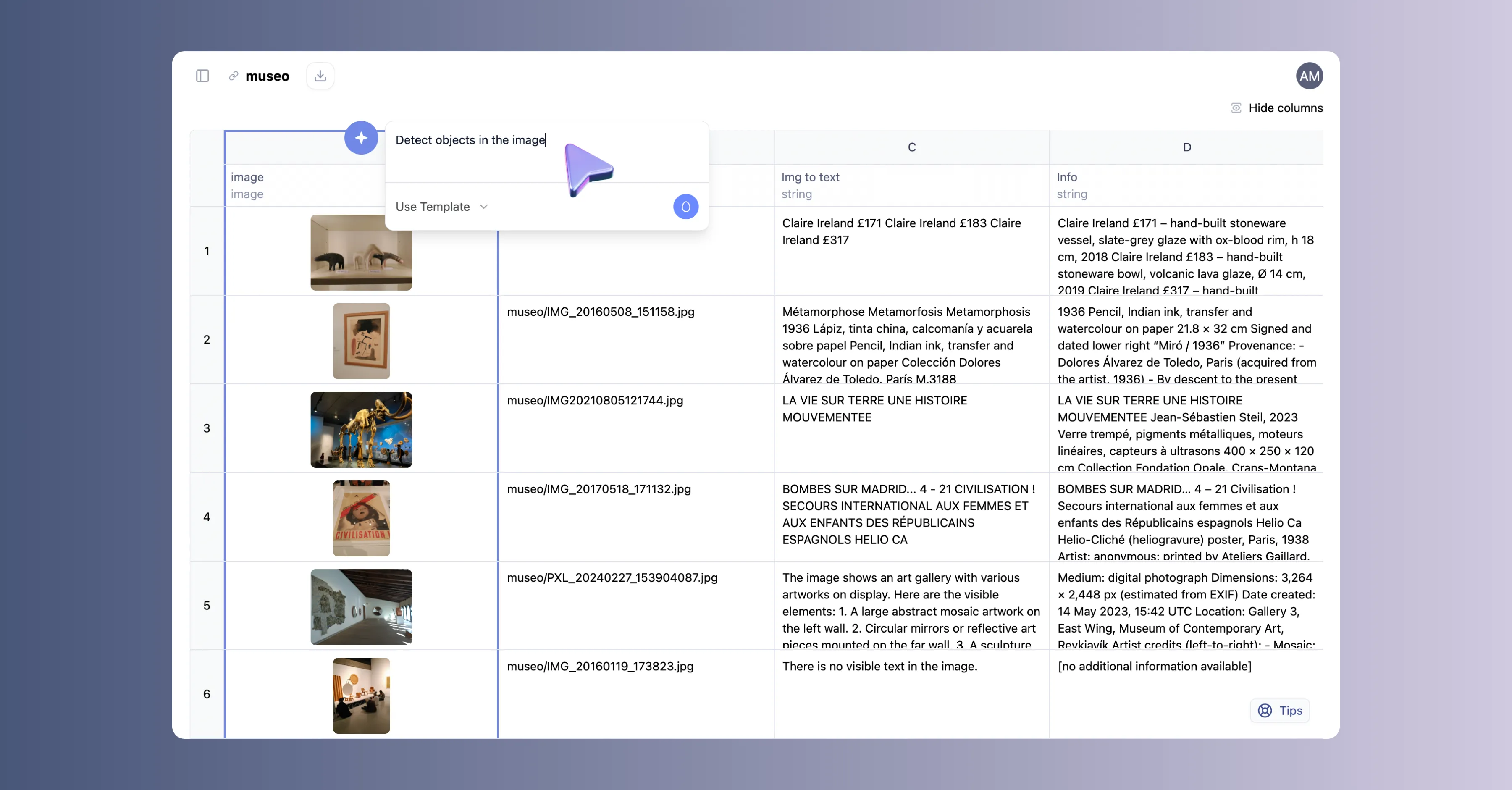

Deblochează puterea imaginilor cu AI Sheets: O nouă eră în procesarea vizuală a datelor

Hugging Face lansează un update major pentru AI Sheets, integrând capabilități de viziune artificială care permit extragerea de text din imagini, generarea și editarea vizuală direct în foi de calcul, democratizând accesul la modele AI complexe pentru utilizatori non-tehnici.

Sentence Transformers se alătură oficial familiei Hugging Face: Un nou capitol pentru procesarea semantică a limbajului

Biblioteca Sentence Transformers (SBERT), un instrument esențial pentru generarea de embedding-uri semantice, se alătură oficial Hugging Face. Fondat în 2019 la UKP Lab Darmstadt, proiectul a evoluat de la o soluție academică la un standard industrial cu peste 16.000 de modele și un milion de utilizatori, păstrându-și totodată angajamentul față de principiile open-source.

Construirea Ecosistemului Open Agent Împreună: Prezentarea OpenEnv

Meta-PyTorch și Hugging Face lansează OpenEnv, un standard deschis pentru medii agențiale care redefinesc antrenamentul și implementarea AI. Acest ecosistem oferă siguranță, scalabilitate și un cadru standardizat pentru dezvoltarea agenților autonomi.

Streaming de date: O metodă de 100 de ori mai eficientă pentru antrenarea modelelor AI

Hugging Face revoluționează antrenarea modelelor AI prin optimizarea streaming-ului de date, făcând procesul de 100 de ori mai eficient. Noua actualizare permite antrenarea pe seturi de date de terabyți fără descărcare, depășind viteza SSD-urilor locale și eliminând erorile de stocare.

Aliniere la Ce? Reevaluarea Generalizării Agenților în MiniMax M2

Articolul explorează provocările fundamentale în dezvoltarea agenților AI, punând în contrast performanța la benchmark-uri cu utilitatea reală. Se discută conceptul de „Gândire Intercalată” și importanța menținerii contextului complet pentru performanța optimă a modelului MiniMax M2.

Apriel-H1: Cheia surprinzătoare pentru distilarea modelelor eficiente de raționament

Descoperă cum Apriel-H1 redefinește eficiența modelelor de raționament prin distilare hibridă, înlocuind straturile de atenție cu Mamba și obținând o creștere a vitezei de 2.1x fără a compromite calitatea gândirii logice.

Prezentare AnyLanguageModel: Un API Unificat pentru Modele LLM Locale și Remote pe Platformele Apple

AnyLanguageModel este un pachet Swift inovator care unifică API-urile pentru modelele de limbaj locale și remote pe platformele Apple, simplificând integrarea AI și reducând complexitatea tehnică pentru dezvoltatori.

Open ASR Leaderboard: Tendințe și perspective cu noile piste multilingve și pentru transcrieri de lungă durată

Analiza Open ASR Leaderboard dezvăluie tendințe majore în recunoașterea automată a vorbirii: modelele hibride Conformer-LLM domină acuratețea, decodoarele CTC/TDT conduc în viteză, iar transcrierea de lungă durată rămâne o frontieră cheie pentru inovația open-source.

RapidFire AI: Optimizarea TRL de 20 de ori mai rapidă pentru antrenarea modelelor lingvistice

RapidFire AI revoluționează ajustarea fină a modelelor de limbaj (LLM) prin TRL, oferind o accelerare de până la 20x. Soluția permite rularea concurentă a multiplelor configurații chiar și pe un singur GPU, cu control interactiv în timp real pentru a maximiza eficiența și a reduce timpul de experimentare.