Subiect: #Open Source

Prezentare swift-huggingface: Clientul Swift complet pentru ecosistemul Hugging Face

swift-huggingface este o bibliotecă Swift completă pentru Hugging Face, care rezolvă problemele de fiabilitate la descărcarea modelelor, introduce autentificare flexibilă (inclusiv OAuth) și permite partajarea cache-ului cu ecosistemul Python, optimizând fluxul de lucru pentru dezvoltatorii de AI pe platformele Apple.

Noutăți în llama.cpp: Gestionarea Avansată a Modelelor și Arhitectura Multi-Proces

Echipa llama.cpp introduce un sistem revoluționar de gestionare a modelelor, similar cu Ollama, bazat pe o arhitectură multi-proces. Aceasta asigură stabilitate superioară prin izolarea proceselor și include funcții avansate precum auto-descoperirea modelelor, încărcare la cerere și evacuare inteligentă LRU pentru optimizarea memoriei video.

CUGA pe Hugging Face: Democratizarea Agenților AI Configurabili pentru Era Enterprise

CUGA (Configurable Generalist Agent) revoluționează peisajul AI enterprise prin democratizarea accesului la agenți AI complecși. Aflați despre arhitectura sa inovatoare, performanțele de top pe WebArena și integrarea cu platforme open-source precum Hugging Face și Langflow.

NVIDIA aduce agenții AI la viață cu DGX Spark și Reachy Mini: Ghid complet pentru crearea propriului asistent robotic

La CES 2026, NVIDIA a prezentat o demonstrație impresionantă a viitorului agenților AI, combinând puterea de procesare a DGX Spark cu robotul Reachy Mini. Acest articol detaliază ghidul tehnic pas cu pas pentru a crea propriul asistent robotic, folosind modele deschise Nemotron, toolkit-ul NeMo Agent și framework-ul Pipecat pentru interacțiune vocală și vizuală în timp real.

Open Responses: Revoluția Inferenței AI dincolo de Era Chatbot-urilor

Open Responses redefinește standardul inferenței AI, trecând de la modelul conversațional la sisteme autonome capabile de raționament complex și execuție de sarcini multi-eta, oferind transparență și interoperabilitate într-un format open-source.

Alegeri Arhitecturale în Ecosistemul AI Open-Source din China: Construcția Dincolo de DeepSeek

Analiza detaliată a schimbărilor arhitecturale din ecosistemul AI open-source din China post-DeepSeek, evidențiind adoptarea arhitecturii Mixture of Experts (MoE), diversificarea modalităților, preferința pentru modelele mici și trecerea strategică la hardware domestic.

Evaluări Comunitare: De ce nu mai avem încredere în clasamentele „cutie neagră” în detrimentul comunității

În 2026, discrepanța dintre scorurile la benchmark-uri și performanța reală a modelelor AI a atins un nivel critic. Hugging Face răspunde prin lansarea Community Evals, o inițiativă care descentralizează raportarea rezultatelor, permite comunității să contribuie prin PR-uri și standardizează evaluările prin formatul Inspect AI.

GGML și llama.cpp se alătură Hugging Face pentru a garanta progresul pe termen lung al Inteligenței Artificiale Locale

Georgi Gerganov și echipa GGML se alătură Hugging Face pentru a scala proiectul llama.cpp, asigurând resursele necesare pentru viitorul AI-ului local. Parteneriatul promite autonomie deplină pentru proiectul open-source, integrare tehnică fluidă cu biblioteca transformers și o viziune comună pentru democratizarea superinteligenței pe dispozitivele utilizatorilor.

PRX Part 3 — Antrenarea unui model Text-to-Image în doar 24 de ore! O revoluție în ingineria modelelor de difuzie

O echipă de cercetare demonstrează că este posibil să antrenezi un model competitiv text-to-image în doar 24 de ore, combinând tehnici precum antrenarea în spațiul pixelilor, rutarea TREAD și optimizerul Muon, eliminând nevoia unui VAE și reducând drastic costurile de computație.

Prezentarea Modular Diffusers: Blocuri de Construire Compozabile pentru Pipeline-uri de Difuzie

Modular Diffusers introduce o nouă eră în inteligența artificială generativă, transformând pipeline-urile de difuzie rigide în colecții flexibile de blocuri componabile. Acest articol explorează de la conceptele fundamentale și rularea primelor exemple, până la crearea de blocuri personalizate și integrarea vizuală cu Mellon.

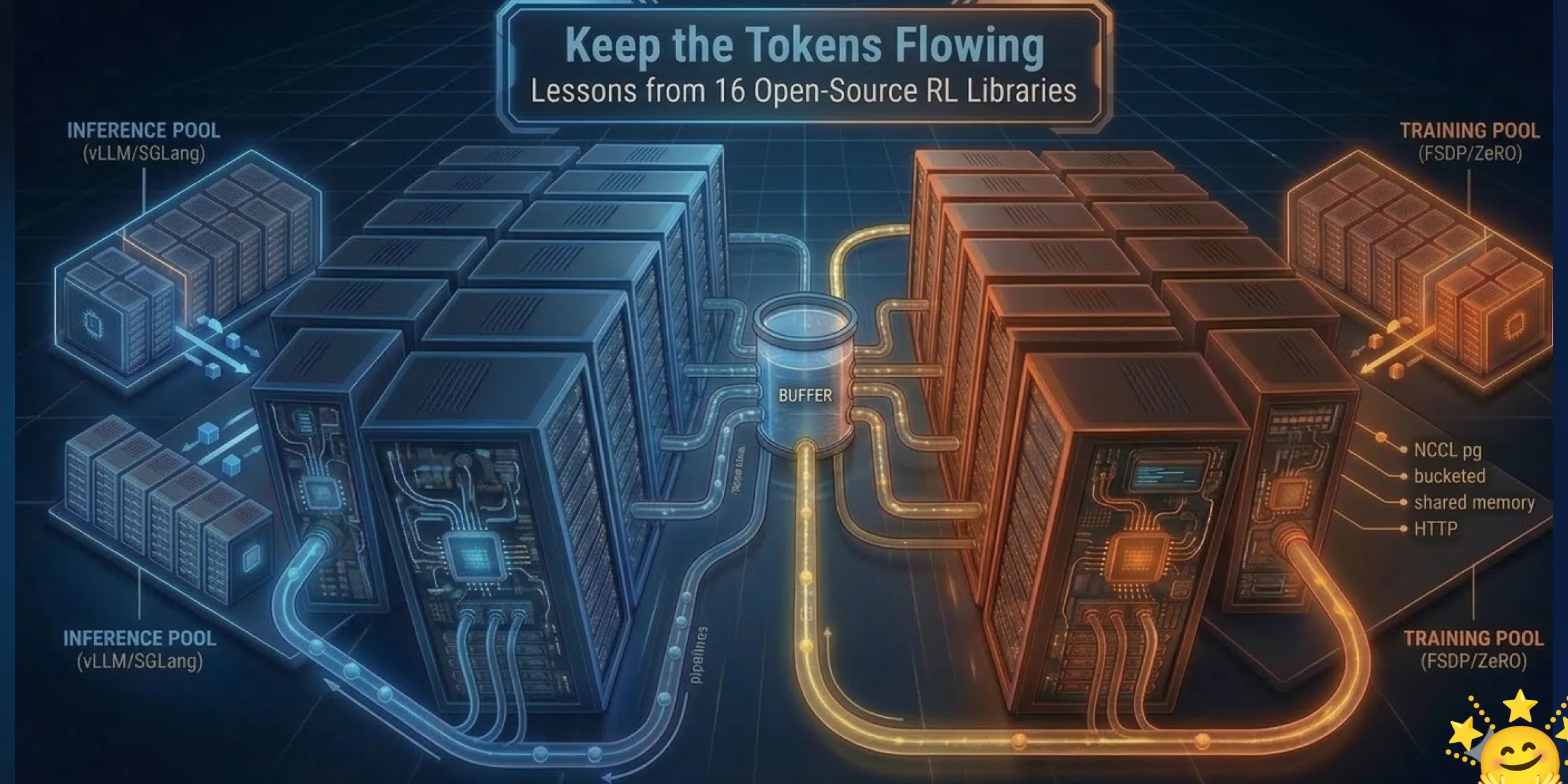

Menținând Fluxul de Token-uri: Lecții din 16 Biblioteci Open-Source de Învățare prin Întărire

O analiză tehnică detaliată a arhitecturilor de învățare prin întărire asincronă, extrăgând principii de design esențiale din 16 biblioteci open-source pentru a optimiza antrenarea modelelor de limbaj de mari dimensiuni.

Mellea 0.4.0 și Bibliotecile Granite: O Nouă Eră în Fluxurile de Lucru AI Structurate și Verificabile

IBM lansează Mellea 0.4.0 și bibliotecile Granite, o suită software revoluționară care transformă dezvoltarea AI enterprise. Prin înlocuirea prompting-ului probabilistic cu fluxuri de lucru structurate și utilizarea adaptoarelor specializate pentru sarcini precum RAG și detectarea halucinațiilor, noile instrumente promit sisteme AI mai sigure, verificabile și mentenabile.