Revoluția Dezvoltării Web cu Gradio: Cum să Creezi Orice Aplicație într-un Singur Fișier Python

Descoperă cum componenta gr.HTML din Gradio revoluționează dezvoltarea web, permițând crearea de aplicații complexe, de la timere de productivitate până la vizualizatoare 3D ML, într-un singur fișier Python, fără pași de compilare.

IBM și UC Berkeley diagnostichează motivele eșecului agenților enterprise folosind IT-Bench și MAST

Un studiu realizat de IBM și UC Berkeley utilizează taxonomia MAST pentru a diseca eșecurile agenților AI în medii enterprise, dezvăluind diferențele critice dintre modelele de frontieră și cele open-source și oferind o metodologie clară pentru diagnosticarea și remedierea erorilor sistematice.

Antrenarea modelelor AI cu Unsloth și Hugging Face Jobs: Ghid Complet Gratuit

Un ghid complet despre cum să antrenați modele AI gratuit folosind Unsloth și Hugging Face Jobs. Aflați cum să utilizați modele mici precum LFM2.5-1.2B-Instruct, să instalați skill-uri pentru agenți de codare și să rulați job-uri de antrenare pe GPU-uri cloud gestionate automat.

GGML și llama.cpp se alătură Hugging Face pentru a garanta progresul pe termen lung al Inteligenței Artificiale Locale

Georgi Gerganov și echipa GGML se alătură Hugging Face pentru a scala proiectul llama.cpp, asigurând resursele necesare pentru viitorul AI-ului local. Parteneriatul promite autonomie deplină pentru proiectul open-source, integrare tehnică fluidă cu biblioteca transformers și o viziune comună pentru democratizarea superinteligenței pe dispozitivele utilizatorilor.

Mixture of Experts (MoE) în Transformers: O Revoluție în Arhitectura Modelelor de Limbaj

Modelele Mixture of Experts (MoE) revoluționează AI-ul prin decuplarea capacității de învățare de costul computațional. Acest articol explorează integrarea lor în Transformers, de la refactorizarea încărcării greutăților și materializarea leneșă a tensorilor, până la backend-uri optimizate și paralelismul experților.

PRX Part 3 — Antrenarea unui model Text-to-Image în doar 24 de ore! O revoluție în ingineria modelelor de difuzie

O echipă de cercetare demonstrează că este posibil să antrenezi un model competitiv text-to-image în doar 24 de ore, combinând tehnici precum antrenarea în spațiul pixelilor, rutarea TREAD și optimizerul Muon, eliminând nevoia unui VAE și reducând drastic costurile de computație.

Prezentarea Modular Diffusers: Blocuri de Construire Compozabile pentru Pipeline-uri de Difuzie

Modular Diffusers introduce o nouă eră în inteligența artificială generativă, transformând pipeline-urile de difuzie rigide în colecții flexibile de blocuri componabile. Acest articol explorează de la conceptele fundamentale și rularea primelor exemple, până la crearea de blocuri personalizate și integrarea vizuală cu Mellon.

Implementarea Inteligenței Artificiale în Robotică pe Platforme Embedded: Înregistrarea Seturilor de Date, Fine-Tuning VLA și Optimizări On-Device

Aducerea modelelor VLA (Vision-Language-Action) pe platforme robotice embedded necesită mai mult decât compresie de model; este o problemă de inginerie a sistemelor. Acest articol detaliază bunele practici NXP pentru înregistrarea seturilor de date, fine-tuning-ul politicilor și optimizările în timp real pe procesorul i.MX 95, demonstrând cum inferența asincronă și cuantizarea selectivă pot reduce latența de la 2.86s la 0.32s.

LeRobot v0.5.0: O nouă eră în robotică și inteligența artificială încorporată

LeRobot v0.5.0 revoluționează robotica open-source prin integrarea robotului umanoid Unitree G1, introducerea modelelor autoregressive Pi0-FAST și optimizarea masivă a fluxului de date, eliminând timpii morți în înregistrare și accelerând antrenarea modelelor vizuale.

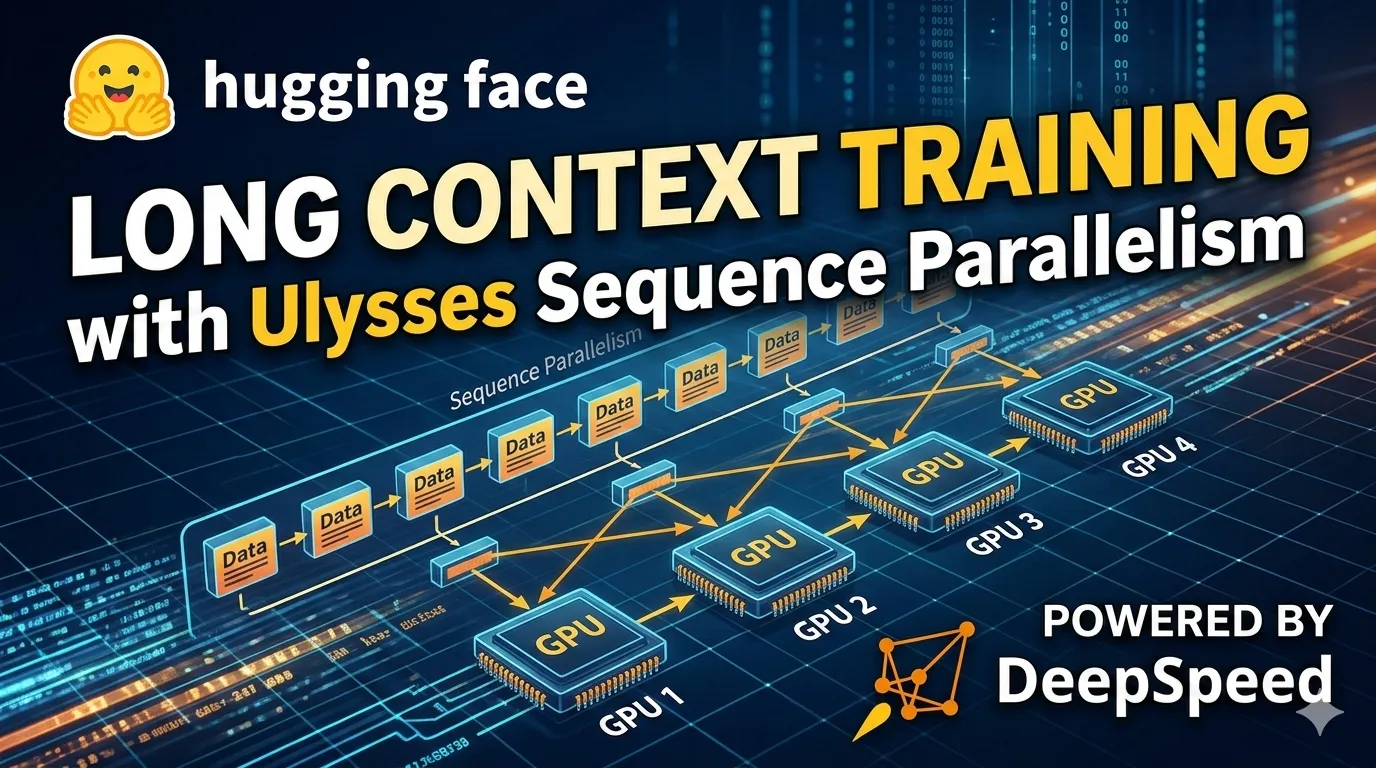

Paralelismul de Secvență Ulysses: Antrenarea modelelor AI cu contexte de un milion de token-uri

Ulysses Sequence Parallelism oferă o soluție revoluționară pentru antrenarea modelelor AI cu contexte de milioane de token-uri, distribuind calculul atenției pe multiple GPU-uri prin paralelismul capetelor de atenție, integrată acum complet în ecosistemul Hugging Face.

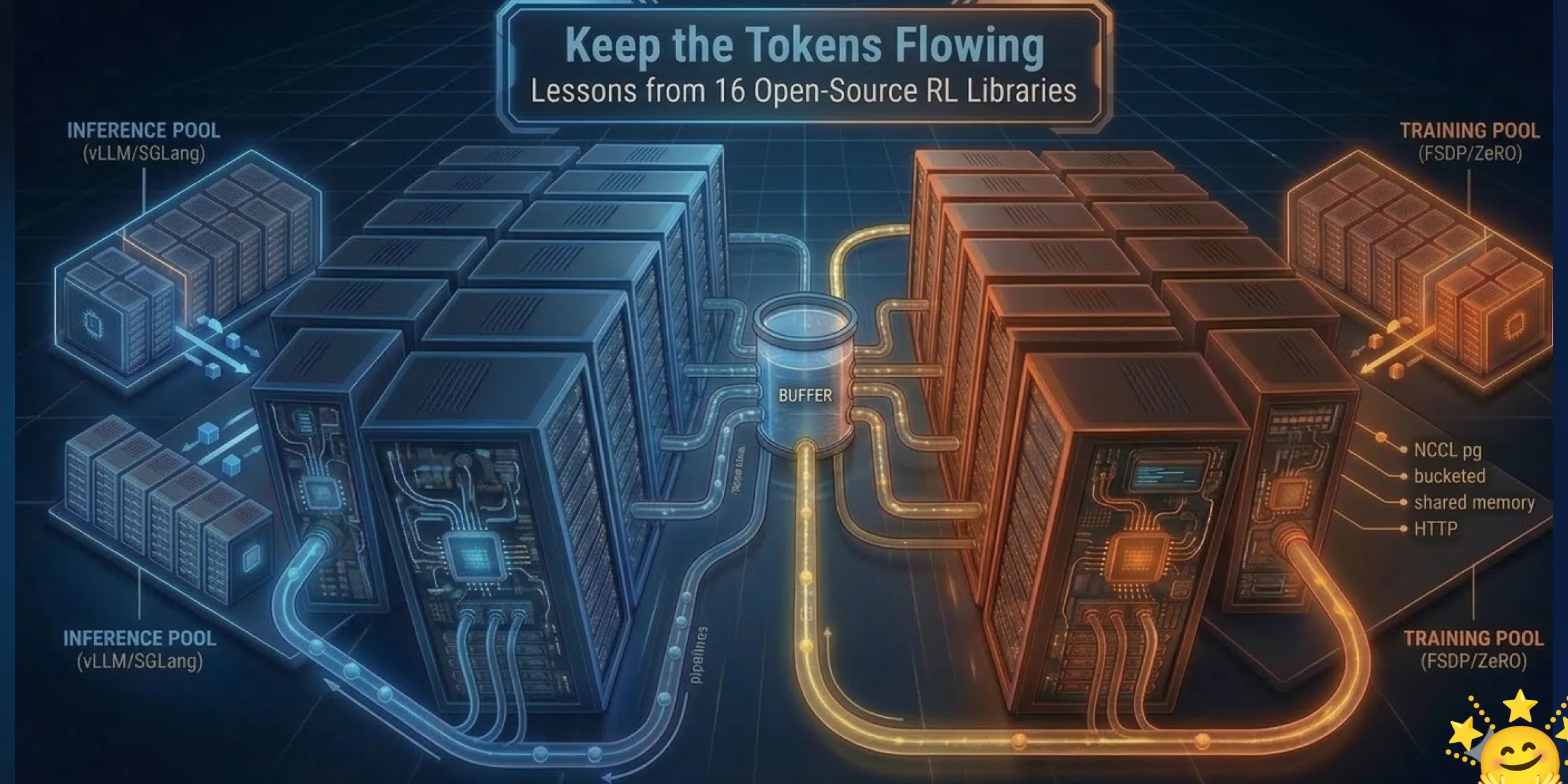

Menținând Fluxul de Token-uri: Lecții din 16 Biblioteci Open-Source de Învățare prin Întărire

O analiză tehnică detaliată a arhitecturilor de învățare prin întărire asincronă, extrăgând principii de design esențiale din 16 biblioteci open-source pentru a optimiza antrenarea modelelor de limbaj de mari dimensiuni.

Rucsac Imprimat Impermeabil Unisex Cu 2 Compartimente Detaliu Buzunar Frontal — 46,10 lei

Produs Premium eShoops.eu

Cumpără acum

Holotron-12B: O nouă eră în agenții AI pentru utilizarea computerelor – performanță, eficiență și scalabilitate

H Company lansează Holotron-12B, un model AI multimodal revoluționar, optimizat pentru agenți care utilizează computerele. Cu o arhitectură hibridă SSM ce dublează debitul de inferență față de predecesorii săi, modelul excelează în sarcini complexe de navigare și interacțiune vizuală, deschizând calea pentru automatizarea autonomă la scară largă.

Mellea 0.4.0 și Bibliotecile Granite: O Nouă Eră în Fluxurile de Lucru AI Structurate și Verificabile

IBM lansează Mellea 0.4.0 și bibliotecile Granite, o suită software revoluționară care transformă dezvoltarea AI enterprise. Prin înlocuirea prompting-ului probabilistic cu fluxuri de lucru structurate și utilizarea adaptoarelor specializate pentru sarcini precum RAG și detectarea halucinațiilor, noile instrumente promit sisteme AI mai sigure, verificabile și mentenabile.