Subiect: #Deep Learning

Construirea și Partajarea Simplă a Kernel-elor ROCm prin Ecosistemul Hugging Face

Acest ghid detaliat explorează modul în care dezvoltatorii pot construi și partaja kernel-uri ROCm de înaltă performanță folosind ecosistemul Hugging Face. Focalizându-se pe exemplul kernel-ului GEMM RadeonFlow, câștigătorul premiului AMD Developer Challenge 2025, articolul explică structura proiectului, configurarea fișierelor de build și integrarea nativă în PyTorch, simplificând procesul complex de optimizare pe GPU-urile AMD.

Diffusers întâmpină cu brațele deschise noul model FLUX.2: O revoluție în generația imaginelor prin inteligență artificială

Black Forest Labs lansează FLUX.2, un model revoluționar de generare a imaginilor, integrat în ecosistemul Hugging Face Diffusers. Cu o arhitectură nouă, bazată pe un singur encoder de text (Mistral Small 3.1) și un DiT optimizat, FLUX.2 oferă capacități avansate de editare și generare ghidată de imagini multiple, fiind accesibil și pe hardware-uri cu resurse limitate datorită tehnicilor de cuantizare și offloading.

PRX Part 3 — Antrenarea unui model Text-to-Image în doar 24 de ore! O revoluție în ingineria modelelor de difuzie

O echipă de cercetare demonstrează că este posibil să antrenezi un model competitiv text-to-image în doar 24 de ore, combinând tehnici precum antrenarea în spațiul pixelilor, rutarea TREAD și optimizerul Muon, eliminând nevoia unui VAE și reducând drastic costurile de computație.

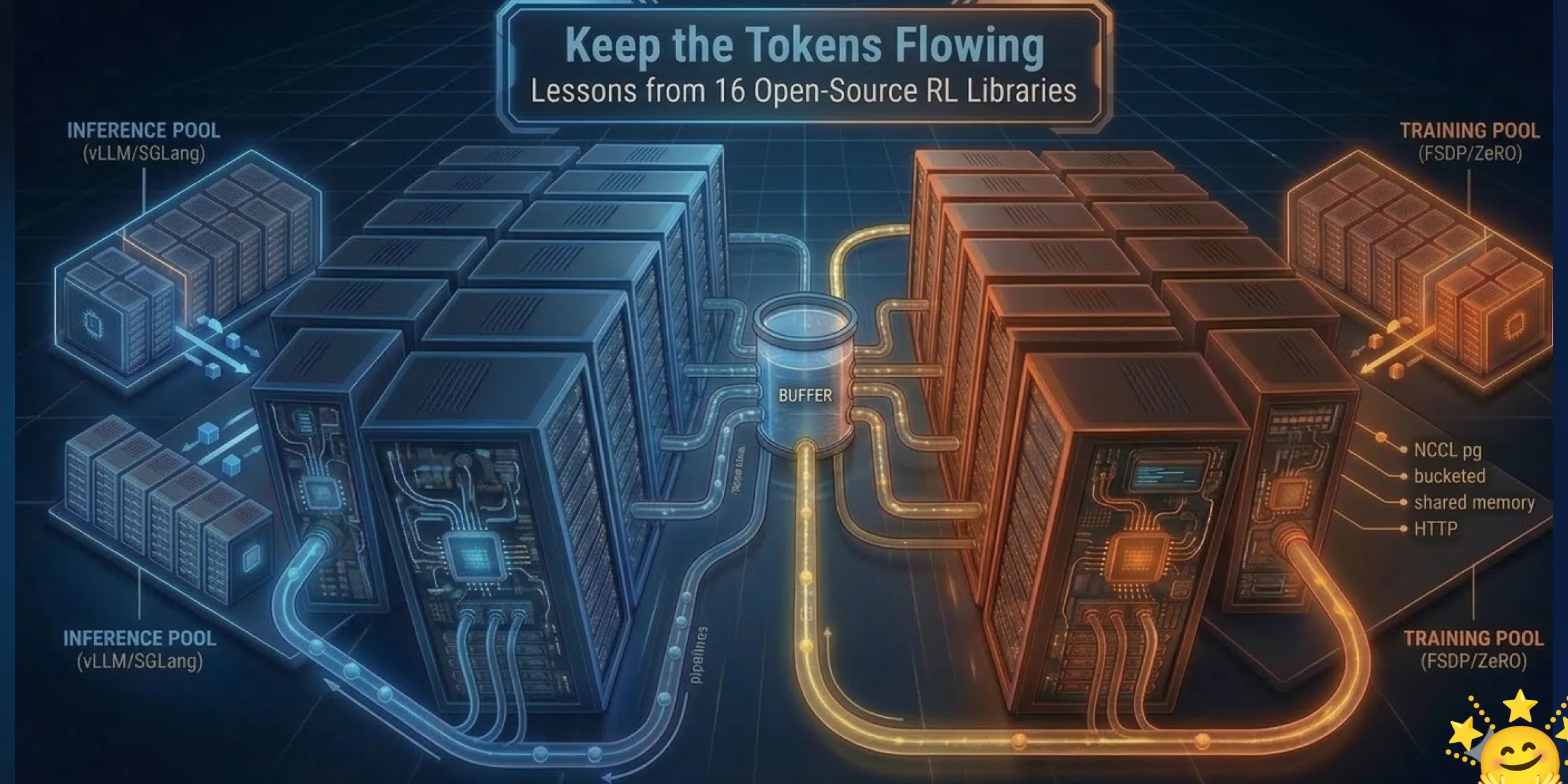

Menținând Fluxul de Token-uri: Lecții din 16 Biblioteci Open-Source de Învățare prin Întărire

O analiză tehnică detaliată a arhitecturilor de învățare prin întărire asincronă, extrăgând principii de design esențiale din 16 biblioteci open-source pentru a optimiza antrenarea modelelor de limbaj de mari dimensiuni.

Holotron-12B: O nouă eră în agenții AI pentru utilizarea computerelor – performanță, eficiență și scalabilitate

H Company lansează Holotron-12B, un model AI multimodal revoluționar, optimizat pentru agenți care utilizează computerele. Cu o arhitectură hibridă SSM ce dublează debitul de inferență față de predecesorii săi, modelul excelează în sarcini complexe de navigare și interacțiune vizuală, deschizând calea pentru automatizarea autonomă la scară largă.

Construiește un Model de Embedding Specific pe Domeniu în Mai Puțin de o Zi: Ghid Complet de Optimizare și Implementare

Acest ghid tehnic detaliază procesul de construire a unui model de embedding specific domeniului în mai puțin de 24 de ore, utilizând generare sintetică de date și minerit de negative dure. Soluția, validată de cazul Atlassian care a obținut o îmbunătățire de 26% a Recall-ului, democratizează accesul la modele AI de înaltă performanță, eliminând necesitatea etichetării manuale a datelor.