Subiect: #LLM

🇵🇭 FilBench: Pot modelele de limbaj să înțeleagă și să genereze filipineză?

FilBench este o suită de evaluare lansată în 2025 pentru a testa capacitatea modelelor AI de a înțelege și genera limbaj în filipineză, tagalog și cebuano. Studiul relevă că deși modelele regionale rămân în urma GPT-4, ele oferă o alternativă cost-eficientă și promițătoare pentru comunitățile locale.

TextQuests: Cât de performante sunt modelele lingvistice mari în jocurile video textuale?

TextQuests este un nou benchmark bazat pe 25 de jocuri clasice de ficțiune interactivă, menit să evalueze capacitatea modelelor lingvistice mari de a raționa pe termen lung și de a învăța prin explorare, relevând dificultăți semnificative în raționamentul spațial și gestionarea contextului extins.

Arm și ExecuTorch 0.7: Democratizarea Inteligenței Artificiale Generative pentru masele largi de utilizatori

Arm revoluționează peisajul tehnologic prin integrarea KleidiAI în ExecuTorch 0.7, aducând capabilități de Inteligență Artificială Generativă, inclusiv modele de limbaj de mari dimensiuni, pe miliarde de dispozitive mobile și edge vechi, democratizând accesul la tehnologia AI.

Kimina-Prover-RL: O nouă eră în demonstrarea automată a teoremelor prin învățare prin întărire

Echipa Kimina lansează kimina-prover-rl, un pipeline open-source de învățare prin întărire pentru demonstrarea teoremelor în Lean 4, care utilizează un paradigmă de raționament structurat și un mecanism inovator de corecție a erorilor, obținând performanțe de top pentru modelele de dimensiuni mici.

Jupyter Agents: Antrenarea modelelor de limbaj pentru raționament bazat pe notebook-uri

Jupyter Agent reprezintă o inovație majoră în antrenarea modelelor de limbaj de mici dimensiuni pentru a raționa și executa cod în medii Jupyter. Proiectul detaliază un pipeline complex de curățare a datelor din Kaggle și fine-tuning, demonstrând cum modelele mici pot deveni agenți eficienți în știința datelor.

Together AI și Hugging Face revoluționează antrenarea modelelor: Acum poți adapta orice LLM în doar câteva minute

Parteneriatul dintre Together AI și Hugging Face permite dezvoltatorilor să efectueze fine-tuning pe orice model LLM compatibil direct prin infrastructura cloud, eliminând complexitatea tehnică și reducând timpul de la descoperire la implementare la doar câteva minute.

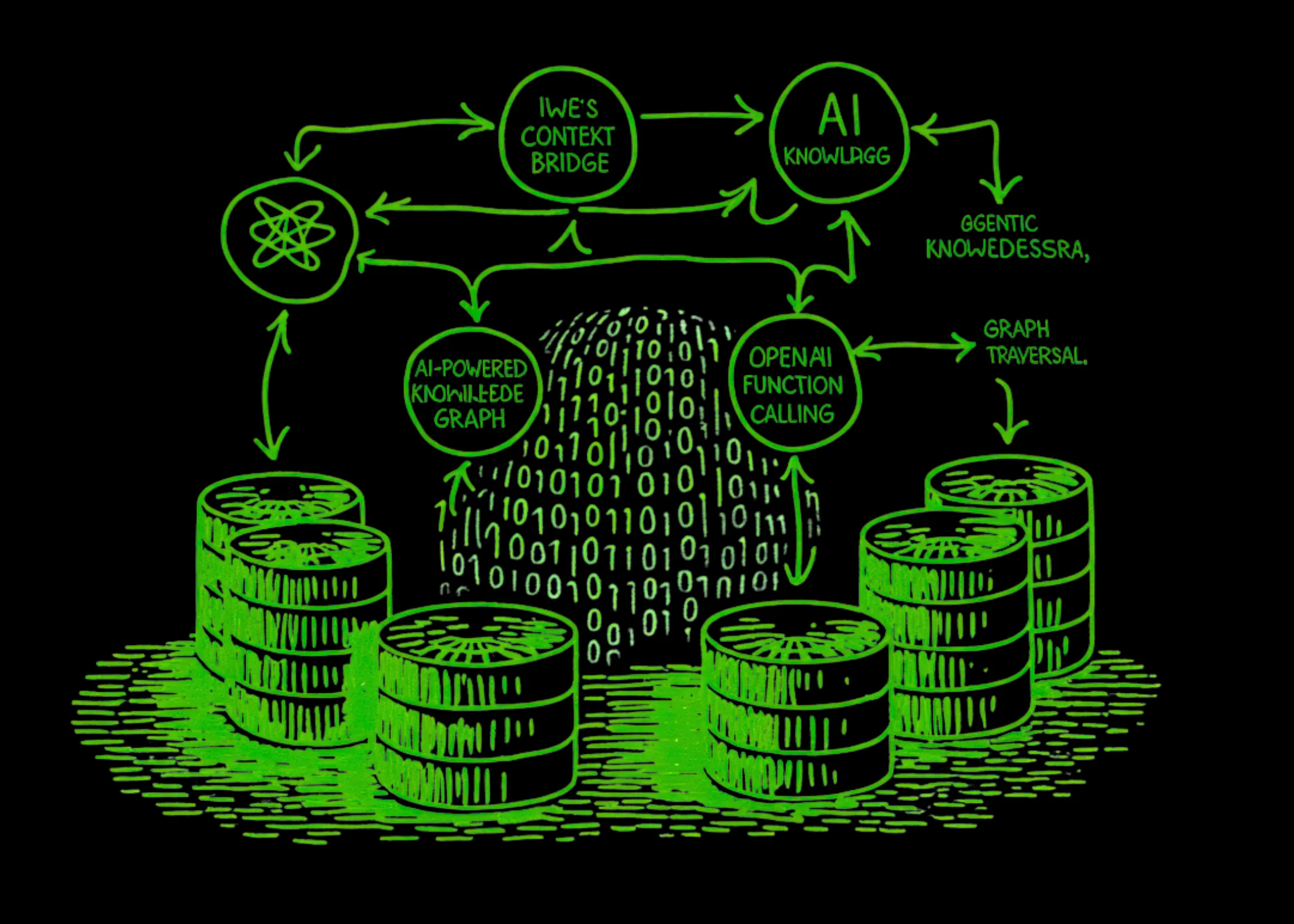

Implementarea Context Bridge de la IWE ca Graf de Cunoaștere bazat pe Inteligență Artificială, utilizând RAG Agențial, Apeluri de Funcții OpenAI și Traversare de Graf

O analiză detaliată a arhitecturii hibride propuse de IWE, care transformă datele nestructurate în Grafuri de Cunoaștere dinamice, utilizând agenți AI și RAG pentru o înțelegere contextuală superioară.

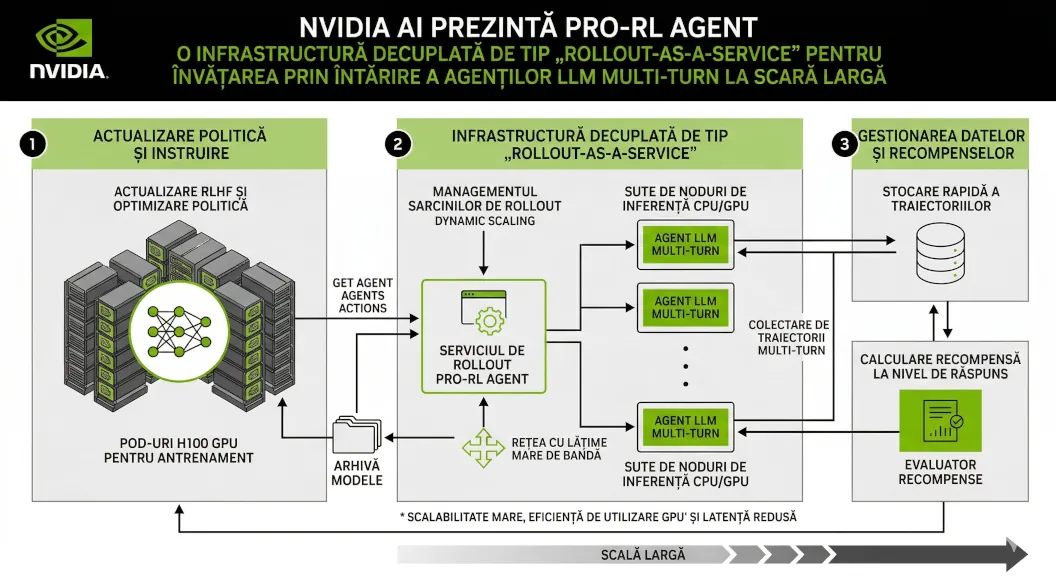

NVIDIA AI prezintă ProRL Agent: O infrastructură decuplată de tip „Rollout-as-a-Service” pentru învățarea prin întărire a agenților LLM multi-turn la scară largă

Cercetătorii de la NVIDIA au lansat ProRL Agent, o infrastructură scalabilă care revoluționează antrenarea agenților LLM prin decuplarea procesului de colectare a experiențelor (rollout) de bucla de antrenament, rezolvând astfel conflictele majore de resurse care îngreunează dezvoltarea AI-ului la scară largă.

Swift Transformers atinge versiunea 1.0 – și privește spre viitorul inteligenței artificiale pe dispozitivele Apple

Biblioteca Swift Transformers a lansat versiunea 1.0, stabilind un nou standard pentru dezvoltarea aplicațiilor AI locale pe Apple Silicon, cu un accent pe integrarea MLX și cazuri de utilizare agentică.

Nemotron-Personas-Japan: Un set de date sintetic pentru dezvoltarea Inteligenței Artificiale Suverane în Japonia

NVIDIA lansează Nemotron-Personas-Japan, primul set de date sintetic open-source dedicat culturii și demografiei japoneze, facilitând dezvoltarea AI-ului suveran și eliminând barierele de confidențialitate pentru dezvoltatorii locali.

Aliniere la Ce? Reevaluarea Generalizării Agenților în MiniMax M2

Articolul explorează provocările fundamentale în dezvoltarea agenților AI, punând în contrast performanța la benchmark-uri cu utilitatea reală. Se discută conceptul de „Gândire Intercalată” și importanța menținerii contextului complet pentru performanța optimă a modelului MiniMax M2.

Prezentare AnyLanguageModel: Un API Unificat pentru Modele LLM Locale și Remote pe Platformele Apple

AnyLanguageModel este un pachet Swift inovator care unifică API-urile pentru modelele de limbaj locale și remote pe platformele Apple, simplificând integrarea AI și reducând complexitatea tehnică pentru dezvoltatori.