Subiect: #LLM

RapidFire AI: Optimizarea TRL de 20 de ori mai rapidă pentru antrenarea modelelor lingvistice

RapidFire AI revoluționează ajustarea fină a modelelor de limbaj (LLM) prin TRL, oferind o accelerare de până la 20x. Soluția permite rularea concurentă a multiplelor configurații chiar și pe un singur GPU, cu control interactiv în timp real pentru a maximiza eficiența și a reduce timpul de experimentare.

Construirea Deep Research: Cum am atins performanța de ultimă generație (State of the Art)

O analiză detaliată a procesului de dezvoltare a sistemului Deep Research, evidențiind importanța ingineriei contextului, gestionarea eficientă a tokenilor și trecerea de la fluxuri de lucru la agenți autonomi pentru a atinge performanța de ultimă generație.

Batching continuu: De la primele principii la optimizarea inferenței AI

Articolul explorează mecanismele fundamentale ale inferenței în modelele de limbaj de mari dimensiuni, de la atenție și KV caching până la batching-ul continuu, explicând cum aceste tehnici optimizează throughput-ul în scenarii de servire în sarcină ridicată.

Noutăți în llama.cpp: Gestionarea Avansată a Modelelor și Arhitectura Multi-Proces

Echipa llama.cpp introduce un sistem revoluționar de gestionare a modelelor, similar cu Ollama, bazat pe o arhitectură multi-proces. Aceasta asigură stabilitate superioară prin izolarea proceselor și include funcții avansate precum auto-descoperirea modelelor, încărcare la cerere și evacuare inteligentă LRU pentru optimizarea memoriei video.

Differential Transformer V2: O nouă eră în eficiența și stabilitatea modelelor de limbaj de mari dimensiuni

Differential Transformer V2 (DIFF V2) revoluționează arhitectura LLM prin optimizarea eficienței inferenței și eliminarea instabilității numerice specifice versiunii anterioare. Prin dublarea capetelor de interogare și o nouă operație diferențială, modelul depășește constrângerile Softmax, oferind o decodare rapidă fără a necesita nuclee personalizate.

IBM și UC Berkeley diagnostichează motivele eșecului agenților enterprise folosind IT-Bench și MAST

Un studiu realizat de IBM și UC Berkeley utilizează taxonomia MAST pentru a diseca eșecurile agenților AI în medii enterprise, dezvăluind diferențele critice dintre modelele de frontieră și cele open-source și oferind o metodologie clară pentru diagnosticarea și remedierea erorilor sistematice.

Mixture of Experts (MoE) în Transformers: O Revoluție în Arhitectura Modelelor de Limbaj

Modelele Mixture of Experts (MoE) revoluționează AI-ul prin decuplarea capacității de învățare de costul computațional. Acest articol explorează integrarea lor în Transformers, de la refactorizarea încărcării greutăților și materializarea leneșă a tensorilor, până la backend-uri optimizate și paralelismul experților.

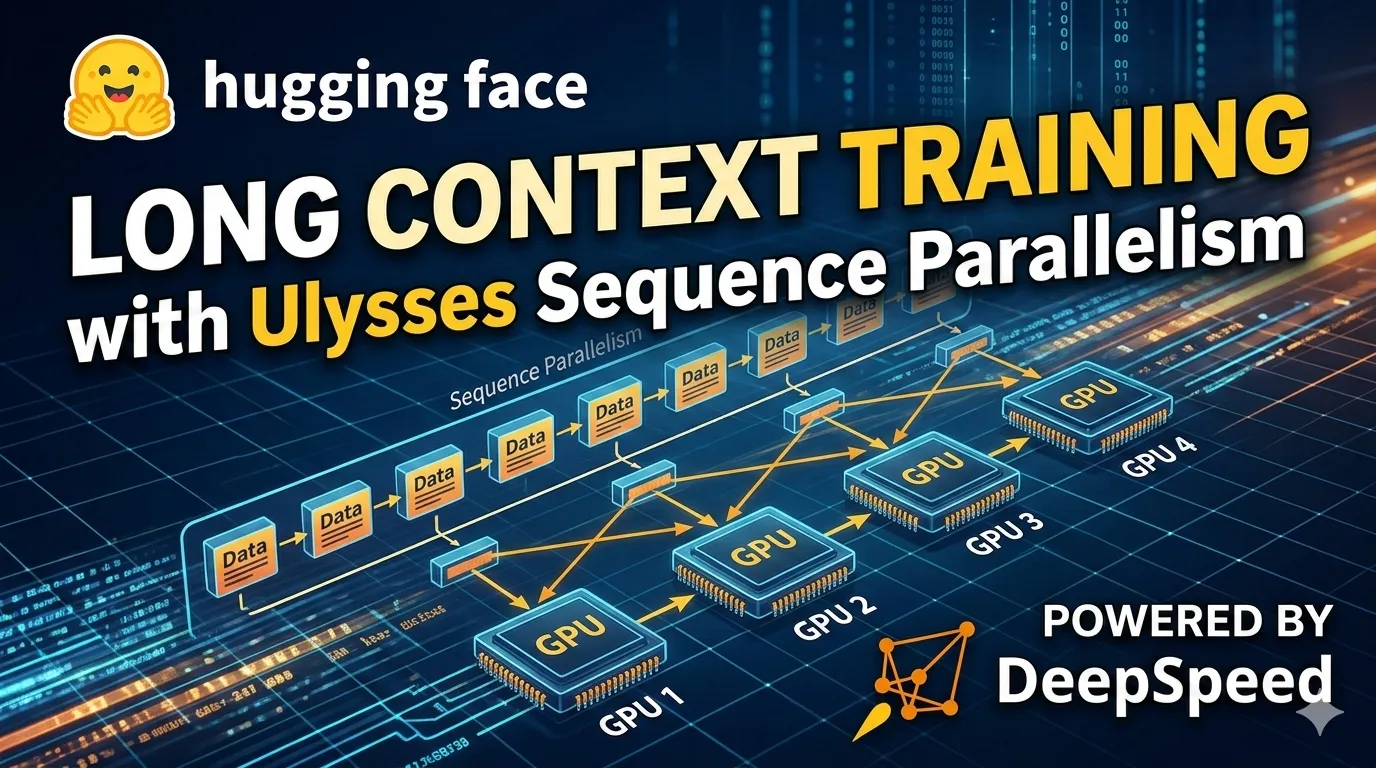

Paralelismul de Secvență Ulysses: Antrenarea modelelor AI cu contexte de un milion de token-uri

Ulysses Sequence Parallelism oferă o soluție revoluționară pentru antrenarea modelelor AI cu contexte de milioane de token-uri, distribuind calculul atenției pe multiple GPU-uri prin paralelismul capetelor de atenție, integrată acum complet în ecosistemul Hugging Face.

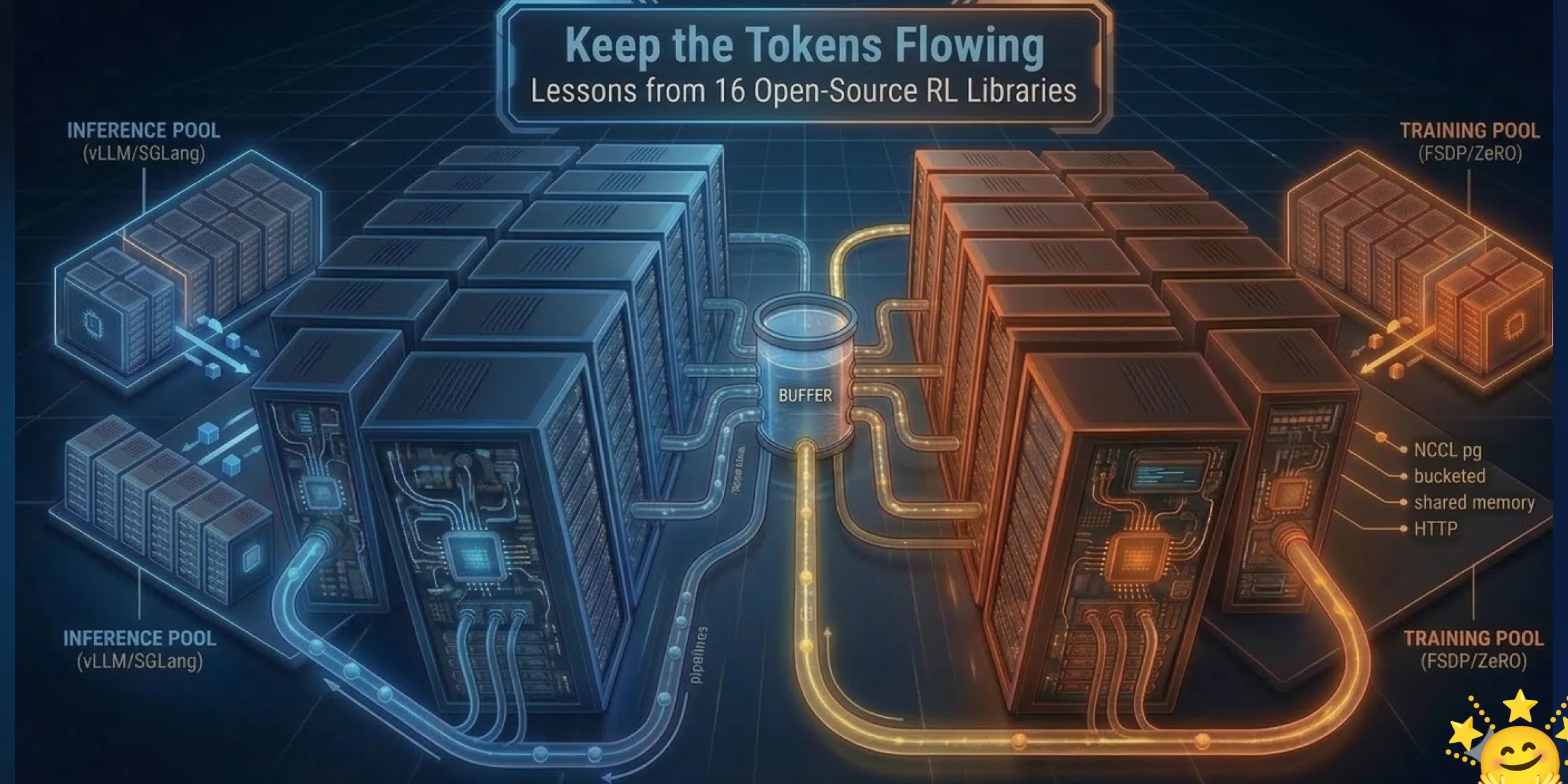

Menținând Fluxul de Token-uri: Lecții din 16 Biblioteci Open-Source de Învățare prin Întărire

O analiză tehnică detaliată a arhitecturilor de învățare prin întărire asincronă, extrăgând principii de design esențiale din 16 biblioteci open-source pentru a optimiza antrenarea modelelor de limbaj de mari dimensiuni.

Mellea 0.4.0 și Bibliotecile Granite: O Nouă Eră în Fluxurile de Lucru AI Structurate și Verificabile

IBM lansează Mellea 0.4.0 și bibliotecile Granite, o suită software revoluționară care transformă dezvoltarea AI enterprise. Prin înlocuirea prompting-ului probabilistic cu fluxuri de lucru structurate și utilizarea adaptoarelor specializate pentru sarcini precum RAG și detectarea halucinațiilor, noile instrumente promit sisteme AI mai sigure, verificabile și mentenabile.

RPA rămâne relevant, dar Inteligența Artificială transformă fundamental modul în care funcționează automatizarea

Automatizarea Proceselor Robotice (RPA) rămâne o soluție viabilă pentru sarcinile structurate, dar inteligența artificială reconfigurează peisajul automatizării. Noul paradigmă, „automatizarea inteligentă”, combină regulile fixe ale RPA cu capacitatea AI de a interpreta date nestructurate și de a lua decizii, oferind flexibilitate superioară.

Trustpilot se asociază cu companiile de inteligență artificială în contextul declinului căutării tradiționale

Trustpilot se poziționează strategic în era inteligenței artificiale, semnând parteneriate cu giganții comerțului electronic pe fondul declinului căutării tradiționale. Cu o creștere de 1.490% a traficului din căutări AI, platforma demonstrează că recenziile utilizatorilor rămân un activ esențial pentru noii agenți AI.